价格暴涨500%,HBM市场彻底被引爆

内存技术作为计算机系统的核心组成部分,其性能的提升对于整体计算能力的提升至关重要。在这个背景下,高带宽内存(HBM)以其卓越的性能表现,正逐渐在内存技术领域崭露头角,成为推动计算领域进入全新时代的关键力量。

本文引用地址:https://www.eepw.com.cn/article/202402/455655.htm相较于传统的动态随机存取内存(DRAM),HBM 的性能优势显而易见。

远远超越 DDR

DDR 是一种常见的计算机内存类型,最早是为了提高内存传输速率而设计的。它采用了双倍数据传输技术,即在每个时钟周期内可以传输两次数据,从而提高了数据传输速率。

目前最常见的 DDR 版本是 DDR4、DDR5,但在过去还有 DDR3、DDR2、DDR 等版本。每一代 DDR 版本都有不同的数据传输速率和性能。

DDR 内存通常用于计算机的系统内存,用于存储操作系统和正在运行的应用程序等数据。

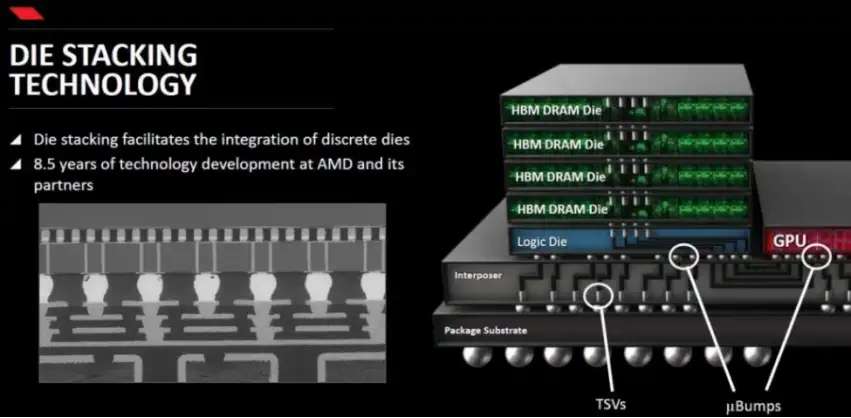

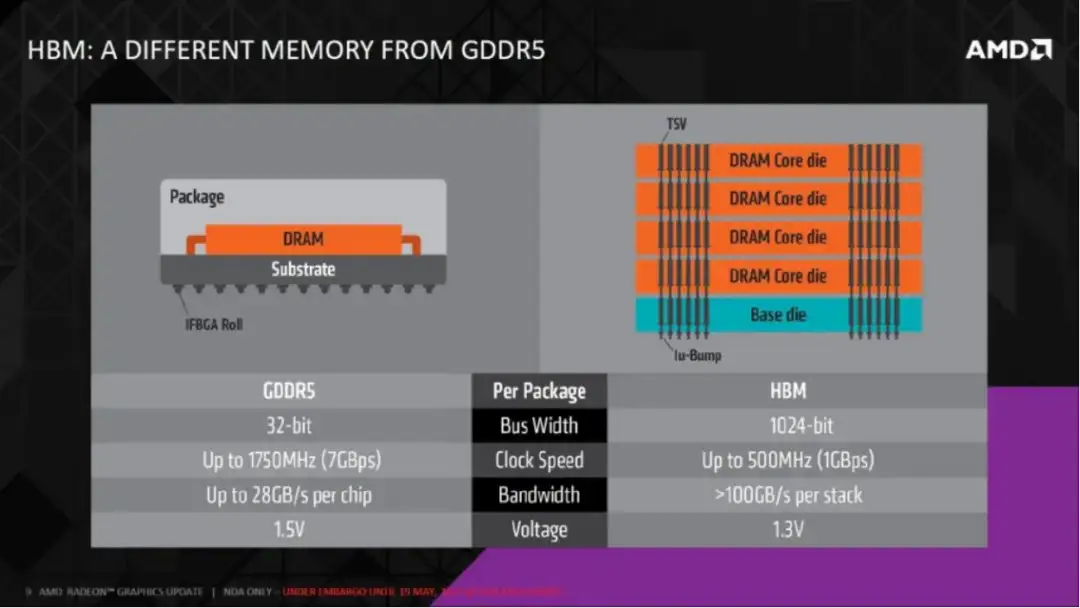

HBM 是一种高带宽内存技术,专注于提供更高的内存带宽,尤其适用于高性能计算和图形处理领域。HBM 的一个显著特点是,它使用了堆叠技术,将多个 DRAM 芯片垂直堆叠在一起,从而大大增加了数据通路,提高了内存的带宽。

因此 HBM 具有可扩展更大容量的特性。不仅 HBM 的单层 DRAM 芯片容量可扩展,HBM 还可以通过 4 层、8 层以至 12 层堆叠的 DRAM 芯片,此外 HBM 可以通过 SiP 集成多个 HBM 叠层 DRAM 芯片等方法,实现更大的内存容量。

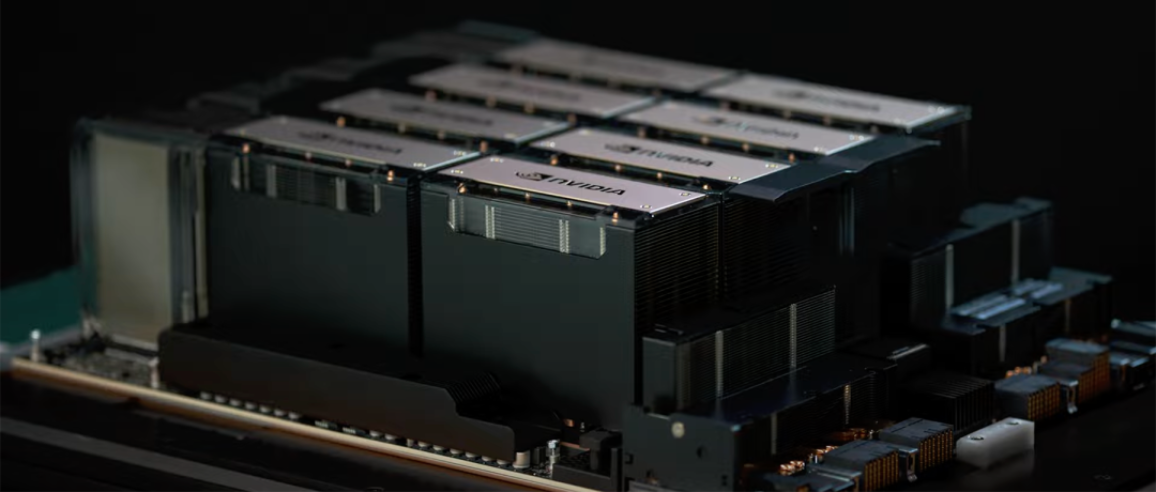

HBM 内存通常用于高性能显卡、GPU 加速器以及需要大量数据传输的高性能计算应用中。

从功耗角度来看,由于采用了 TSV 和微凸块技术,DRAM 裸片与处理器间实现了较短的信号传输路径以及较低的单引脚 I/O 速度和 I/O 电压,使 HBM 具备更好的内存功耗能效特性。以 DDR3 存储器归一化单引脚 I/O 带宽功耗比为基准,HBM2 的 I/O 功耗比明显低于 DDR3、DDR4 和 GDDR5 存储器,相对于 GDDR5 存储器,HBM2 的单引脚 I/O 带宽功耗比数值降低 42%。

在系统集成方面,HBM 将原本在 PCB 板上的 DDR 内存颗粒和 CPU 芯片全部集成到 SiP 里,因此 HBM 在节省产品空间方面也更具优势。相对于 GDDR5 存储器,HBM2 节省了 94% 的芯片面积。

三大原厂的研发历程

目前的 HBM 市场主要以 SK 海力士、三星和美光三家公司为主。

2014 年,SK 海力士与 AMD 联合开发了全球首款硅通孔 HBM,至今已经迭代升级了 4 代 HBM 产品,性能和容量持续提升。2020 年 SK 海力士宣布成功研发新一代 HBM2E;2021 年开发出全球第一款 HBM3;2022 年 HBM3 芯片供货英伟达。2023 年 8 月,SK 海力士推出 HBM3E,11 月英伟达宣布 H200 将搭载 HBM3E。

可以说从 HBM1、HBM2E、HBM3、HBM3E,SK 海力士持续领先。2022 年 SK 海力士占据 HBM 市场约 50% 的份额,三星占比 40%,美光占比 10%。

在很长一段时间内,SK 海力士都是英伟达 HBM 的独家供应商。2023 年 SK 海力士基本垄断了 HBM3 供应,今年其 HBM3 与 HBM3E 的订单也已售罄。

三星是在 2016 年,开始宣布量产 4GB/8GB HBM2 DRAM;2018 年,宣布量产第二代 8GB HBM2;2020 年,推出 16GB HBM2E 产品;2021 年,三星开发出具有 AI 处理能力的 HBM-PIM;虽然三星的路线图显示 2022 年 HBM3 技术已经量产,但实际上三星的 HBM3 在 2023 年底才正式完成验证,这意味着在大量生产之前,市场还是由 SK 海力士垄断。

再看美光,2020 年,美光宣布将开始提供 HBM2 内存/显存;2021 年,HBM2E 产品上市。为了改善自己在 HBM 市场中的被动地位,美光选择了直接跳过第四代 HBM 即 HBM3,直接升级到了第五代,即 HBM3E。随后在 2023 年 9 月,美光宣布推出 HBM3 Gen2(即 HBM3E),后续表示计划于 2024 年初开始大批量发货 HBM3 Gen2 内存,同时透露英伟达是主要客户之一。

HBM2e 过渡到 HBM3e

HBM 的概念的起飞与 AIGC 的火爆有直接关系。

AI 大模型的兴起催生了海量算力需求,而数据处理量和传输速率大幅提升使得 AI 服务器对芯片内存容量和传输带宽提出更高要求。HBM 具备高带宽、高容量、低延时和低功耗优势,目前已逐步成为 AI 服务器中 GPU 的搭载标配。

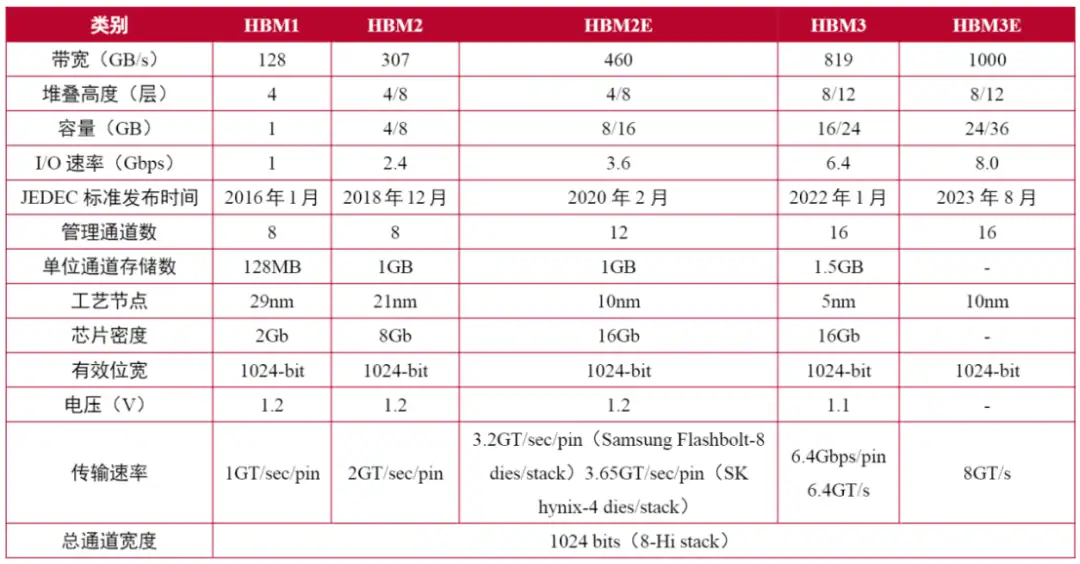

目前,HBM 产品以 HBM(第一代)、HBM2(第二代)、HBM2E(第三代)、HBM3(第四代)、HBM3E(第五代)的顺序开发,最新的 HBM3E 是 HBM3 的扩展版本。

来源:山西证券

HBM 每一次更新迭代都会伴随着处理速度的提高。引脚(Pin)数据传输速率为 1Gbps 的第一代 HBM,发展到其第五代产品 HBM3E,速率提高到了 8Gbps,即每秒可以处理 1.225TB 的数据。也就是说,下载一部长达 163 分钟的全高清(Full-HD)电影(1TB)只需不到 1 秒钟的时间。

当然,存储器的容量也在不断加大。HBM2E 的最大容量为 16GB,目前,三星正在利用 EUV 光刻机来制造 24GB 容量的 HBM3 芯片,此外 8 层、12 层堆叠可在 HBM3E 上实现 36GB(业界最大)的容量,比 HBM3 高出 50%。

此前 SK 海力士、美光均已宣布推出 HBM3E 芯片,皆可实现超过 1TB/s 的带宽。

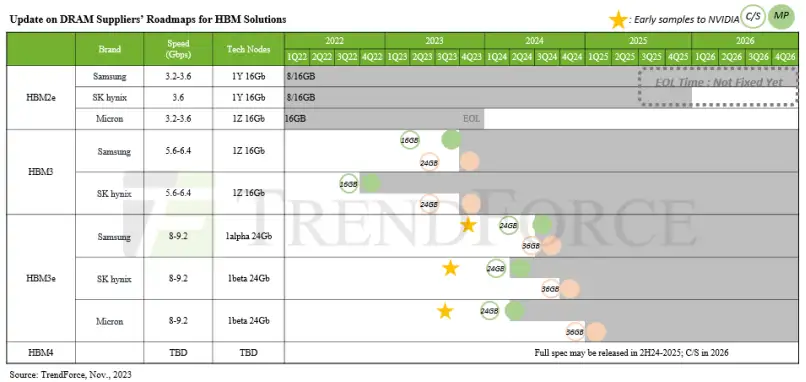

根据 TrendForce 集邦咨询调查显示,2023 年 HBM 市场主流为 HBM2e,包含 NVIDIA A100/A800、AMD MI200 以及多数 CSPs 自研加速芯片皆以此规格设计。同时,为顺应 AI 加速器芯片需求演进,各原厂计划于 2024 年推出新产品 HBM3e,预期 HBM3 与 HBM3e 将成为明年市场主流。

HBM3e 市场彻底被引爆

SK 海力士无疑是这波内存热潮中的最大受益者,截至 2023 年 12 月 31 日,SK 海力士在 2023 财年和第四季度的营收取得了显著增长。特别是其主力产品 DDR5 DRAM 和 HBM3,在这一年的收入较去年上涨了 4 倍以上。

英伟达和 AMD 的下一代人工智能 GPU 预计将主要搭载 HBM3 内存。例如,H100 是第一款支持 PCIe 5.0 标准的 GPU,也是第一款采用 HBM3 的 GPU,最多支持六颗 HBM3,带宽为 3TB/s,是 A100 采用 HBM2E 的 1.5 倍,默认显存容量为 80GB。

2023 年 11 月英伟达发布了新一代 AI GPU 芯片 H200,以及搭载这款 GPU 的 AI 服务器平台 HGX H200 等产品。这款 GPU 是 H100 的升级款,依旧采用 Hopper 架构、台积电 4nm 制程工艺,根据英伟达官网,H200 的 GPU 芯片没有升级,核心数、频率没有变化,主要的升级便是首次搭载 HBM3e 显存,并且容量从 80GB 提升至 141GB。

得益于新升级的 HBM3e 芯片,H200 的显存带宽可达 4.8TB/s,比 H100 的 3.35TB/s 提升了 43%。不过这远没有达到 HBM3e 的上限,海外分析人士称英伟达有意降低 HBM3e 的速度,以追求稳定。如果与传统 x86 服务器相比,H200 的内存性能最高可达 110 倍。

由于美光、SK 海力士等公司的 HBM3e 芯片需等到 2024 年才会发货,因此英伟达表示 H200 产品预计将在 2024 年第二季度正式开售。

AMD 的 MI300 也搭配 HBM3,其中,MI300A 容量与前一代相同为 128GB,更高端 MI300X 则达 192GB,提升了 50%。AMD 称,MI300X 提供的 HBM 密度最高是英伟达 AI 芯片 H100 的 2.4 倍,其 HBM 带宽最高是 H100 的 1.6 倍。这意味着,AMD 的芯片可以运行比英伟达芯片更大的模型。

与此同时,在 2023 年随着 AI GPU 以及与 AI 相关的各类需求激增,HBM 价格也持续上涨。市场研究机构 Yolo Group 报告显示,2023 年期间 HBM 内存供需链发生了重大变化,生产水平和采用率同时大幅提高,使得 HBM 成为比人工智能热潮之前更有价值的资源,2023 年 HBM 芯片的平均售价是传统 DRAM 内存芯片的五倍。

在 HBM 盛行的当下,没有一家存储厂商能够忍住不分一杯羹。

三大原厂为之「疯狂」

技术升级

三大原厂的研究进展

SK 海力士在 SEMICON Korea 2024 上发布了一项重要公告,公布了其雄心勃勃的高带宽存储器路线图。该公司副总裁 Kim Chun-hwan 透露,计划在 2024 上半年开始量产先进的 HBM3E,并强调向客户交付 8 层堆叠样品。

HBM3E 是 SK 海力士产品线的最新产品,可满足日益增长的数据带宽需求,在 6 堆栈配置中,每堆栈可提供 1.2 TB/s 和惊人的 7.2 TB/s 通信带宽。Kim Chun-hwan 将这种进步的紧迫性归因于生成式人工智能的迅速崛起,预计将见证惊人的 35% 的复合年增长率(CAGR)。然而,他警告说,在不断升级的客户期望的推动下,半导体行业正在面临「激烈的生存竞争」。

随着制程工艺节点的缩小并接近其极限,半导体行业越来越关注下一代存储器架构和工艺,以释放更高的性能。SK 海力士已经启动了 HBM4 的开发,计划于 2025 年提供样品,并于次年量产。

根据美光的信息,与前几代 HBM 相比,HBM4 将采用更广泛的 2048 位接口。导致每个堆栈的理论峰值内存带宽超过 1.5 TB/s。为了实现这些非凡的带宽,在保持合理功耗的同时,HBM4 的目标是大约 6GT/s 的数据传输速率。这种更宽的接口和更快的速度将使 HBM4 能够突破内存带宽的界限,满足日益增长的高性能计算和 AI 工作负载需求。

三星是半导体行业的主要参与者,该公司也有 HBM4 的发布时间表,计划于 2025 年提供样品,并于 2026 年量产。三星高管 Jaejune Kim 透露,该公司的 HBM 产量的一半以上已经由专业产品组成。定制 HBM 解决方案的趋势预计将加剧。通过逻辑集成,量身定制的选项对于满足个性化客户需求至关重要,从而巩固了市场地位。

随着 HBM3E 的发布和 HBM4 的准备,SK 海力士和三星正在为未来的挑战做准备,旨在保持其在 HBM 技术前沿的地位。不仅如此,全球前三大存储芯片制造商正将更多产能转移至生产 HBM,但由于调整产能需要时间,很难迅速增加 HBM 产量,预计未来两年 HBM 供应仍将紧张。

扩产情况

再看三大原厂的扩产情况。据悉,SK 海力士将扩大其高带宽内存生产设施投资,以应对高性能 AI 产品需求的增加。

去年 6 月有媒体报道称,SK 海力士正在准备投资后段工艺设备,将扩建封装 HBM3 的利川工厂,预计到今年年末,该厂后段工艺设备规模将增加近一倍。

此外,SK 海力士还将在美国印第安纳州建造一座最先进的制造工厂,据两位接受英国《金融时报》采访的消息人士透露,SK 海力士将在这家工厂生产 HBM 堆栈,这些堆栈将用于台积电生产的 Nvidia GPU,SK 集团董事长表示,该工厂预计耗资 220 亿美元。

三星电子和 SK 海力士之间的竞争正在升温。三星电子从去年第四季度开始扩大第四代 HBM 即 HBM3 的供应,目前正进入一个过渡期。负责三星美国半导体业务的执行副总裁 Han Jin-man 在今年 1 月表示,公司对包括 HBM 系列在内的大容量存储芯片寄予厚望,希望它能引领快速增长的人工智能芯片领域。他在 CES 2024 的媒体见面会上对记者说,「我们今年的 HBM 芯片产量将比去年提高 2.5 倍,明年还将继续提高 2 倍。」

三星官方还透露,公司计划在今年第四季度之前,将 HBM 的最高产量提高到每月 15 万至 17 万件,以此来争夺 2024 年的 HBM 市场。此前三星电子斥资 105 亿韩元收购了三星显示位于韩国天安市的工厂和设备,以扩大 HBM 产能,同时还计划投资 7000 亿至 1 万亿韩元新建封装线。

为了缩小差距,美光对其下一代产品 HBM3E 下了很大的赌注,美光首席执行官 Sanjay Mehrotra 表示:「我们正处于为英伟达下一代 AI 加速器提供 HBM3E 的验证的最后阶段。」其计划于 2024 年初开始大批量发货 HBM3E 内存,同时强调其新产品受到了整个行业的极大兴趣。据悉,美光科技位于中国台湾地区的台中四厂已于 2023 年 11 月初正式启用。美光表示,台中四厂将整合先进探测与封装测试功能,量产 HBM3E 及其他产品,从而满足人工智能、数据中心、边缘计算及云端等各类应用日益增长的需求。该公司计划于 2024 年初开始大量出货 HBM3E。

值得注意的是高阶 HBM 的竞争才刚刚开始,虽然目前 HBM 产品占整体存储的出货量仍然非常小,长期来看,随着消费电子产品向 AI 化发展,对于高算力、高存储、低能耗将是主要诉求方向,鉴于此预计 HBM 也将成为未来存储厂商的技术发展方向。

评论