英伟达甩出三大「王炸」

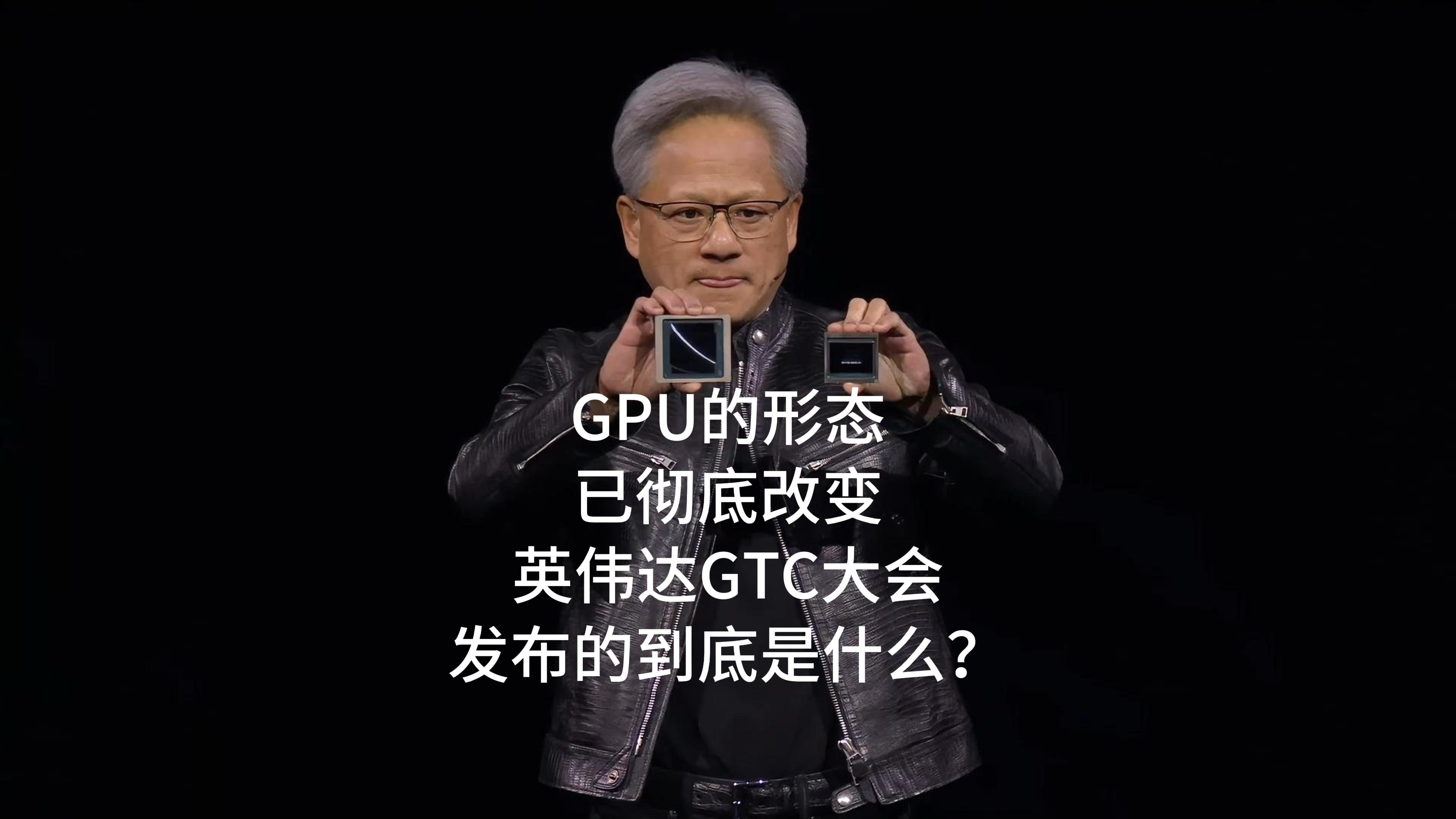

在今日凌晨的英伟达 GTC 2025 大会主题演讲中,英伟达 CEO 黄仁勋再次身穿皮衣登场,两个小时的时长被芯片架构、数据中心、自动驾驶、AI 计算机以及机器人等关键分享塞得满满的。

本文引用地址:https://www.eepw.com.cn/article/202503/468430.htm演讲的开篇,黄仁勋强调了计算和软件的重要性,他表示:世界正在进行一场过渡——计算方式迎来变革、软件的未来需要资本投资。

Blackwell Ultra 芯片:推理性能较前代暴涨 40 倍

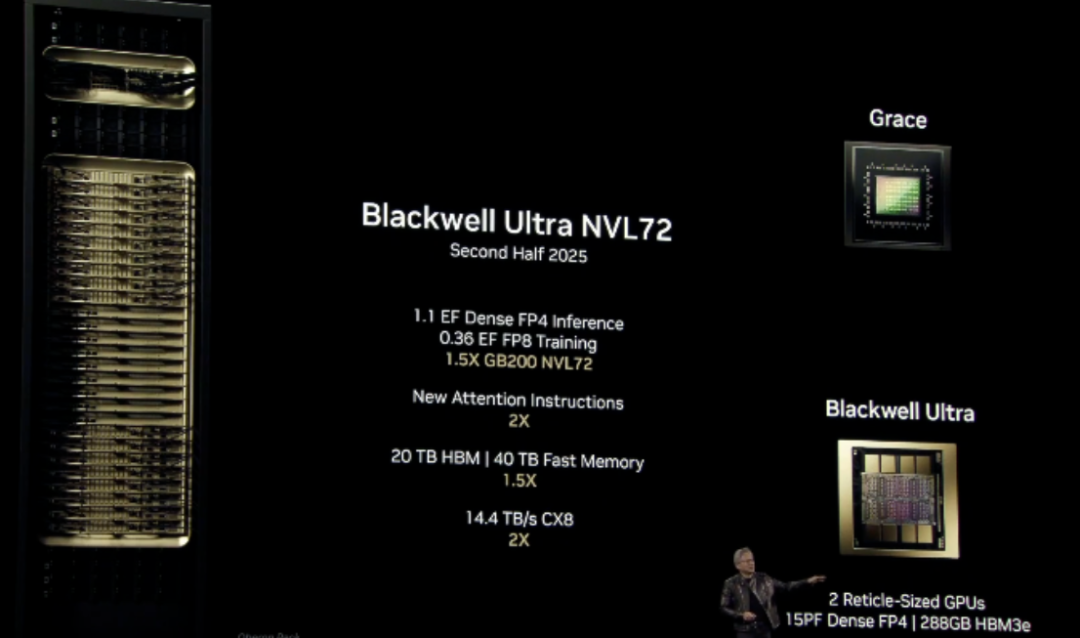

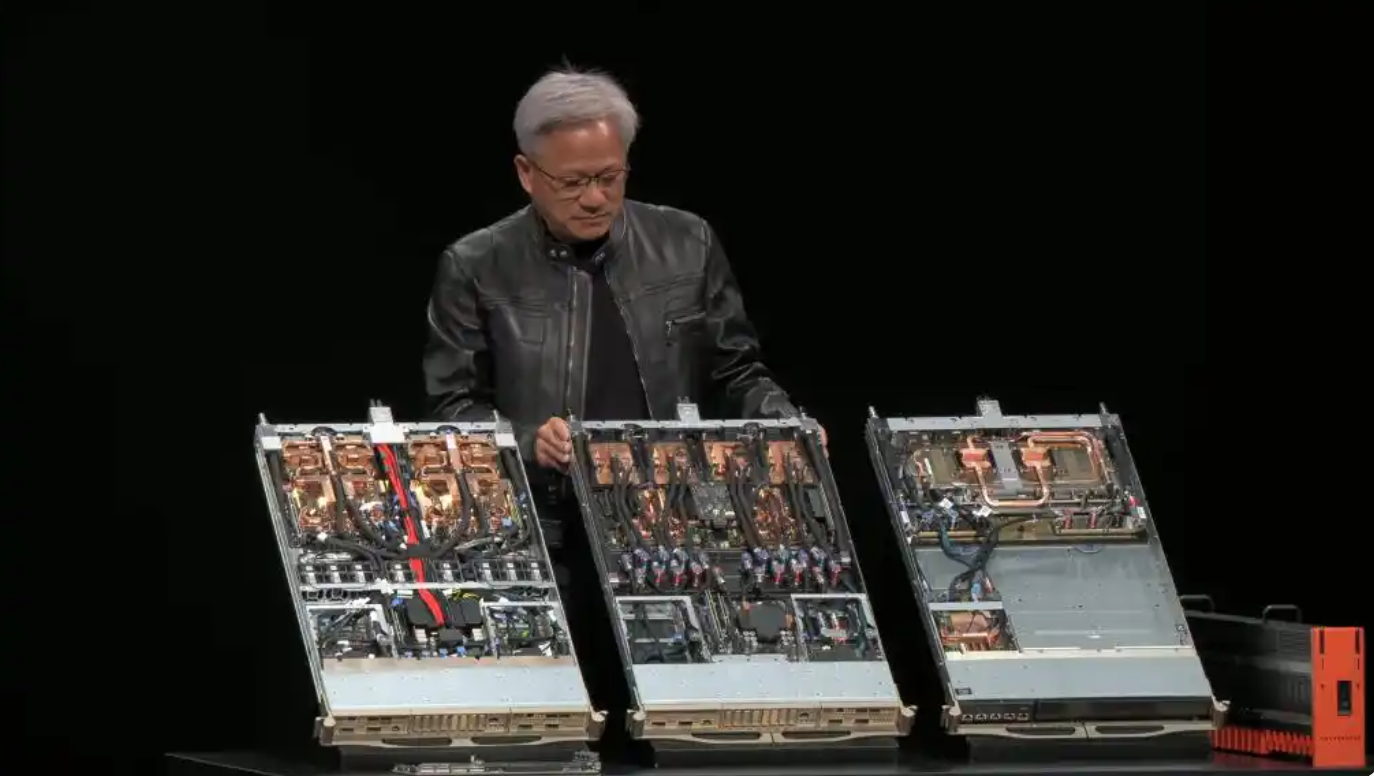

正如大家期待的那般,英伟达在 GTC 大会上宣布推出 Blackwell Ultra 芯片,其包括 GB300 NVL72 机架级解决方案和 NVIDIA HGX B300 NVL16 系统。

其中,GB300 NVL72 将 72 个 Blackwell Ultra GPU 与 36 个基于 Arm Neoverse 的 Grace CPU 相连,有效地充当一个大规模 GPU 来支持复杂问题解决并提高响应质量。基于现有 Blackwell 架构的 Blackwell Ultra 预计将比前代产品提供 1.5 倍的 AI 性能,显著增加 AI 工厂的收入机会。

而 HGX B300 NVL16 是服务器级产品,搭载 16 个 Blackwell Ultra GPU,对比前代 Blackwell GPU,大语言模型推理速度提升 11 倍,计算能力提高 7 倍,内存容量增加 4 倍。

黄仁勋在演讲中强调,Blackwell Ultra 是为「推理和代理型 AI」时代设计的平台,可高效支持大模型的预训练、微调及实时推理,并称其为英伟达「最强大的芯片」,推动 AI 基础设施向推理优化转型。

黄仁勋表示,「在推理模型中,Blackwell 的性能是 Hopper 的 40 倍」。在展示中,传统模型的代表是 Meta Llama 3.3,而推理模型是 DeepSeek 的 R1。

值得一提的是,GB300 系列将于 2025 年 5 月启动量产,B300 系列计划下半年交付,配套服务器系统同步上市。其中,台积电负责芯片制造,SK 海力士提供 HBM3e 内存,超微负责服务器集成,确保产能稳定。

据英伟达透露,全球四大云巨头部署的 Blackwell 芯片数量已达 Hopper 芯片的三倍,2024 年他们共采购了 130 万片 Hopper 架构芯片。2025 年又购买了 360 万 Blackwell 芯片。考虑到每颗 Blackwell 芯片的售价高达数万美元,这意味着数十亿美元的市场规模。黄仁勋打趣道,在最新技术的加持下,搭建 AI 工厂的厂商「买得越多、省得越多」,总而言之就是掏钱吧。

英伟达新一代 AI 芯片 Rubin 于 2026 下半年推出

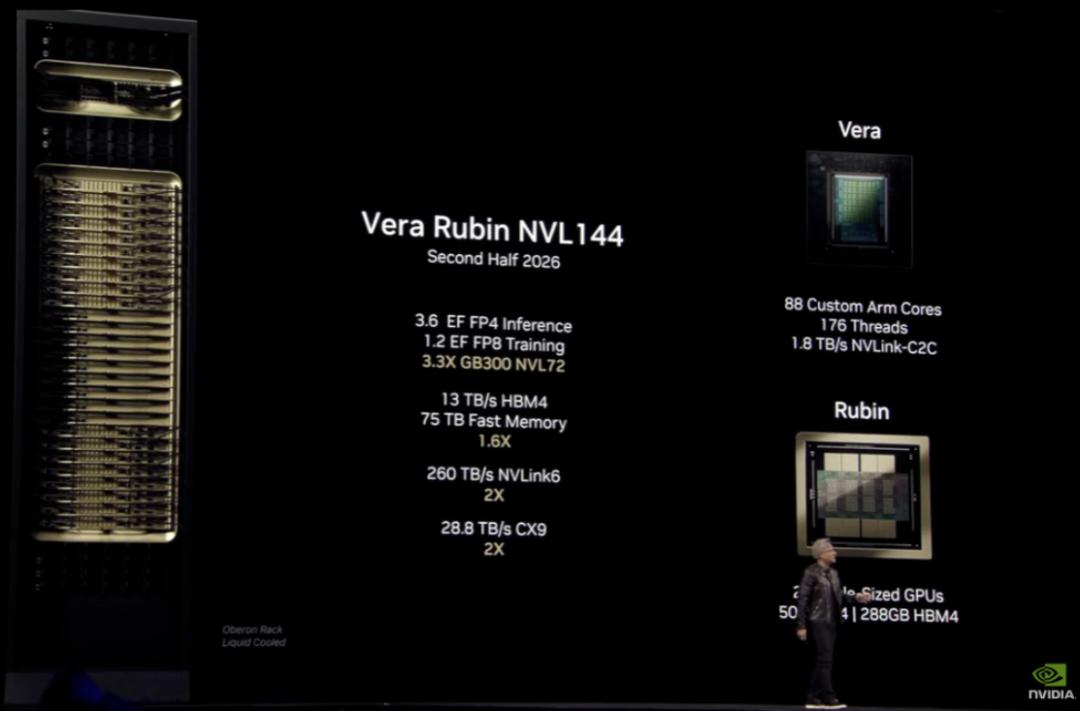

黄仁勋重磅公布了新一代 AI 芯片 Rubin,也就是 Hopper、Blackwell 之后的下一代架构。Rubin 的命名风格延续了英伟达一直以来以杰出科学家命名芯片架构的传统,是为纪念「证实暗物质存在」的女性科学先驱薇拉・鲁宾(Vera Rubin,1928–2016,婚前姓 Cooper)。

Vera Rubin 和 Grace Blackwell 类似,集成了 CPU 和 GPU。在 Grace Blackwell 中,Grace 是 CPU,Blackwell 是 GPU;而在 Vera Rubin 中,Vera 是 CPU,Rubin 是 GPU。

其中,Vera CPU 是英伟达首次基于自主架构 Olympus 设计的处理。此前,英伟达一直使用 Arm 授权的通用 CPU 设计,这在某种程度上限制了其系统级优化能力。随着 AI 计算负载的特殊性日益凸显,通用 CPU 已难以满足极致性能和能效比的要求。英伟达表示,Vera CPU 的内存是 Grace 的 4.2 倍,内存带宽是 Grace 的 2.4 倍。结合 Vera 的 88 个 CPU 内核,英伟达称该芯片的整体性能将是前一代产品的两倍。

而 Rubin GPU 的创新之处在于其双 GPU 架构设计。与 Blackwell 一样,Rubin 也采用了多芯片封装技术,但英伟达对这一技术的定义进行了重要调整。从 Rubin 开始,英伟达将多芯片模块中的每个裸片视为独立的 GPU,而非整体一个 GPU。这一定义变更不仅是技术表述的调整,更反映了英伟达对未来 GPU 架构发展的战略思考。

在推理性能方面,Rubin 实现了惊人的 50 petaflops,是当前 Blackwell 芯片的 2.5 倍。同时,其 288GB 的超大内存容量,为处理超大规模 AI 模型提供了充足的空间。这意味着 Rubin 能够更高效地运行如 GPT-4 等数万亿参数的超大模型,使实时推理和更复杂的推理任务成为可能。

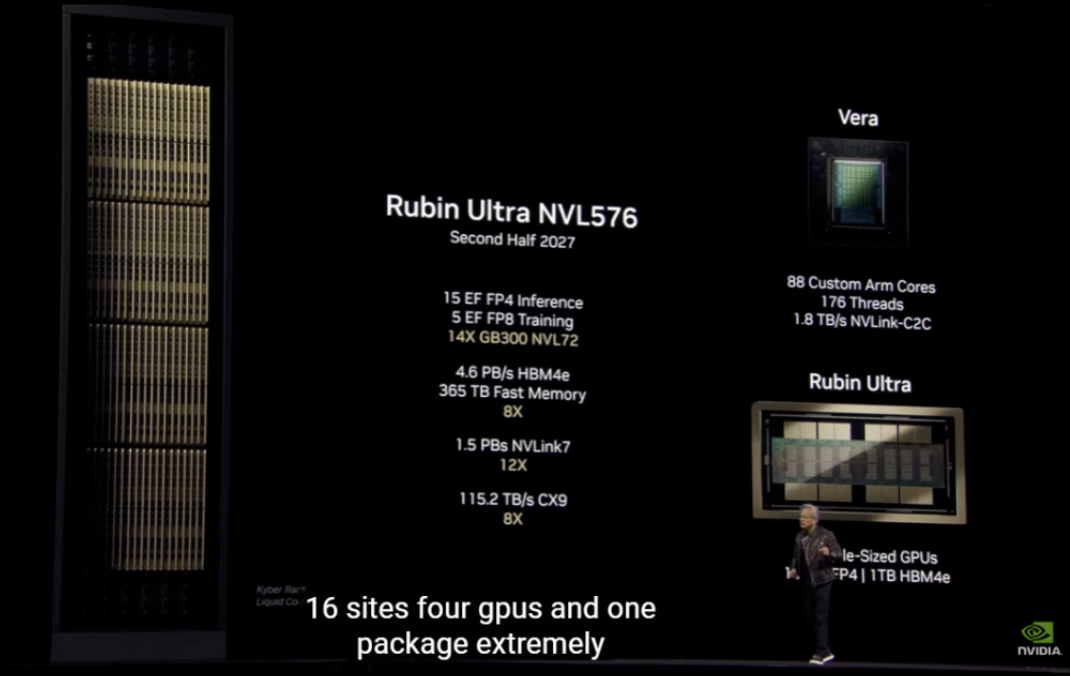

英伟达还公布了"Rubin Next"的开发计划,Vera Rubin 之后的一代芯片,名为 Vera Rubin Ultra。将于 2027 年下半年上市的 Vera Rubin Ultra 将把 Vera CPU 和 Rubin Ultra 芯片结合在一起。每个 Rubin 处理器由两个 GPU 组成一个单芯片,而 Rubin Ultra 则由四个 GPU 裸片组成,进一步将性能翻倍。这种"更多 GPU"的集成策略,与行业的多芯片模块(MCM)和芯粒(Chiplet)趋势相呼应,代表了高性能计算芯片的未来发展方向。

黄仁勋展示了 Vera Rubin NVLink576 的外观和参数,并宣称 Rubin 的性能可达 Hopper 的 900 倍,而 Blackwell 是 Hopper 的 68 倍。

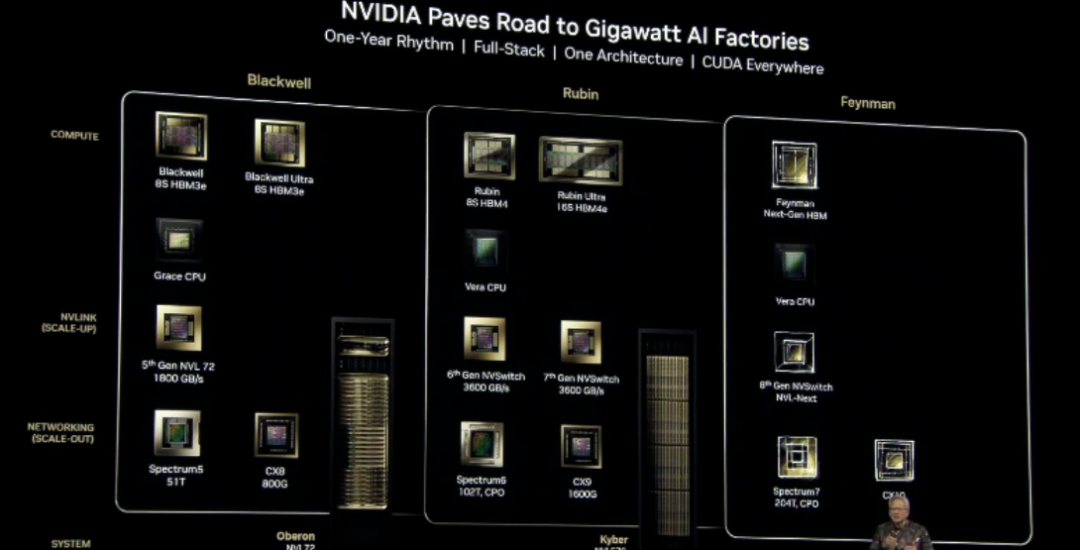

Blackwell Ultra 和 Vera Rubin 的发布,标志着英伟达已成功将芯片更新周期从两年缩短至一年。

在本次发布会,英伟达公开了其产品路线图:Blackwell(2024 年) → Blackwell Ultra(2025 年) → Vera Rubin(2026 年) → Rubin Next(2027 年) → Feynman(2028 年)。这一清晰的"双芯双代"发展路线(每两代架构各两款芯片),让英伟达能够在保持技术领先的同时,最大化每代架构的商业价值。

值得一提的是,在 Rubin 之后的下一代 AI 芯片架构,英伟达将其命名为 Feynman,取自著名物理学家理查德・费曼。他是美国理论物理学家,以对量子力学的路径积分表述、量子电动力学、过冷液氦的超流性以及粒子物理学中部分子模型的研究闻名于世。根据英伟达路线图,Feynman 架构将于 2028 年登场。

掀起小高潮的 AI 计算机与机器人

除了芯片,此次 GTC 大会的另一个小高潮就是黄仁勋介绍英伟达在 AI 计算机和机器人产线的突破。

英伟达推出了新款 DGX Spark 和 DGX Station 个人 AI 计算机,黄仁勋称其为「AI 时代的超级计算机」。

据介绍,这两款超级计算机均由 Grace Blackwell 平台支持,旨在「让 AI 开发人员、研究人员、数据科学家和学生在桌面上对大模型进行原型设计、微调和推理」。

其中,Spark 搭载了 GB10 Blackwell 芯片,提供第五代 Tensor Core 和 FP4 支持,具有 128GB 统一内存和高达 4TB 的 NVMe SSD 存储,可以提供「高达每秒 1 千万亿次运算的 AI 计算。」

而体积更大的 DGX Station 可以容纳英伟达刚刚宣布的功能更强大的 GB300 Blackwell Ultra 芯片,可提供「每秒 20 千万亿次运算的 AI 性能和 784GB 的统一系统内存」。

Spark 将于今日开始预订,售价 3000 美元起。DGX Station 目前尚未定价。

在机器人领域,英伟达推出了全球首款开源人形机器人功能模型 GR00T N1。

GR00T N1 基础模型采用双系统架构,其灵感来自人类认知原理。「系统 1」是一种快速思考的行动模型,反映了人类的反应或直觉。「系统 2」则是一种慢速思考的模型,用于深思熟虑、有条不紊的决策。

在视觉语言模型的支持下,系统 2 可以推理其环境和收到的指令,从而规划行动。然后,系统 1 将这些计划转化为精确、连续的机器人动作。

目前,GR00T N1 可以实现常见任务,例如抓取、用一只或两只手移动物体,以及将物品从一只手转移到另一只手,或者执行需要技能组合的多步骤任务。开发人员和研究人员可以使用真实或合成数据对 GR00T N1 进行后期训练,以适应特定的人形机器人或任务。

评论