用于汽车的Tensilica AI协处理器

Cadence Design Systems 开发了一种可配置的协处理器,为汽车神经处理单元提供更大的灵活性。

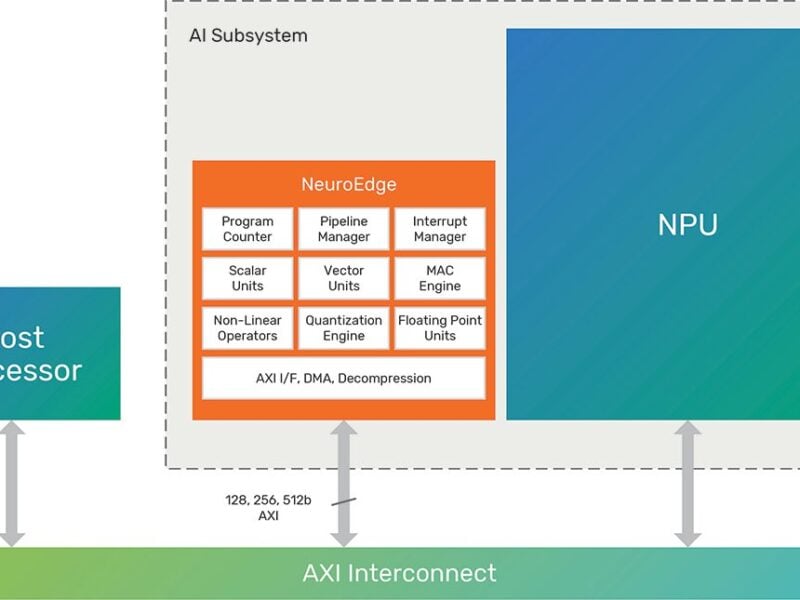

本文引用地址:https://www.eepw.com.cn/article/202505/470218.htmTensilica NeuroEdge 130 AI 协处理器 (AICP) 是一类新型处理器,旨在补充高级汽车、消费电子、工业和移动 SoC 上代理和物理 AI 网络的任何神经处理单元 (NPU)。

该内核基于 Tensilica Vision DSP 系列的成熟架构,可在不影响性能的情况下节省 30% 以上的面积和超过 20% 的动态功耗和能源。它还运行相同的软件、AI 编译器、库。

基于 Tensilica Xtensa VLIW 的 SIMD 架构允许自定义扩展,这可以提供与内部 NPU 的兼容性,与其特定于应用的前代产品相比,可以提高端到端性能和效率。

它向作为控制处理器的 NPU 发出指令和命令,其中包含优化指令以运行非 NPU 最佳任务,例如 ReLU、sigmoid 和 tanh。它使用 512 个 8×8 乘法累加 (MAC) 单元发出 512 条宽指令,还包括一个新的高带宽直接接口 (HBDI) 来馈送 NPU。

Cadence 表示,目前正在进行多个客户参与,包括 indie Semiconductor 和 Neuchips。Dream Chip 还将 Tensilica 内核用于汽车设计。

用于嵌入式 AI 的下一代 Tensilica 内核

Cambrian AI Research 创始人兼首席分析师 Karl Freund 表示:“随着 AI 处理在自动驾驶汽车、机器人、无人机、工业自动化和医疗保健等物理 AI 应用中的迅速普及,NPU 正发挥着更加关键的作用。“如今,NPU 处理大部分计算密集型 AI/ML 工作负载,但大量非 MAC 层包括前处理和后处理任务,这些任务可以更好地卸载到专用处理器。然而,当前的 CPU、GPU 和 DSP 解决方案涉及权衡,该行业需要一种低功耗、高性能的解决方案,该解决方案针对协处理进行了优化,并允许适应未来快速发展的 AI 处理需求。

“Cadence 已经通过我们的 Tensilica DSP 验证了 AI 协处理器用例。随着 AI 工作负载的转变和领域范围的减少,我们的 AI SoC 和系统客户一直在寻求一种小型、高效的、以 AI 为中心的协处理器,以实现更好的 PPA 和面向未来的需求。“延续我们在 IP 创新方面的记录,我们推出了一种专门构建的新型处理器。Tensilica NeuroEdge 130 AICP 设计为 NPU 伴侣,提高了性能效率的标准,以满足客户最苛刻的 AI 应用需求。

“AI 和计算机视觉在越来越多的嵌入式应用中发挥着重要作用,”Edge AI 和视觉联盟创始人 Jeff Bier 说。“但 AI 模型和相关的前处理和后处理步骤正在迅速发展;例如,如今许多开发人员正在采用基于 transformer 的多模态模型和基于 LLM 的 AI 代理。我们赞赏 Cadence 在灵活高效处理器方面的持续创新,这是实现边缘 AI 和视觉广泛部署的关键。

Cadence NeuroWeave 软件开发套件 (SDK) 支持 NeuroEdge™ 130 AICP,该套件是 Cadence 所有 AI IP 中使用的单一 SDK。它使用 Tensor Virtual Machine (TVM) 堆栈来调整、优化和部署其 AI 模型,以用于 Cadence 的 AI IP。它还配备了一个轻量级的独立 AI 库,允许在新处理器上直接对 AI 层进行编程,并绕过某些编译器框架的潜在开销。

作为面向汽车市场的 SoC 解决方案的领导者,indie 专注于 SoC 架构创新,以提供高性能、面积和功耗效率。为了实现这一目标,我们将处理元件集成到最适合特定计算功能的 SoC 中,确保我们的解决方案能够满足 ADAS 系统对计算机视觉、雷达和传感器融合的需求。indie 已成功在多个量产 ADAS SoC 中部署 Tensilica DSP。我们欢迎 Cadence 的 NeuroEdge AICP IP产品组合以及支持工具、软件库和生态系统的加入,以满足不断发展的 AI 支持汽车应用的需求。

MulticoreWare 与 Cadence 的长期合作伙伴关系使我们能够支持 OEM 和一级合作伙伴在汽车和其他边缘环境中部署 AI 工作负载。通过这些合作,我们亲眼目睹了 NPU 作为完整、独立的 AI 部署解决方案往往无法满足要求。NeuroEdge AICP 硬件和 SDK 巧妙地解决了这一差距。围绕 NeuroEdge AICP 构建的 AI SoC 模块不仅为当今的领先模型提供峰值性能,而且还提供了适应未来 AI 创新的灵活性,“MulticoreWare 首席技术官 John Stratton 说。

“Neuchips 正在通过尖端 SoC 彻底改变数据中心和服务器场,这些 SoC 旨在处理大型语言模型和转换器的巨大处理需求。由于 SoC AI 子系统经常面临支持前处理和后处理阶段的挑战,因此很高兴看到 NeuroEdge AICP 旨在管理此类任务。Cadence 成熟的 Tensilica 工具链和软件基础设施有助于将这种新 IP 轻松集成到复杂的 SoC 设计中,“Neuchips 首席执行官 Ken Lau 表示。

评论