边缘视觉 AI 的理想平台

Kria K26 SOM 旨在让数百万开发者在他们最擅长的环境下,用开箱即用的低成本开发套件入门,以更快的速度部署他们的智能视觉应用。

本文引用地址:https://www.eepw.com.cn/article/202106/426416.htm概要

随着人工智能 (AI) 和机器学习 (ML) 算法取得一系列新的进展,众多高计算强度的应用现在正在被部署到边缘设备上。因此我们需要一种高效率的硬件,既能高效率地执行复杂算法,又能适应这种技术的快速演进。赛灵思 Kria™ K26 SOM 的设计初衷,是用于满足在边缘设备上高效率执行 ML 应用的需求。本白皮书对各种 ML 模型和实时应用的性能开展研究并与英伟达 Jetson Nano 和英伟达 Jetson TX2 进行对比。赛灵思的研究结果表明,K26 SOM 提供了比英伟达 Jetson Nano高出大约 3 倍的性能。此外,它的单位功耗性能比英伟达 Jetson TX2 提升 2 倍。对于 SSD MobileNet-v1 这样的网络,K26 SOM 的低时延高性能深度学习处理单元 (DPU)提供了比 Nano 高出 4 倍,甚至更高的性能,这使得 Kria SOM 成为ML 边缘应用开发的理想选择。

计算视觉的发展

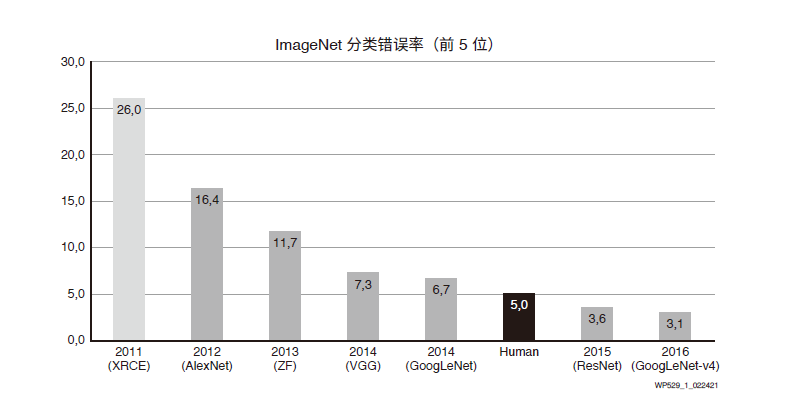

在过去十年,人工智能和机器学习算法有了长足发展。这些发展主要体现在视觉相关的应用上。2012 年,AlexNet(Krizhevsky 等[参考资料 1])从 ImageNet 大规模视觉识别挑战赛胜出 (ILSVRC),成为首个使用反向传播算法完成训练的深度神经网络。与传统的浅网络相比,性能发生了前所未有的近 10% 的飞跃, 预测精度跻身前 5 位。这个重大发展是一个转折点。从那时起,深度神经网络在性能和精度两个方面不断迎来巨大进展。2015 年 ResNet(Kaiming 等[参考资料 2])超越了单个人类的分类能力。参见图1。就各种目的和用途而言,今天的神经网络的错误率已经可以与贝叶斯错误率相媲美,可以视为已经解决了计算机视觉应用中的图像分类问题。

图1 前5位预测精度

鉴于如此令人振奋的结果,半导体制造商争相开发器件,支持深度学习部署的高度复杂的计算需求。在未来十年,推断功能的商业化,特别是用深度学习实现的计算机视觉的商业化,将继续高速增长。计算机视觉市场规模预计将以 30% 的年均复合增长率 (CAGR) 增长,到 2025 年将达到 262 亿美元 [参考资料 3]。用深度学习实现的计算机视觉可以广泛地应用到各类行业市场,包括零售分析、智慧城市、执法、边境安全、机器人、医疗成像、作物收获优化、符号语言识别等。在不远的未来,AI 将成为日常生活的内在组成部分。而且有部分人认为如今这样的未来近在咫尺。

随着新颖的网络、层和量化技术被开发出来,采用固定存储器架构的硬化Tensor 加速器,不再能够满足未来的需求。这种状况已经在 MobileNets(Howard 等)的发展中表露无遗[参考资料 4]。在 MobileNet 骨干网络中使用深度卷积能大幅降低计算-存储器比。这对于通用 CPU 这样的器件来说非常理想。CPU 一般受计算约束,但在若因架构受存储器所限而导致效率有限,在某种程度上等于浪费了宝贵的计算周期,

就像数据中心中的空闲服务器消耗能量一样。这种计算-存储器比影响着部署网络[参考资料 5]时具体 Tensor 加速器架构的总效率。不幸的是,ASIC 和 ASSP Tensor 加速器架构一般在器件流片前至少一年就已冻结。但在使用赛灵思推断技术时则不会发生这种情况。赛灵思技术能随时间推移进行调整和优化,以支持神经网络架构的快速演进发展,从而确保低功耗、高效率。

本白皮书介绍了赛灵思产品组合中的最新成员 Kria™ K26 SOM,及其在嵌入式视觉应用中的的主要优势。

评论