Adaline神经网络随机逼近LMS算法的仿真研究

1 引言

人工神经网络最重要的功能之一是分类。对于线性可分问题,采用硬限幅函数的单个神经元,通过简单的学习算法就可成功实现分类。即对于两个不同类中的输入矢量,神经元的输出值为0或1。但对于大多数非线性可分类,硬限幅神经元则无法完成分类功能。自适应线性元件Adaline(Adap-tive LiIlear Element)是一种具有线性功能函数的神绎元,在实际输出与理想预期值的最小二乘LMS(Least Mean Square)的统计意义下进行学习,可以实现最佳的非线性可分集合的分类,即按照最小二乘的统计意义要求,实际输出值与理想预期值之间的误差均方值为最小,能够实现这一目的算法即称为最小二乘学习算法或LMS算法。

2 Adaline的LMS算法原理

设输入矢量X=[x1,x2,…,xn],加权矢量W=[ω1,ω2,…,ωn],则神经元的输出为:

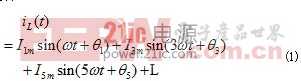

定义ε(k)是理想输出值d(k)与实际输出值y(k)之间的误差,即ε(k)=d(k)-y(k),其均方值记作E[ε2(k)],令ζ(k)=E[ε2(k)],则:

![]()

由式(2)可知必定存在最佳的加权矢量W*,使ζ(k)达到最小,此时ζ(k)相对于W的梯度等于零,从而可以得到:

式(3)虽然给出了求最佳加权矢量的方法,但需要大量的统计计算,而且当输入矢量X的维数很大时,需要解决高阶矩阵求逆问题,这些在数学计算上都是非常闲难的。

3 随机逼近LMS学习算法的提出

为了解决式(3)存在的问题,有学者提出LMS学习问题的严格递推算法和随机逼近算法,这里简要描述其算法原理。LMS学习问题的严格递推算法是在任意设置初始加权矢量W(0)时,对于每一个时序变量k,对W调整:

![]()

用这种方法可以保证求得严格的最佳解,而且避开矩阵求逆。但学习过程的每一步仍需大量的统计计算,仍需解决统计计算困难。

评论