英伟达斥资200亿美元“收编”谷歌TPU创始团队

有关英伟达即将收购Groq的传闻一度引发市场震动。媒体援引消息,今年9月领投Groq融资的投资机构Disruptive CEO Alex Davis透露,英伟达同意以200亿美元现金收购AI芯片初创公司Groq,且交易进展迅速,包括Groq除云业务外的所有资产。然而,实际上这并非是一场「收购」。英伟达与Groq均明确表示,双方达成的是技术许可协议而非整体收购 —— 官方声明中使用了“非排他性技术许可协议(non-exclusive licensing)”这一表述。

此次交易背后是英伟达日益增加的现金资产,截至2025年10月底,英伟达持有的现金及短期投资高达606亿美元,较2023年初的133亿美元翻了近5倍。值得注意的是,截至目前,这笔交易未披露具体细节,Groq投资方曝出的“200亿美元”这一交易数据并未得到交易任何一方的确认。

但若200亿美元的收购金额传闻属实的话,将超越英伟达2019年斥资近70亿美元收购以色列芯片商Mellanox的交易金额,成为英伟达史上规模最大的收购案,展现出英伟达持续巩固自身在AI芯片领域的领导地位的野心。

非典型收购

把创始人和部分员工收入麾下,这操作是不是看起来有点眼熟?据外媒此前报道,英伟达在9月份促成了一笔类似但规模较小的交易,花费超过9亿美元吸收了AI硬件初创公司Enfabrica的CEO Rochan Sankar及其他员工,并获得了该公司的技术许可。

过去两年,亚马逊、Meta、谷歌、微软等科技巨头也曾通过各种类型的许可协议,聘请顶尖人才。在硅谷,这种通过技术授权协议来吸纳顶尖人才的“收购式招聘(Acqui-hire)”模式,已经成为科技巨头挖人才和拿技术授权的重要手段,同时还能避免触发反垄断审查。

2024年,亚马逊曾以4亿美元挖走AI初创公司Adept核心团队并获得技术授权;谷歌为AI代码生成初创公司Windsurf的非独家许可支付24亿美元,挖走CEO Varun Mohan、联合创始人Douglas Chen以及部分研发成员,随后又以27亿美元吸纳Character.AI团队;Meta斥资近150亿美元收购AI数据标注初创公司Scale AI 49%股权,Scale AI联合创始人兼CEO Alexandr Wang加入Meta,Scale AI仍保持独立运营。

本次交易后Groq创始人兼CEO Jonathan Ross、总裁Sunny Madra等核心团队将加入英伟达,以帮助推进和扩大授权技术的规模;Groq强调公司仍将作为实体独立运营,原首席财务官Simon Edwards将接任CEO,旗下云业务GroqCloud也将继续独立为软件开发者提供服务。

为何选择Groq?

Groq成立于2016年,是一家总部位于美国加利福尼亚州山景城的AI芯片生产商,由前谷歌张量处理器(TPU)首席设计师Jonathan Ross等人创立 —— TPU是谷歌用以部分替代英伟达GPU的专用AI芯片,也使Groq自诞生起就具备与英伟达竞争的技术基因。

成立伊始,Groq就专注于AI推理阶段,致力于打造高速、低延迟、低成本的AI芯片。2024年2月,Groq推出了全球首个基于LPU(Language Processing Unit,语言处理单元)方案的大模型推理芯片,LPU专为「推理」过程,即AI模型根据新数据生成答案或预测的过程,进行了优化。Jonathan Ross曾表示,得益于嵌入式内存设计,Groq的芯片在生成速度、部署效率及能耗控制上均优于GPU。

Groq表示,相对于其他云平台厂商的大模型推理性能,基于其LPU芯片的云服务器的大模型推理性能最终实现了比其他云平台厂商快18倍;在能耗方面,英伟达GPU需要大约10-30J才能生成响应中的tokens,而Groq LPU芯片仅需1-3J,在推理速度大幅提升10倍的同时,其能耗成本仅有英伟达GPU的十分之一,这等于是性价比提高了100倍。

而LPU之所以能够以惊人速度做出响应,其工作原理与GPU截然不同。在团队公开的论文中介绍,LPU采用了时序指令集计算机(Temporal Instruction Set Computer)架构,意味着它无需像使用高带宽存储器(HBM)的GPU那样频繁地从内存中加载数据,这不仅有助于避免HBM短缺的问题,还能有效降低成本。

Groq当前的芯片组采用格芯14nm工艺制造,作为一款基于全新的TSA架构的Tensor Streaming Processor (TSP) 芯片,创新芯片设计可以实现多个TSP的无缝链接,避免了GPU集群中常见的瓶颈问题,极大地提高了可扩展性。随着更多LPU的加入,性能可以实现线性扩展,简化了大规模AI模型的硬件需求,使开发者能够更容易地扩展应用,而无需重构系统。

HBM需要台积电的CoWoS封装,这是一个很大的瓶颈,而且成本极其昂贵。如果能够绕过对HBM和CoWoS的需求,芯片印制速度就会更快。如果板载集成NVLink C2C,LPU的扩展能力将远超Groq现在能做到的。英伟达看中的,不止是Groq的芯片,而是其背后的前沿技术理念和资产 —— LPU有四大核心设计原则:软件优先、可编程流式架构、确定性计算和网络、片上存储器。

软件优先:目标是简化软件开发人员最大化硬件利用率的工作,并将尽可能多的控制权交到开发人员手中。遵循这一理念,Groq在完成编译器架构设计后,才开始做芯片设计。

可编程流式架构:支持芯片内部及芯片间的流水线式流程。拥有充足的芯片间带宽,使数据传送带能够在芯片间像在芯片内部一样流畅高效地传输,无需等待计算或内存资源。

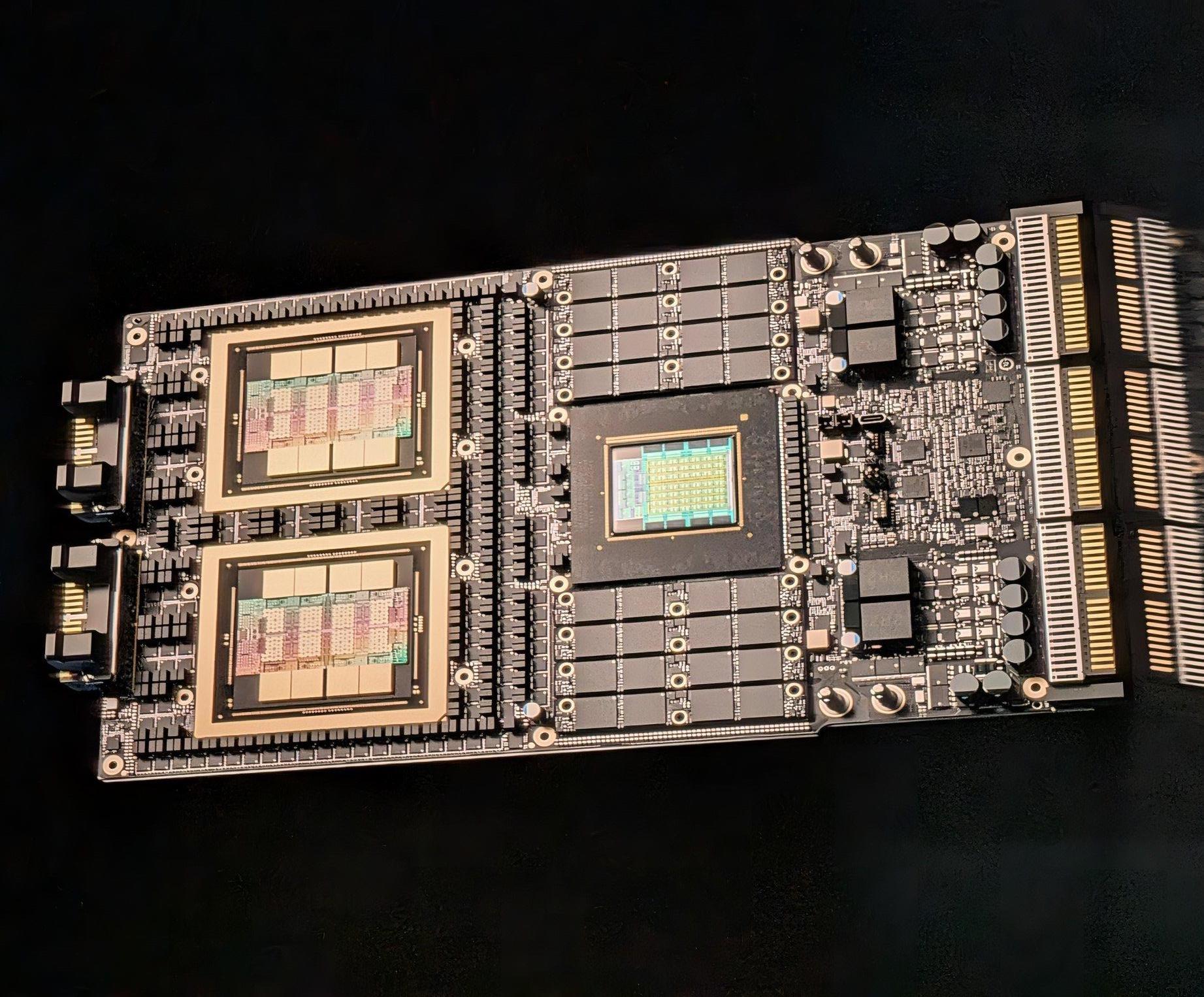

▲基于LPU的系统

对比之下,GPU采用多核“中心辐射式”架构,其低效的数据分页机制在芯片内和芯片间的计算单元和内存单元之间来回传输数据,需要大量的开销。此外,GPU还需要利用机架内部和机架之间的多层外部交换机和网络芯片进行通信,这进一步加剧了软件调度的复杂性。

确定性计算和网络:LPU架构是确定性的,这意味着每个执行步骤都可以精确到最小执行周期(也称为时钟周期)。LPU数据传送带也在芯片间运行,因此连接芯片会形成更大的可编程流水线,数据流由软件在编译期间静态调度,且每次程序运行时都以相同的方式执行。

片上存储器:LPU将内存和计算功能集成在芯片上,大幅提升了数据存储和检索速度,同时消除了时序波动。其片上SRAM的内存带宽高达80TB/s以上,而GPU片外HBM的带宽约为8TB/s。仅此一项差异就使LPU的速度提升高达10倍,再加上LPU无需往返于单独的内存芯片来检索数据,这进一步提升了其性能。

此次交易的核心还有Groq背后的明星级团队:Jonathan Ross是AI芯片领域的资深人物,曾师从AI先驱Yann LeCun。在谷歌期间,他曾发起了一个最初作为「20%项目」的内部创新计划,这一项目之后演变成为广为人知的TPU,他亲自设计并实现了第一代TPU芯片的核心架构与关键组件;随后,他加入了Google X的Rapid Eval Team,为谷歌的母公司Alphabet构思、孵化并推进多个全新的Bets(即新业务方向和独立项目)。

美国加利福尼亚州旧金山市2024年5月30日星期四举行的GenAI峰会上,乔纳森·罗斯(Jonathan Ross)作为Groq公司的首席执行官(CEO)出席

TPU目前是英伟达GPU的有力竞争方案,这笔交易看起来更像是英伟达对谷歌成功使用TPU进行AI训推所做出的直接、迅速的回应。同时,Groq和其团队的加入,除了强势补齐推理领域的短板,英伟达还实质性地削弱了一个潜在的竞争对手。

对AI推理深度布局

目前,随着AI应用从训练阶段迈向大规模部署,市场对推理芯片的需求正在急剧上升:据巴克莱研报,AI推理计算需求预计将占通用人工智能总计算需求的70%以上,推理计算的需求甚至可能达到训练计算需求的4.5倍。在今年初,黄仁勋曾在一次采访中表示“推理需求未来将增长高达十亿倍”,AI市场正处于“训练为主”向“推理为主”转型的关键期,不难看出,英伟达想要Groq补强其在高能效推理领域的短板。

根据Groq此前披露的数据显示,其已经为超过200万开发人员和众多全球领先的财富500强企业提供快速、经济的计算能力,并正在扩大其全球影响力,在北美、欧洲和中东现有的数据中心的基础上进行建设。

推理和训练本质上,是两种截然不同的计算负载,而GPU并不是最适合推理工作的解决方案。虽然在训练领域,英伟达GPU几乎垄断,但在推理领域却竞争激烈,亚马逊、谷歌、正通过自研芯片寻求独立的OpenAI和Meta Platforms以及Groq和Cerebras Systems等初创公司都在寻求突破机会。

黄仁勋在内部邮件中明确表示:“我们计划将Groq的低延迟处理器整合到英伟达的AI工厂架构中,以服务更广泛的AI推理和实时工作负载。”此次交易直接强化了英伟达在“推理”这一关键计算环节的布局,是英伟达巩固AI算力霸权、应对产业变局的精准落子,进一步巩固从训练到推理的全栈优势。当巨头开始用资本手段吸收潜在的颠覆者,留给其他玩家的窗口期或许正在收窄。

与此同时,在AI芯片领域,初创公司的生存路径正在改变:Cerebras Systems原计划今年上市,但在9月宣布完成超过10亿美元融资后,于10月撤回了IPO申请;英特尔已与SambaNova展开深入谈判,计划收购后者,而英特尔CEO陈立武曾是SambaNova的早期投资者。这似乎反映出在欧美市场,AI芯片作为独立创业形态的阶段性终结,初创公司被巨头整合可能成为最优选择。

英伟达自身也在通过投资拓宽AI生态边界,试图构建一个几乎无法被挑战的AI生态系统。今年以来,英伟达已向AI和能源基础设施公司Crusoe、模型开发商Cohere注资,并增持了即将上市的AI云服务商CoreWeave的股份;另外,还拟向OpenAI投资高达1000亿美元,并计划向英特尔注资50亿美元,英伟达的种种举措彰显了该公司的最新战略,那就是通过资本扩张构建产业联盟的深远布局。

无论如何,这笔交易已成为2025年科技领域最具标志性的事件之一,它不仅改写芯片收购史,更预示着AI硬件竞争已进入生态整合与战略卡位的新周期。英伟达能否凭借此次布局继续领跑,全球芯片产业格局又将如何演变,一切仍待时间揭晓。

估值火箭式蹿升

作为AI硬件领域的明星初创企业,Groq在过去一年中经历了估值的火箭式蹿升。若媒体提到的交易规模属实,英伟达收购就让Groq的“身价”较三个月前完成融资后的估值增长了将近两倍。2024年8月,以28亿美元估值完成6.4亿美元融资。

今年9月17日,Groq公布以约69亿美元估值完成7.5亿美元的最新一轮融资,据PitchBook估算,Groq累计融资已超30亿美元。该轮融资由Disruptive领投,自2016年Groq成立以来投资总额超过5亿美元,该投资公司过去十年曾投资Palantir、Airbnb、Spotify、Databricks、Stripe等多家成功企业。该轮融资的投资者还包括Blackroc、Neuberger Berman、德国电信资本合伙公司(Deutsche Telekom Capital Partners,DTCP)以及一家美国西海岸大型共同基金管理公司也参与了投资。此外,三星、思科、D1、Altimeter、Infinitum、美国总统特朗普之子小唐纳德·特朗普任合伙人的风投1789 Capital等现有投资者也继续跟投。

英伟达的芯片在性能上由于其专有的CUDA编程语言生态,使得客户对其产生了极高的粘性,尽管获得了数十亿美元的风险投资,包括Groq在内的挑战者们一直难以打破英伟达对高端AI芯片市场的严密控制。经过多年发展,当前被视作“颠覆者”的AI芯片创企们,纷纷迎来了如何长期生存的现实大考:上市、被收购,或者想办法拿到能持续兑现增长的超级客户订单。Groq近期的经营状况也反映了挑战巨头的难度:已大幅下调向投资者提供的业绩预期,将其预计的2025年营收从20亿美元大幅削减至5亿美元,下调超过15亿美元。

Groq联合创始人Chamath Palihapitiya在社交平台X上晒图感慨,当年Jonathan Ross说服他挑战巨头,打造新型芯片。而他们当时没有公司,只有一份投资意向书和三个人,只能尽可能多地从谷歌威斯康星分部招募TPU团队的成员。

“今天,我们结束了这段近十年的篇章,Jonathan将与英伟达开启新的篇章。”Palihapitiya写道:“Jonathan不仅是谷歌时期TPU的缔造者,更是一位技术天才,其成就堪称史诗级。他还组建了一支强大的团队,有Sunny Madra和Gavin Sherry这样的人才为他提供支持。他们在英伟达也会创造辉煌。”

随着科技大厂自主研发的底层硬件增多,整个行业都在竞逐构建更强的计算基础设施,AI推理将成为AI商用的主要算力消耗和利润压力来源。推理规模持续爆发式增长,几乎所有大厂都必须关心“每token成本”。前瞻嗅觉敏锐的英伟达,长期在构建一个更完备的AI计算产品“军火库”,提前把可能有利于加速AI产业发展的各种技术方向纳入自身的能力池。通过将新型LP

评论