据《金融时报》报道,因美中两国的监管壁垒持续让英伟达对中国市场的芯片销售前景蒙上阴影,该公司已暂停生产面向中国市场的人工智能芯片,并将台积电的制造产能调配至其下一代 Vera Rubin 芯片平台。此次从 H200 芯片向 Vera Rubin 架构的产能转移,意味着在经历了数月来美国出口审批的不确定性以及中国可能出台的限制措施后,英伟达认为短期内 H200 芯片在中国市场难有可观需求。监管不确定性催生战略转向H200 是英伟达的一款早期一代 AI 处理器,原本是为符合美国先进半导体出口管制规定而设计。今

关键字:

英伟达

H200

台积电

Vera Rubin

路透社报道,在市场传闻深度求索(DeepSeek)计划于农历新年假期期间发布其下一代AI大模型之际,中国已向这家头部初创公司发出有条件批准,允许其采购英伟达(NVIDIA)的H200 AI芯片,但具体监管条款仍在最终敲定中。深度求索可能并非唯一获准的企业。路透社此前曾报道,包括字节跳动、阿里巴巴和腾讯在内的其他中国科技巨头也已获得授权,合计可采购超过40万颗H200芯片。报道称,中国工业和信息化主管部门已对这四家公司发放了采购许可,但均附带条件,相关细则尚在完善。据一位消息人士透露,这些具体条款正由中国的

关键字:

Deepseek

英伟达

H200

1月26日消息,今天,中国又一家GPU公司宣布,旗下产品预期于2027年超越英伟达Rubin架构。今天,天数智芯公布四代芯片架构路线图,预期于2027年超越英伟达Rubin架构。具体来说,2025年,天数天枢架构超越Hopper(H200系列);2026年,天数天璇架构对标Blackwell(B200);2026年,天数天玑架构超越Blackwell;2027年,天数天权架构超越Rubin;2027年之后将转向突破性计算芯片架构设计。同时,天数智芯推出"彤央"系列边端算力产品,在计算机

关键字:

H200

国产GPU

四代芯片

架构路线图

英伟达

Rubin架构

根据白宫发布的一份情况说明书,美国总统唐纳德·特朗普周三宣布对“某些先进计算芯片”征收25%的新关税。这些芯片包括英伟达的H200芯片和AMD的MI325X芯片。根据行政命令内容,关税适用于进口至美国、但未用于国内人工智能用途,随后再出口至其他国家的半导体产品,这类做法被称为“转运”。该措施设定了许可要求,寻求出口许可的公司必须证明,为中国客户生产芯片不会挤占原本可用于为美国国内买家生产芯片的产能,且不得将这些芯片用于军事用途。另外,向中国出口芯片的数量将受到限制,不得超过其面向美国市场生产产品总量的50

关键字:

芯片

英伟达

AMD

H200

MI325X

美国商务部周二表示,美国政府已批准芯片巨头英伟达在中国销售其先进的人工智能(AI)处理器。H200是英伟达的第二先进半导体,华盛顿曾因担心其会让中国科技产业和军方在优于美国时获得优势而受到限制。商务部表示,只要美国有足够的处理器供应,这些芯片可以运往中国。唐纳德·特朗普总统上个月表示,他将允许芯片销售给中国的“批准客户”,并收取25%的费用。英伟达发言人告诉BBC,公司欢迎此举,称这将有利于制造业和美国的就业。美国商务部工业与安全局表示,其修订后的出口政策适用于英伟达的H200芯片以及较不先进的处理器。中

关键字:

英伟达

人工智能芯片

进口管控

H200

AI驱动的需求正在重塑内存市场,随着供应紧张,HBM3E价格预计将持续上涨。据Chosun Biz报道,继NVIDIA获准向中国销售H200 AI芯片的消息后,三星电子和SK海力士已将2026年HBM3E供应价格上调近20%。报告指出,这样的价格上涨被认为是不寻常的。尽管HBM3E今年成为HBM市场的主流产品,且随着HBM4明年上市,价格预计将会回落,但包括NVIDIA在内的全球大型科技公司持续推出基于HBM3E的AI加速器,使需求保持稳步增长。H200出口批准后HBM3E需求激增报告强调的一个关键因素是

关键字:

三星

英伟达

H200

有报道称NVIDIA计划于明年二月中旬开始向中国出口H200芯片,中国顶级科技公司似乎正在加快人工智能投资。《金融时报》报道,TikTok母公司字节跳动正准备在2026年增加人工智能投资,初步计划为今年分配1600亿元人民币(230亿美元)资本支出。报告称,拟议的投入较今年在人工智能基础设施上的1500亿元人民币有所增加。值得注意的是,报告引用的消息人士透露,字节跳动计划在2026年专门为AI处理器拨款850亿元人民币,尽管中国领先科技公司是否能获得NVIDIA芯片仍存在不确定性。此消息发布之际,据报道英

关键字:

字节跳动

AI

H200

据知情人士透露,英伟达已告知中国客户,计划在2月中旬春节假期前开始向中国市场交付H200 AI芯片。另外,还计划增加该芯片的产能,相关订单将于2026年第二季度开始接受。但是,目前仍存在很大的不确定性,时间表可能会根据政府的决定而有所调整,消息人士表示“在获得官方批准之前,一切都还未确定”。H200属于英伟达上一代Hopper系列,英伟达已将生产重心转移到最新的Blackwell及其即将推出的Rubin系列芯片上。预计英伟达将从现有库存中交付首批订单,出货量为5000-10000个芯片模块,相当于约400

关键字:

英伟达

H200

芯片

Hopper

Blackwell

AI

虽然这个月初美国政府提案拟允许英伟达可以将H200芯片向中国大陆出口,但实际上H200要出口到中国大陆市场目前至少还需要闯三关,首先是美国政府的批准,其次是中国政府是否同意进口,第三关则是中国企业是否有意愿购买。这三关中的任何一关闯不过去,英伟达都可能再次无缘中国AI市场。表面上看,最容易的是第一关,美国政府的批准,但H200作为目前英伟达第二强大的AI应用处理器,严格意义上并不能算是落后两代的产品,虽然按英伟达发布的产品路线确实是落后两代的产品,但就供货时间来说,H200属于2024年才开始供货的产品。

关键字:

H200

英伟达

据知情人士透露,由于H200芯片订单量超出其现有产能,英伟达已告知中国客户正在评估增加产能。值得注意的是,此前美国总统特朗普表示美国政府将允许英伟达向中国出口AI芯片H200,条件是收取25%的销售佣金。英伟达发言人表示:“我们正在管理供应链,以确保向中国授权客户销售H200芯片不会影响我们向美国客户供货的能力。”消息人士表示,作为英伟达简报的一部分,该公司还提供了当前供应水平的指导,但未提供具体数字。2024年H200芯片开始大规模部署,由台积电4nm制程工艺制造,是英伟达上一代Hopper架构中最快的

关键字:

英伟达

H200

芯片

Hopper

Blackwell

特朗普已批准向中国销售H200,但这一安排引发了担忧。据《华尔街日报》报道,出口的芯片必须在运输前经过美国特别的安全审查。因此,主要在台湾制造的H200芯片将先送往美国进行国家安全筛查,然后再转交给中国。报道补充说,这种不寻常的运输方式引发了关于其是否与美国政府要求获得25%销售份额有关的讨论。正如报告引用消息来源指出的,由于宪法禁止出口税,官员们必须谨慎设计这一安排,以避免被归类为出口税,而芯片通过美国则允许政府将25%的税收归类为进口关税而非出口税。对25%征收责任的不确定性《经济日报》指出,谁将承担

关键字:

H200

特朗普

芯片

关税

据路透社报道,特朗普政府正在考虑批准向中国出售英伟达H200人工智能芯片。多名消息人士透露,负责监管美国出口管制的商务部(Commerce Department)正在重新审查向中国出售此类芯片的政策,不过也强调调整这项政策的计划仍可能发生变化。H200芯片于两年前发布,比其前身H100拥有更高的内存带宽,使其能够更快地处理数据。据估计,它的性能是被称为专为中国市场设计的“阉割版”H20芯片的两倍。而H20芯片是华盛顿目前批准出口到中国的最先进的人工智能半导体,此前特朗普政府在今年早些时候撤销了对该类产品短

关键字:

英伟达

H200

(图片版权:Getty / Bloomberg)尽管英伟达的 H100 和 H200 GPU 现在已经是一个时代的旧产品,但它们仍然热销。它们的需求很大程度上是基于 AI 应用在行业中的需求激增,加上英伟达基本上是唯一能够以这种速度供应高质量 AI 加速器的公司。在过去的一周里,各种报道描述了 H100/H200 GPU 的短缺,这可能是部分由 CEO 黄仁勋在公司财报电话会议上的评论所推动。然而,英伟达现在已出面澄清,称这些芯片并没有售罄。表面上,这种立场似乎与英伟达 CEO 黄仁勋上周在公司财报电话会

关键字:

GPU

英伟达

H200

根据TrendForce集邦咨询最新研究,由于对NVIDIA(英伟达)核心产品Hopper

GPU的需求提升,英伟达数据中心业务带动公司整体营收于2025财年第二季逾翻倍增长,达300亿美元。根据供应链调查结果显示,近期CSP(云端服务业者)和OEM(原始设备制造商)客户将提高对H200的需求,预计该GPU将于2024年第三季后成为NVIDIA供货主力。根据NVIDIA财报显示,FY2Q25数据中心业务营收年增154%,优于其他业务,促使整体营收占比提升至近88%。TrendForce集邦咨询预计,2

关键字:

H200

AI服务器

英伟达

TrendForce

11月13日,英伟达推出新一代AI旗舰芯片H200,是在目前市场上最强AI芯片H100的基础上进行了大升级。H200拥有141GB的内存几乎是H100最高80GB内存的2倍,4.8TB/s的带宽也显著高于H100的3.35TB/s。在推理速度上H200几乎达到了H100的两倍,英伟达表示根据使用Meta的70B大模型Llama 2进行测试,H200的输出速度几乎是H100的两倍。根据官方发布的图片,H200在大模型Llama 2、GPT-3.5的输出速度上分别是H100的1.9倍和1.6倍,在高性能计算H

关键字:

英伟达

AI

芯片

H200

AMD

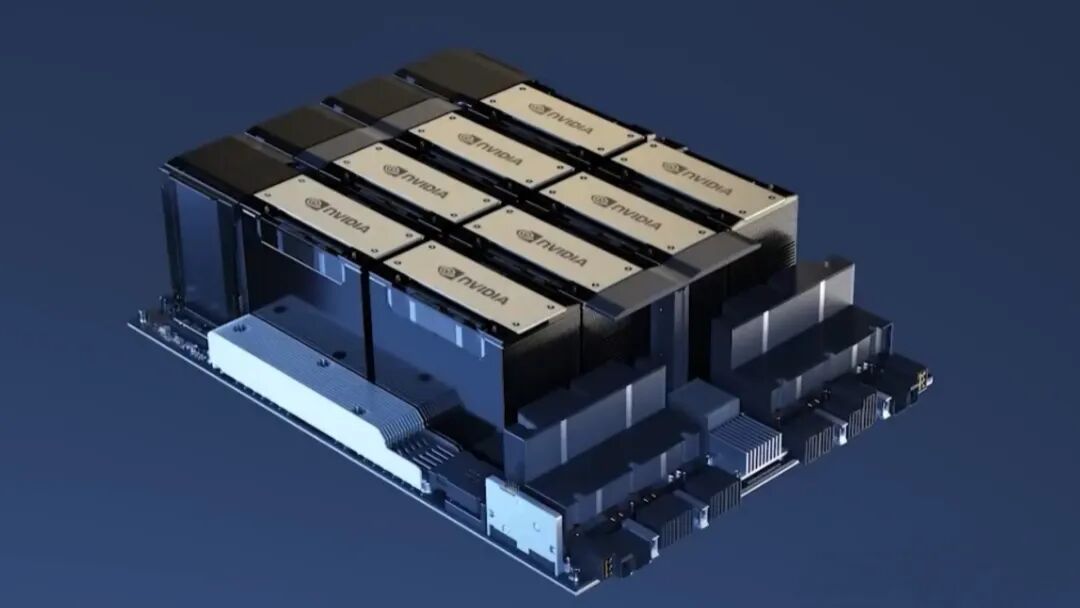

当地时间 11 月 13 日,英伟达宣布推出 NVIDIA HGX™ H200,为全球领先的 AI 计算平台带来强大动力。该平台基于 NVIDIA Hopper™ 架构,配备 NVIDIA H200 Tensor Core GPU 和高级内存,可处理生成 AI 和高性能计算工作负载的海量数据。H200 将于 2024 年第二季度开始向全球系统制造商和云服务提供商供货。NVIDIA H200 是首款提供 HBM3e 的 GPU,HBM3e 是更快、更大的内存,可加速生成式 AI 和大型语言模型,同时推进 H

关键字:

英伟达

H200

当地时间11月13日,英伟达(NVIDIA)宣布推出NVIDIA HGX™ H200,旨为世界领先的AI计算平台提供强大动力,将于2024年第二季度开始在全球系统制造商和云服务提供商处提供。H200输出速度约H100的两倍据介绍,NVIDIA H200是基于NVIDIA Hopper™架构,配备具有高级内存的NVIDIA H200 Tensor Core GPU,可处理海量数据,用于生成式AI和高性能计算工作负载。图片来源:英伟达与H100相比,NVIDIA H200对Llama2模型的推理速度几乎翻倍。

关键字:

英伟达

H200

HBM3e

HBM3

IT之家 11 月 13 日消息,英伟达今日发布了下一代人工智能超级计算机芯片,这些芯片将在深度学习和大型语言模型(LLM)方面发挥重要作用,比如 OpenAI 的 GPT-4。新芯片相比上一代有了显著的飞跃,将被用于数据中心和超级计算机,处理诸如天气和气候预测、药物发现、量子计算等任务。此次发布的关键产品是基于英伟达的“Hopper”架构的 HGX H200 GPU,是 H100 GPU 的继任者,也是该公司第一款使用 HBM3e 内存的芯片,这种内存速度更快,容量更大,因此更适合大型语言模型

关键字:

英伟达

GPU

计算平台

H200

h200介绍

您好,目前还没有人创建词条h200!

欢迎您创建该词条,阐述对h200的理解,并与今后在此搜索h200的朋友们分享。

创建词条

关于我们 -

广告服务 -

企业会员服务 -

网站地图 -

联系我们 -

征稿 -

友情链接 -

手机EEPW

Copyright ©2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

《电子产品世界》杂志社 版权所有 北京东晓国际技术信息咨询有限公司

京ICP备12027778号-2 北京市公安局备案:1101082052 京公网安备11010802012473