基于FPGA的视频监控时代

图像信号处理(ISP)

图像信号处理器(ISP)通常由多个视频处理算法组成,对输入的视频流,以集束流水线的形式执行图像增强和转换功能。图像流水线可以实现为软件在计算机,FPGA或数字信号处理器(DSP)上运行,或作为一个专用应用标准产品(ASSP)。

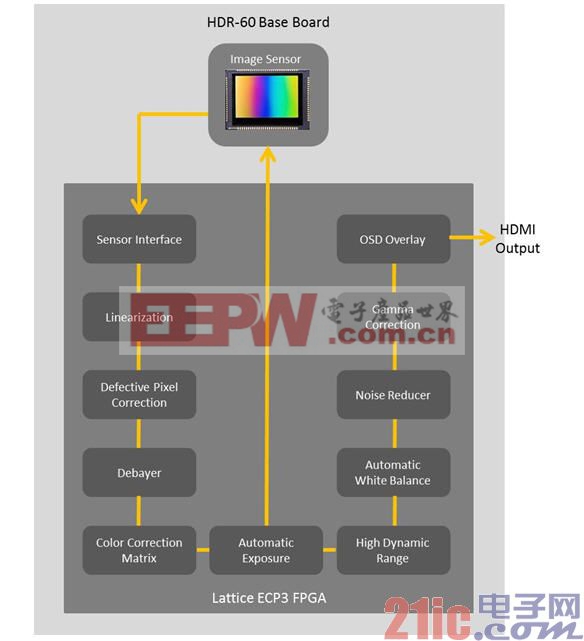

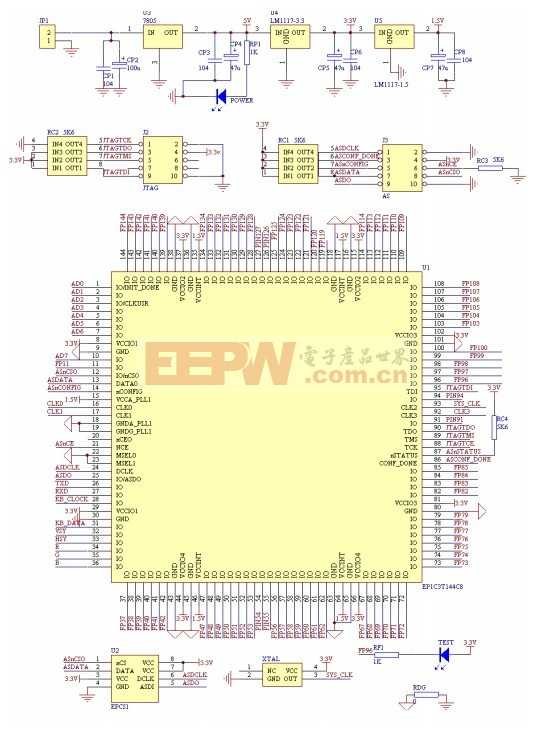

图3 用FPGA实现的图像信号处理器(ISP)流水线

图3中展示了一个典型的图像处理流水线。从CMOS图像传感器接收到原始的传感器数据。线性化之后,根据与它们相邻的像素值校正有缺陷的传感器像素。典型的图像传感器提供了灰度图像,通过使用bayer滤波器(称为de-bayering)转换成红,绿和蓝色。彩色校正矩阵(CCM)用来消除红色,绿色和蓝色像素之间的色度亮度干扰。

自动曝光(AE)模块自动调整曝光时间,以弥补不断变化的光照情况。HDR算法改进了图像的亮和暗区域的对比度(HDR将在下一节中做更详细的解释)。自动白平衡(AWB)根据场景中的一个白色参考点对所有颜色作出调整。噪声减小器消除噪声,在不同的平滑颜色的区域常可见有明显错误颜色的随机点。噪声随着温度和曝光时间而增大。伽玛校正重新分配原本的摄相机色调级到更均匀的和更适合人眼观看的水准,从而最有效地使用一个给定位的深度。

重叠功能使得文本和图形能够在视频的顶部重叠,用于显示菜单或摄相机的设置。根据特定的要求,可以添加额外的功能模块。可以变化压缩算法H.264或JPEG来达到这些要求,可运用运动检测、目标检测,或人脸识别来进行智能视频分析。

HDR处理

图像的质量取决于各种因素,包括照明。根据照明情况,场景的部分区域可能太暗,而有些区域太亮。在这些区域往往看不到细节。丢失的细节可能在应用中是非常重要的,那里需要作出关键的决策。

图4 HDR处理实例

动态范围(也称为图像的最大对比度)描述图像的最亮点到相同图像最暗点之间的比率。人的眼睛能够看到这两个区域中的细节,但大多数图像传感器具有有限的动态范围,并且不能够捕捉相同图像在这两个区域中的细节。为了能够在高对比度区域看到细节,需要捕获具有不同的曝光时间的同一场景的多个图像。需要很短的曝光时间以捕获非常明亮的区域,需要长曝光时间以捕获暗的区域。

具有不同曝光时间的图像可以被组合成一个图像,提高了图像的动态范围。不同曝光时间的场景捕获和这些图像整合为一个图像被称为高动态范围(HDR)处理,也被称为宽动态范围(WDR)处理。HDR处理、全局和局部的色调映射算法被用来创建单一的图像,扩展了动态范围,在相同图像的高对比度区域中显示出细节。动态范围通常以dB表示。好的HDR图像的动态范围大于或等于90。例如,Aptina720p HDR传感器(MT9M034)的动态范围为120dB。

评论