AI的下一主战场:手机与物联网终端

手机与物联网终端市场潜力大

本文引用地址:https://www.eepw.com.cn/article/201707/361721.htm现在人工智能(AI)刚刚兴起,很多公司关注自动驾驶,或到ImageNet ILSVRC比赛上去显示实力,或进行下棋。同时应该更关注AI实际为人们带来了什么,例如现在已经成熟的手机,以及正在兴起的物联网终端市场的机会。 “如果有想创业的企业家,可以向这些方向想象,这方面的潜力非常大。”美国高通公司产品市场资深经理刘学徽先生对电子产品世界的记者说。

近日,刘学徽经理出席了在京举办的“人工智能与芯片高峰论坛”,并发表了“终端设备上的人工智能”的主旨讲演。该论坛由电子产品世界、启迪之星和洪泰智造工厂联合主办。

刘学徽经理指出,中国每年大约有6亿部手机出货,如果这6亿部手机中有10%用上了人工智能算法实现的功能,收益将十分惊人,对于厂商来说其收入也是相当可观的。另外,目前手机通过滑屏、触屏等方式控制,未来通过语音算法和语音识别,实现手机控制的方式将会慢慢流行起来。通过AI技术,未来手机还可以了解用户的喜好、自动帮助打开App,也可以作为一些广告的推荐入口等。

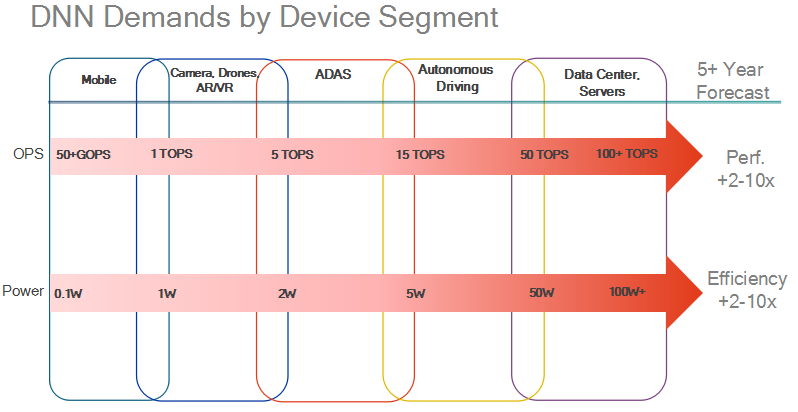

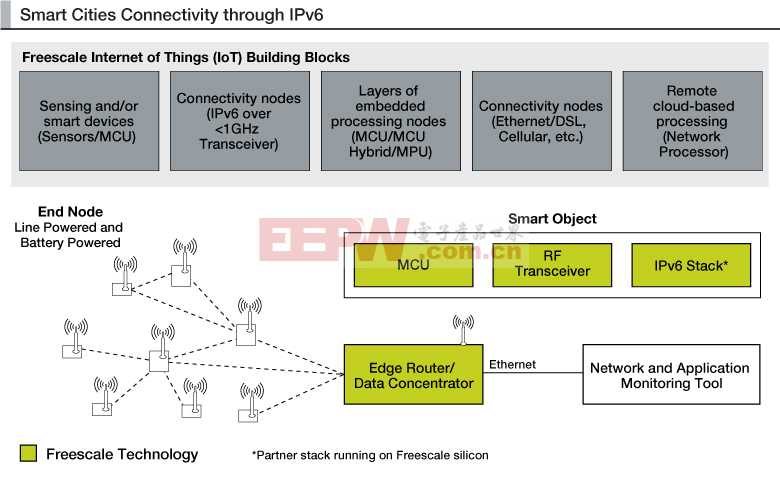

现在大家热衷谈论云计算,但人工智能运算并不是所有场合都适合云端处理,有些需要在传感器端附近立即计算。例如无人机、自动驾驶、IP camera(摄像头)、手机拍照等。因为无人机和自动驾驶需要实时避障,而IP camera的人脸识别如果完全在云上计算,从原始图像采集,之后压缩、传输、解压,算完再把结果告诉端,这非常浪费时间时间。在手机中,拍照前要对手机预览、对焦,也一定是在终端上运算。

在厂商近期发布的最新智能手机当中,有些型号采用了背景虚化技术,使拍摄效果达到了单反效果,这其实就用到了AI算法开发的功能。实际上,手机上还有很多功能可以利用AI技术,例如拍照的美颜,还有人脸识别方面,是采用10个特征点,还是一二百个特征点、四百个特征点,对人脸识别的效果会不同。可把这些算法在云上培训好,然后转移置到手机上运行。

在VR/AR方面,目前存在的瓶颈之一是用户缺乏存在感体验,没有定位。如果把AI加入VR终端,戴着头盔可以看到自己的手和脚。根据你的摄像头的移动,可以看到周围的物体。其方法是头盔/眼镜外装个摄像头,假设识别周边有一个凳子,那么在人的视野里放一个虚拟凳子,这样效果更逼真。在直播社交娱乐场景中,主播跳舞时的头饰因为延时常常跟不上脸部的移动;另外如果人在移动,聊天的效果也大打折扣。如果在端上做AI运算,效果会大大提升。

骁龙神经元处理引擎SDK

Qualcomm提供了专为端上运行神经元网络的骁龙神经元处理引擎(Snapdragon Neural Processor Engine)简称SNPE。 目前在Qualcomm® 骁龙 600系列部分平台和820、835上都得到了支持。通过这个引擎,算法可以运行在GPU和DSP上,速度和功耗相对CPU可以得到大幅提升。目前支持的架构有Caffe,Caffe 2,Tensorflow,我们提供转化工具和benchmark工具,方便算法厂商的开发调试。

以Qualcomm® 骁龙TM 835移动平台上的测试为例,得到的结果是同样的神经元网络,在GPU上运行比CPU上运行平均快4倍,在DSP上运行比CPU快16倍;功耗上, 在GPU上运行的功耗是CPU上的1/8,在DSP上运行的功耗是CPU上的1/25。

使用SNPE SDK的基本流程是以TensorFlow、caffe、caffe2做的模型,配置调用GPU,DSP或CPU的API,然后通过转换工具转换成在DLC格式,再通过SDK让算法在骁龙移动平台三种内核上运行,实现各种各样的功能,例如人脸识别、语音识别、文字识别等功能。换言之,Qualcomm SNPE SDK中提供了现成算法和函数,诸如卷积、池化等常用函数都已将做好,算法开发者直接调用即可。同时还支持用户定义层(User Defined Layer, UDL)。

关于软件算法,值得一提的是,过去是传统算法,现在基于机器学习的算法,速度更快效果更好,而且功耗更低,开发更为方便。此外随着算法的进步,对硬件的依赖度降低,例如要拍照清晰,过去通常要高像素分辨率,现在可以不用很贵的硬件,依靠算法提升效果。

终端与云端相辅相成

那么,相比市面上的一些硬件处理器,高通的特色及与他们的关系是什么?

目前AI芯片有两种形态,一种是像Qualcomm一样是做在一个SoC中,特点是体积更小、功耗更低,运算速度快,因为CPU、GPU和DSP等计算内核都做在一个SoC上,会对数据搬移、延迟和功耗等进行优化。未来随着运算要求的提升,也许会出现专门运算Neural Network(NN,神经网络)的核。第二种形态,是一些公司做的所谓的AI芯片,实际上是在主处理器外做的协处理器,因此主芯片和外置芯片之间的大量数据搬移、交互等将是挑战。

同样是NN芯片,各家的定位是有差异化的。例如FPGA较为适合在云上或车载等对功率和体积不太讲究的应用场景。一些IP公司也推出了AI架构和指令集,但目前还没有到定论时。因为各种技术都是演进过程中,最终要看市场的选择。

Qualcomm与很多云端处理器厂商是相辅相成的关系。例如云端处理器的GPU非常强大,培训/training做得非常好,但功耗不理想,据悉某专用神经元网络芯片功耗高达30W。云端适合模型的培训,训练后的结果可转移到端去运行。骁龙终端芯片目前不做培训,但十分擅长运行。 “我们的生态成长有赖于云端,云端的模型做得越好,越有利于我们AI技术的实现和落地。”刘学徽经理强调。

已与Facebook合作

实际上,Qualcomm® 骁龙TM 移动平台在手机端也有靓丽的业绩。例如今年4月18日,Facebook 和高通宣布合作支持 Facebook 开源深度学习框架 Caffe2 和Qualcomm® 骁龙TM 神经处理引擎(NPE)框架的优化。Facebook将在其所有安卓应用中集成SNPE SDK, 运行在骁龙移动平台上时,比没有SNPE的速度提升5倍。

随着中国手机与AI的发展,期待会有更多的中国算法公司开发手机上AI应用!

评论