智能体AI(Agentic AI)不止需要GPU

核心要点

智能体 AI 工作负载正在重塑数据中心算力需求,性能瓶颈从以 GPU 为中心的推理转向CPU 密集的调度与工作流管理。

传统 AI 推理是单步前向传播,而智能体 AI 是分布式、多步骤、带规划 / 工具调用 / 验证 / 迭代推理的复杂流程,对 CPU 需求激增。

实测显示:在金融异常检测、AI 代码生成等场景中,CPU 耗时超过 GPU 推理,仅靠提升 GPU 性能无法优化整体吞吐。

数据中心需保持CPU 与 GPU 均衡配比,推荐比例为 1:1 到 1.4:1,即每颗 GPU 配 86–120 个 CPU 核心。

未来智能体架构中,CPU 将成为核心瓶颈,企业必须放弃纯 GPU 扩容思路,转向CPU+GPU 均衡架构设计。

智能体 AI 工作负载正重塑现代数据中心基础设施的算力需求,性能瓶颈从以 GPU 为中心的推理,转向CPU 密集的调度与工作流管理。

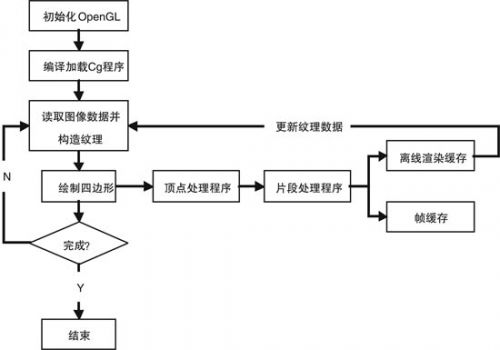

传统 AI 推理流水线主要依赖 GPU 执行单次前向传播,输入分词、模型执行、输出生成按顺序完成。而新兴的智能体 AI 系统将推理转变为分布式、多步骤流程,包含规划、工具调用、验证与迭代式推理。这种架构变革带来了巨大的 CPU 需求,使CPU 容量成为保障系统吞吐与整体成本效率的关键因素。

在智能体工作流中,CPU 承担调度任务:控制流管理、分支逻辑、重试机制、多智能体与外部服务协同。每次智能体调用都可能需要与数据库、API、搜索引擎或向量库交互,这些都会产生额外的 CPU、内存与 I/O 开销。此外,重推理负载通常需要沙箱执行环境用于验证与测试。这些循环形成多轮对话工作流,CPU 直接决定端到端吞吐。

当 CPU 资源不足时,昂贵的 GPU 会在等待预处理、工具执行或验证步骤时闲置,导致加速硬件利用率极低。

实验基准测试充分证明了 CPU 在智能体流水线中的重要性。

在一个模拟监管文件分析的金融异常检测工作流中,CPU 负责数据加载、基线计算、异常检测、文档检索与网络搜索增强。结果显示:CPU 操作占据总运行时的主导,仅信息增强环节耗时就远超基于 GPU 的模型推理步骤。这表明:仅靠推理加速无法优化性能,系统必须在CPU 调度与 GPU 计算之间保持平衡。

第二项针对 AI 辅助代码生成的基准测试进一步揭示了 CPU 瓶颈。在该流程中,GPU 生成候选方案,而 CPU 在沙箱环境中执行并验证代码。在超过 2000 个任务中,即便使用高核心数系统,基于 CPU 的沙箱执行耗时仍略高于 GPU 代码生成。CPU 阶段包含子进程管理、测试执行与结果分析,说明在智能体系统中,验证循环耗时可媲美甚至超过推理时间。

这些发现表明:若不同步扩容 CPU,仅提升 GPU 性能无法改善整体吞吐。

从这些实验得出的基础设施规模建议强调:必须保持CPU 与 GPU 配比均衡。

当前推荐比例为 CPU:GPU = 1:1 至 1.4:1,相当于每颗 GPU 配备约 86–120 个 CPU 核心,具体取决于工作负载特征。生成 Token 更快的小模型需要更多 CPU 容量以保持 GPU 满载;更强力的 CPU 则可降低所需配比。未来高性能 GPU 会进一步提升 CPU 需求,调度复杂度上升时配比可能继续提高。

其影响远超性能优化。CPU 资源配置不足会导致调度延迟、工具执行变慢、验证循环滞后,进而降低 GPU 利用率、抬高运营成本。反之,扩容 CPU 可保障持续的数据准备、协同与验证,让 GPU 以最高效率运行。这种系统级平衡类似微服务架构 —— 整体性能取决于最慢组件,而非最快组件。

核心结论

随着智能体 AI 持续演进,CPU 在推理基础设施中将扮演越来越核心的角色。

从单步推理向多步骤工作流的转变,让调度、协同与运行时管理的价值大幅提升。

因此,部署智能体系统的企业必须重新审视传统以 GPU 为中心的扩容策略,转而设计配备充足 CPU 容量的均衡架构。

通过让 CPU 与 GPU 资源匹配,数据中心可维持吞吐、减少加速器闲置,并优化下一代 AI 部署的总拥有成本(TCO)。

一句话总结:智能体 AI,更需要 CPU。

评论