这7 个深度学习实用技巧,你掌握了吗?

▌ 两全其美的办法

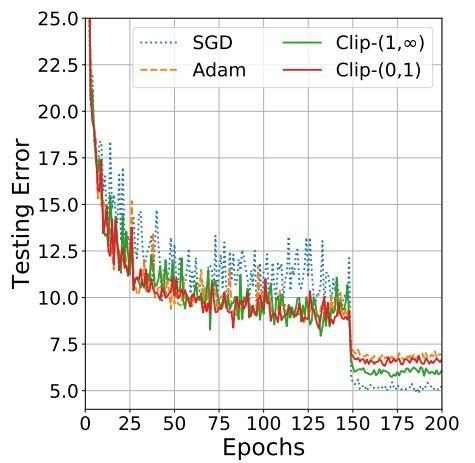

最近已经证明,可以得到两全其美的结果:从 Adam 到SGD的高性能高速训练! 这个想法是,实际上由于在训练的早期阶段SGD对参数调整和初始化非常敏感。 因此,我们可以通过使用Adam来开始训练,这将节省相当长的时间,而不必担心初始化和参数调整。 那么,一旦Adam获得较好的参数,我们可以切换到SGD +动量优化,以达到最佳性能!

Adam vs SGD 性能

▌ 3-如何处理不平衡数据

在很多情况下,都要处理不平衡的数据,特别是实际应用程序中。 一个简单而实际的例子如下:训练您的深度网络以预测视频流中是否有人持有致命武器。 但是在你的训练数据中,你只有50个拿着武器的人的视频和1000个没有武器的人的视频! 如果你只是用这些数据来训练你的网络,那么你的模型肯定会非常偏向于预测没有人有武器!

你可以做用以下的方法来解决它:

在损失函数中使用类权重。 本质上就是,让实例不足的类在损失函数中获得较高的权重,因此任何对该类的错分都将导致损失函数中非常高的错误。

过度采样:重复一些实例较少的训练样例,有助于平衡分配。 如果可用的数据很小,这个方法最好。

欠采样:一些类的训练实例过多,可以简单地跳过一些实例。 如果可用数据非常大,这个方法最好。

为少数类增加数据。可以为少数类创建更多的训练实例! 例如,在前面检测致命武器的例子中,你可以改变属于具有致命武器的类别的视频的颜色和光照等。

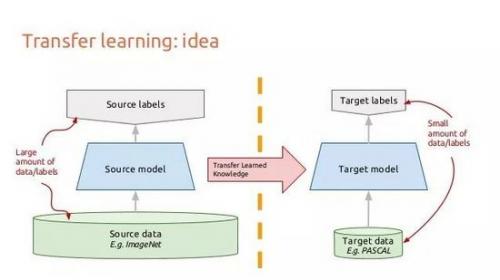

▌ 4-迁移学习

正如我们所看到的,深层网络需要大量的数据。遗憾的是,对于许多新的应用程序来说,这些数据可能很难得到并且开销很大。 如果我们希望模型表现良好,可能需要数万或数十万个新的训练样例来进行训练。 如果数据集不易获取,则必须全部手动收集并标记。

这就是迁移学习的起点。 通过迁移学习,我们不需要太多的数据! 这个想法是从一个在数百万图像上训练过的网络开始的,比如在ImageNet上预训练的ResNet。 然后,我们将“重新调整ResNet模型,只重新训练最后几层。

我们将ResNet从数百万图像中学到的信息(图像特征)进行微调,以便将其应用于不同的任务。 因为跨域的图像的特征信息经常是非常相似的所以这个方法是可行的,但是这些特征的分析根据应用而不同。

一个基本的迁移学习示例

▌ 5 – 用数据增强提高性能

前面已经说过:更多的数据=更好的表现。 除了迁移学习之外,另一种快速而简单提高模型的性能的方法是数据增强。 数据增强是使用原始类别标签的同时,改变数据集的原始图像以合成一些新的训练示例。例如,用于图像数据增强的常见方式包括:

水平和/或垂直旋转翻转图像

改变图像的亮度和颜色

随机模糊图像

随机从图像裁剪块

基本上,你可以进行任何改变,改变图像的外观但不改变整体内容,例如你可以使用蓝色狗的照片,但你仍然应该能够清楚地看到,这是一个狗的照片。

数据增强

▌ 6-通过集成提升模型!

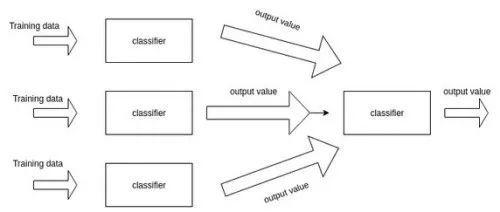

在机器学习中,集成训练多个模型,然后将它们组合在一起以获得更高的性能。 这个想法是在相同的数据集上对同一任务训练多个深度网络模型。 然后,模型的结果可以通过投票进行组合,即具有最高票数的类胜出。

为了确保所有模型不同,可以使用随机权重初始化和随机数据增强。众所周知,由于使用了多个模型,因此集成通常比单个模型更精确,从而从不同角度完成任务。在实际应用中,尤其是竞赛中,几乎所有顶级模型都使用集合方式。

集成模型

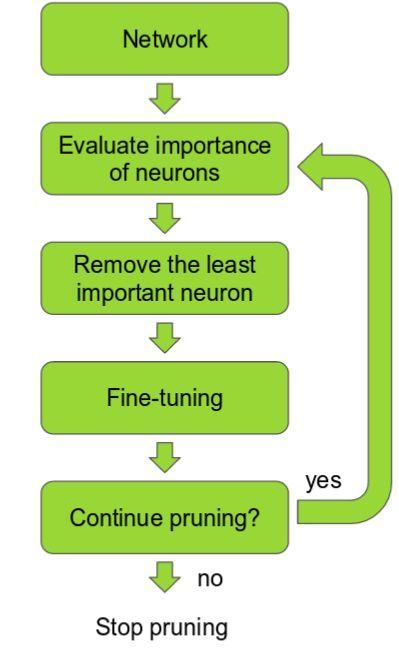

▌ 7-加快剪枝

我们知道模型精度随深度而增加,但速度又如何呢? 更多的层意味着更多的参数,更多的参数意味着更多的计算,更多的内存消耗和更慢的速度。理想情况下,我们希望在提高速度的同时保持高精度。我们可以通过剪枝来做到这一点。

深度神经网络剪枝策略

这个想法是,网络中的许多参数是多余的,对输出没有太大贡献。 如果可以根据贡献值对网络中的神经元进行排名,那么就可以从网络中移除低排名的神经元,从而形成更小更快的网络。 可以根据神经元权重的L1 / L2均值(平均激活)、一些验证集上神经元不为零的次数以及其他方法来进行排序。 获得更快/更小的网络对于在移动设备上运行深度学习网络非常重要。

修剪网络的最基本的方法是简单地放弃某些卷积滤波器。 最近文章表明,这样做是相当成功的。 这项工作中的神经元排名相当简单:每个滤波器的权重按照L1规范排名。 在每个修剪迭代中,对所有的过滤器进行排序,在所有层中修剪m个排名最低的过滤器,重新训练和重复!

最近的另一篇分析残差网络结构的论文中提出了修剪“过滤器”的关键特点。 作者指出,在删除层的时候,具有残差快捷连接(例如ResNets)的网络比不使用任何快捷连接(例如VGG或AlexNet)的网络在保持良好的准确性方面更为稳健。这个有趣的发现具有重大的实际意义,因为它告诉我们,在修剪网络进行部署和应用时,网络设计至关重要(例如ResNets)。 所以使用最新最好的方法总是很好的!

评论