Meta 可以通过脑电波猜测你听到了什么

新的人工智能可以仅仅通过大脑测量猜测出正确的、被测者正在想象的单词。

Meta 的研究科学家让-雷米·金 (Jean-Rémi King) 告诉《时代》杂志,有许多不好的因素会剥夺某人的说话能力——对这些受到影响的人来说,脑机接口可能是恢复沟通的关键。

“通过在患者大脑的运动区域放置一个电极,我们可以解码活动并帮助患者与世界其他地方交流,”King 说。

大脑植入物使用这样的方法恢复瘫痪患者的交流能力:神经植入物不需要指向单个字母或单词,而是将他的想法直接转化为单词。

患有 ALS 的澳大利亚人 Phiip O'Keefe 拥有一个脑机接口芯片,可以让他将自己的想法转化为文本,从而打开了包括Twitter在内的整个电子通信世界。此外,一名 ALS 进展为完全闭锁综合征的患者也接受了一种允许交流的植入物。

Meta 的研究人员正在构建用于在大脑中解码语音的 AI 模型。

“但是将电极放入某人的大脑中显然是极具侵入性的。” King 说。

(在 O'Keefe 的案例中,值得注意的是,植入物是通过他的颈静脉进入的,因此他不需要进行开颅手术,尽管这是一项重大手术。)

“所以我们想尝试使用非侵入性的大脑活动记录。最终目标是建立一个人工智能系统,可以解码大脑对口述内容的反应。”

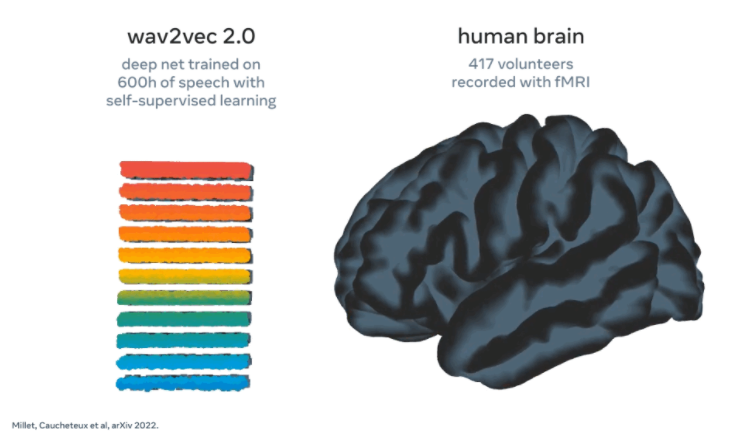

Facebook 人工智能研究 (FAIR) 实验室的 King 和他的同事已经开始这样做,他们创造了一种深度学习 AI,能够在一定程度上从脑电波中解码语音。

King 在Meta AI 的博客中写道,在他们目前作为预印本在线的研究中,该团队使用了之前在 FAIR 创建的开源算法来分析已经存在的数据集。

这些数据集包含 169 名健康志愿者在听荷兰语和英语有声读物时的大脑记录,累积超过 150 小时。

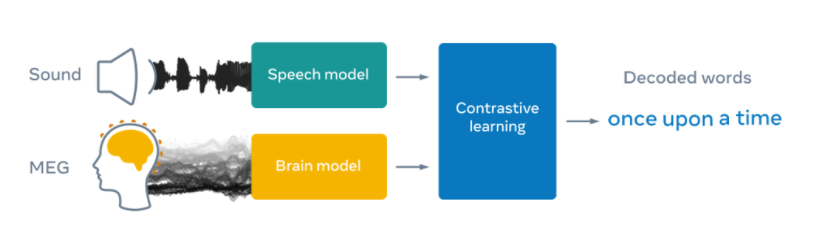

由于目标是非侵入性地解码语音,因此该团队使用通过测量大脑的电活动(脑电图或 EEG)和磁活动(称为脑磁图或 MEG)记录的数据。

两者都是通过头骨外部的传感器记录的,这构成了研究人员的主要挑战之一,King 告诉时代周刊:数据的“嘈杂”程度受限于传感器与大脑的距离,以及皮肤、头骨、水等的影响,会导致信号质量降低。所有这些噪音都变得更加难以消除,因此我们不能 100% 确定我们在寻找什么。

“另一个大问题更具概念性,因为我们实际上在很大程度上不知道大脑如何代表语言。”King 说。

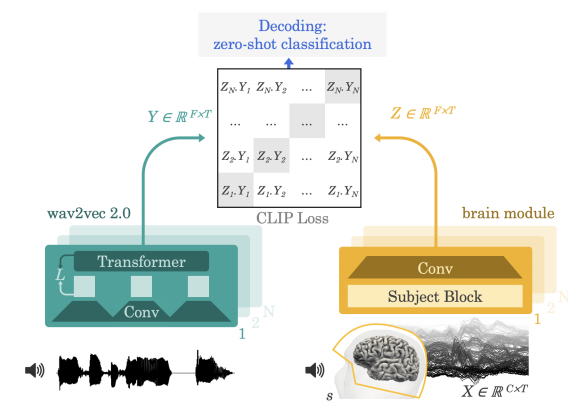

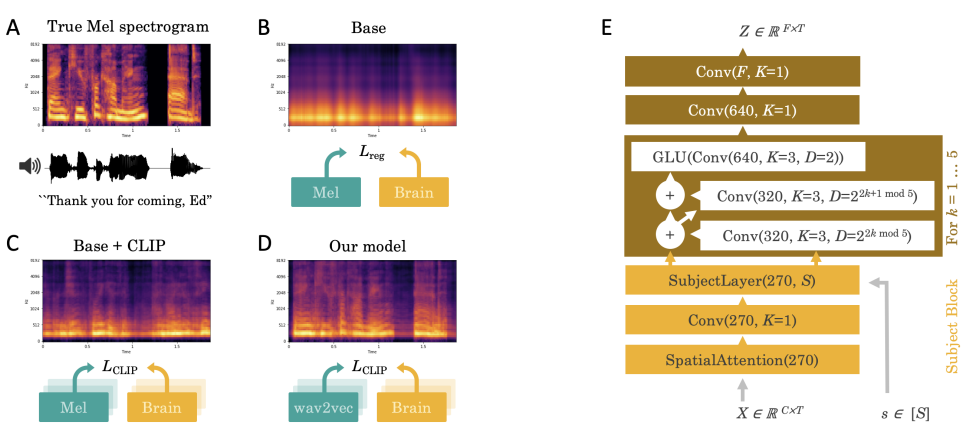

人工智能使用有声读物和大脑录音,分析它们以研究听到的单词和脑电波之间的工作模式。

这就是团队想要外包给人工智能的解码语音的问题,因为它通过一个动作来预测大脑活动——这将决定,在这种情况下,一个对象会听到什么。

如果没有人工智能,“事情将很难说,‘好吧,这个大脑活动意味着这个词,这个音素,或者一个行动的意图,或者其他什么。’”King 说。

解码语音:将这些时间分成三秒位后,他们将有声读物和大脑录音提供给人工智能,人工智能对其进行分析,尝试发现模式。

据《新科学家》报道,该团队保留了 10% 的数据来测试他们的模型:使用从其他 90% 中学习到的模式来尝试识别它从未见过的大脑记录中听到的单词。

“经过训练,我们的系统执行所谓的零样本分类:给定一个大脑活动片段,它可以从大量新音频片段中确定这个人实际听到的是哪个片段。”King 在 Meta 博客中写道。“算法基于这种设计推断出这个人最有可能听到的词。”

具体来说,据《新科学家》报道,人工智能依靠其 793 个单词的词汇表来制作十个单词列表,以粗略地解码语音。

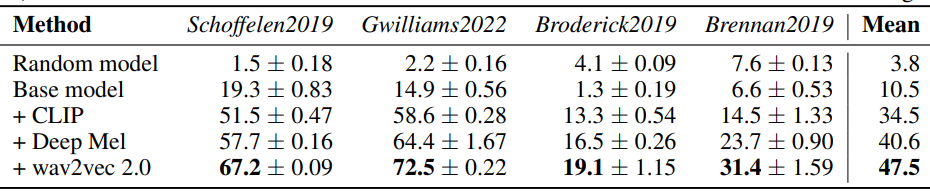

根据他们的预印本,当使用三秒的 MEG 数据时,人工智能能够在 72.5% 的时间内在前十名中得到正确的词——在 44% 的测试中首先猜到它——而在 EEG 数据中则为 19.1%。

人工智能能够在高达 72.5% 的测试中提供包含正确单词的答案列表。

不过,伦敦帝国理工学院教授 Thomas Knopfel 告诉《新科学家》,该系统需要更多改进才能真正用于语音解码,并且怀疑 EEG 和 MEG(非侵入性方案)能否提供更准确所需的精细细节.

“这是关于信息流的。”Knopfel 告诉《新科学家》。“这就像试图通过老式模拟电话调制解调器播放高清电影。即使在理想的条件下,有人戴着耳机坐在黑暗的房间里,只是在听音频,大脑中也会同时发生其他事情。在现实世界中,脑海中只有一个想法独立地发生完全不可能。”

然而,技术进步可能会改变这一点:一种称为OPM的新型 MEG正在推动可以从外部学习的范围。

就他而言,King 告诉《时代》杂志,他们目前只对语音进行解码,以讲述人们在扫描仪中听到的内容。它还不是用于设计产品,而只是作为基础研究和原理证明。

来源:中国信息通信研究院知识产权中心

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。