硬件革新:借助稀疏计算让AI算力提质降耗

谈及人工智能模型,模型规模至关重要。尽管部分人工智能专家警示,大语言模型持续扩容的性能边际收益正在递减,但科技企业仍在不断推出体量愈发庞大的AI工具。Meta最新发布的Llama模型,参数量更是达到了惊人的2万亿。

模型规模越大,能力越强,但能耗、运行耗时也随之攀升,碳足迹进一步增加。为缓解这些问题,行业开始转向采用体量更小、性能稍弱的模型,并尽可能对模型参数使用低精度数值。

而还有另一条可行路径:在保留超大模型高性能的同时,大幅降低运行耗时与能耗。核心思路,就是善用大型AI模型中大量存在的零值。

对多数AI模型而言,绝大多数参数(权重与激活值)本质上都是零,或是无限趋近于零——将这类数值直接视作零处理,完全不会损失模型精度。这一特性被称为稀疏性。

稀疏性为算力节约创造了巨大空间:无需浪费算力和能耗对零值做加减乘除运算,这类计算可直接跳过;内存中也无需存储海量零值,仅需保存非零参数即可。

遗憾的是,目前主流硬件(多核CPU、GPU)天生无法充分利用稀疏性优势。想要彻底释放稀疏计算潜力,科研人员与工程师需要对整个设计架构栈进行重新设计,涵盖硬件、底层固件以及应用软件全层级。

斯坦福大学研究团队研发出一款硬件芯片,据我们所知,这是首款可高效适配各类稀疏及传统计算负载的专用硬件。不同负载场景下的节能效果差异较大,但平均来看,这款芯片的能耗仅为普通CPU的七十分之一,运算速度平均提升7倍。

为实现这一效果,我们从零开始重构了硬件、底层固件与软件体系,深度适配稀疏性特性。我们希望这只是一个开端,未来硬件与AI模型的协同研发,将推动人工智能走向更高能效。

什么是稀疏性

神经网络及其输入数据,均以数字数组形式呈现。这些数组可以是一维(向量)、二维(矩阵)或更高维(张量)。稀疏向量、稀疏矩阵、稀疏张量的共同特征是:绝大多数元素都为零。稀疏程度没有固定标准,只要某类数组中零值占比超过50%,就可以借助稀疏专用计算方法获得效率提升。与之相对,元素中零值占比极低的数组,则称为稠密数组。

稀疏性分为天然稀疏和人为诱导稀疏两类。例如社交网络图谱就是典型的天然稀疏结构:把每个人看作一个节点,好友关系看作节点间的连线。由于绝大多数人彼此并非好友,用来表征所有关联关系的矩阵中,绝大部分数值都是零。图学习、推荐模型等主流AI应用,也普遍存在天然稀疏特性。

常规情况下,一个4×4矩阵无论包含多少零值,都会占用内存中16个存储单元。而稀疏矩阵可通过纤维树结构实现高效存储:先记录包含非零元素的行坐标组,再关联对应非零元素的列坐标组,最终精准定位并存储非零数值本身。在计算机内存中存储纤维树时,会同步保存每组坐标的分段标识、坐标信息以及对应数值。

除天然稀疏外,还可通过技术手段人为诱导AI模型产生稀疏性。两年前,赛布拉斯公司的研究团队证实:可将大语言模型中70%~80%的参数置零,且完全不损失模型精度。

该成果率先在Meta开源的Llama7B模型上得到验证,同样也适用于ChatGPT、克劳德等主流大语言模型。

稀疏计算的价值所在

稀疏计算的高效性,源于两大核心特性:零值可压缩存储、零值具备特殊数学运算属性。稀疏计算算法与专用硬件,均围绕这两大特性设计。

第一,稀疏数据可压缩,通过稀疏数据类型存储,大幅节省内存空间;处理海量数据时,数据传输的能耗也随之降低。

举个例子:一个4×4矩阵仅有3个非零元素。传统稠密存储方式会占用16个内存单元;采用稀疏压缩存储后,仅需保存3个非零值,可节省13个内存单元。且矩阵规模越大、稀疏度越高,内存节省效果越明显。

向量与矩阵相乘,传统稠密计算需要完成16次乘法、16次加法;而采用稀疏格式后,计算量仅取决于非零元素的重合数量,本例中仅需3次索引查找、2次乘法即可完成运算。

稀疏压缩数据除了存储数值本身,还需要配套元数据:必须记录每个非零元素的行列位置。纤维树就是典型的元数据组织形式:先罗列含非零值的行标识,关联对应列标识,再映射到具体数值。

内存存储逻辑则更为复杂:除行列坐标外,还要记录分段标识,用来界定元数据与实际数值的边界,实现二者清晰划分。

稠密无压缩矩阵支持单值读取或并行读取,可通过简单公式直接定位元素位置;但稀疏压缩数据需要间接索引:先查找行坐标,再依托行信息检索列坐标,最后定位数值。

受稀疏数据随机分布特性影响,这类间接索引往往毫无规律,计算过程高度依赖数据分布,还需要实时分配内存索引资源。

第二,零值的数学特性,让软硬件可以直接跳过大量无效计算。任何数乘以零结果仍为零,无需实际执行乘法运算;任何数加零数值不变,也无需执行加法运算。

矩阵-向量乘法是AI最常用的运算之一,除两个非零元素相乘相加的场景外,其余所有计算都可直接省略。

仍以4×4矩阵和四维向量为例:稠密计算需完成16次乘法、16次加法(4次累加运算);稀疏计算仅需考量向量中的非零元素,通过间接索引匹配矩阵非零元素后,仅需执行2次乘法即可,大幅减少运算量。

CPU与GPU的固有短板

现代通用硬件并不适配稀疏计算加速需求。

以矩阵-向量乘法为例:在单核CPU中,向量元素只能逐次串行相乘、写入内存,效率极低。因此行业普遍采用支持向量运算的CPU或GPU,实现所有元素并行计算,大幅提速。

但如果矩阵和向量都是超高稀疏数据,向量CPU与GPU仍会机械地对大量零值做乘加运算,产生大量无效算力消耗。

软件层面执行稀疏计算时,现代CPU因架构灵活性,反而比GPU更有优势。但CPU的短板在于间接索引瓶颈:CPU会基于预判主动预加载内存数据,可随机分布的稀疏数据完全无法预判,预加载经常失效,CPU只能浪费运算周期反复调取所需数据。

苹果率先在A14、M1芯片的预取器中支持指针数组访问模式,优化了间接索引效率。尽管预取技术升级让苹果CPU在稀疏计算中更具竞争力,但CPU作为通用计算架构,天生存在固有开销,无法比肩专为稀疏计算设计的专用架构。

多家企业也在研发稀疏机器学习专用硬件,包括赛布拉斯的晶圆级引擎、Meta的训练推理加速器MTIA。

晶圆级引擎搭配专属稀疏编程框架,可让大语言模型实现高达70%的稀疏度,但仅支持权重稀疏,不支持对诸多应用至关重要的激活值稀疏。

第二代MTIA宣称稀疏计算性能较初代提升6倍,但公开资料仅证实其支持矩阵乘法稀疏加速,暂不覆盖向量、张量运算。

尽管矩阵乘法占据现代机器学习模型绝大部分算力耗时,但全流程稀疏支持必不可少。若运算环节部分稀疏、部分稠密,频繁切换数据类型会额外增加开销,理想状态是全链路运算均适配稀疏架构。

奥尼克斯(Onyx)专用加速架构

斯坦福团队摒弃这种折中方案,研发出硬件加速器Onyx,从底层原生适配结构化与非结构化稀疏计算。它是首款同时可编程支持稀疏与稠密双模式计算的加速器,可高效加速两类场景下的核心运算。

想要理解Onyx,首先要了解粗粒度可重构阵列(CGRA),以及它与CPU、现场可编程门阵列(FPGA)的差异。

CPU、CGRA、FPGA代表着算力效率与架构灵活性的三重取舍:

CPU单个逻辑单元功能固定,专用任务运算效率极高;

FPGA每一个比特位均可自由配置,灵活性拉满,但算力效率极低;

CGRA的设计目标,是兼顾FPGA的灵活性与CPU的运算效率。

CGRA由高效可配置单元(内存、计算单元为主)组成,面向特定应用领域定制优化。核心优势在于:开发者可对CGRA架构进行高层级重构,实现效率优于FPGA、灵活性强于CPU的双重特性。

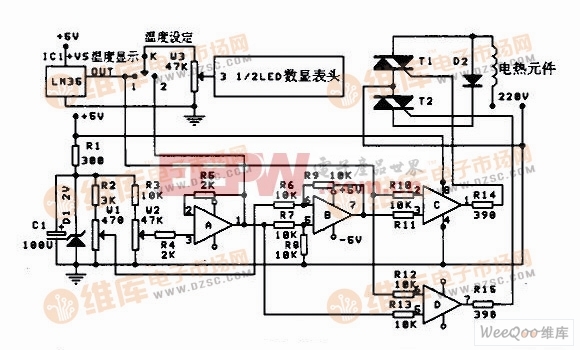

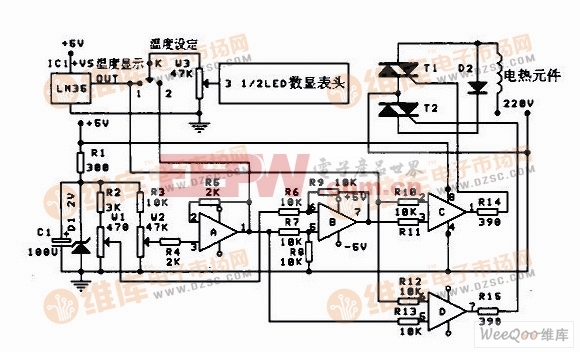

奥尼克斯(Onyx)芯片基于粗粒度可重构阵列(CGRA)架构打造,据我们所知,它是业内首款同时支持稀疏计算与稠密计算的芯片。图片来源:Olivia Hsu

Onyx由灵活且可编程的处理单元(PE)阵列与存储单元(MEM)阵列构成。存储单元负责存放压缩矩阵及其他格式数据;处理单元则直接对压缩矩阵进行运算,剔除所有冗余、无效的计算步骤。

Onyx编译器负责将软件指令转换为CGRA架构配置。首先,输入运算表达式(例如稀疏向量乘法)会被转化为由抽象存储节点和计算节点组成的运算图。以稀疏向量乘法为例:包含输入向量与输出向量对应的存储节点、用于匹配非零元素交集的计算节点,以及执行乘法运算的计算节点。

编译器会完成两项核心工作:一是将抽象存储节点、计算节点映射到CGRA硬件的存储单元与处理单元上;二是规划节点间的数据通路,实现单元之间的数据传输。最后,编译器生成所需指令集,完成对CGRA的功能配置。

得益于可编程特性,工程师可将各类运算任务部署到这款加速器上,既包括向量逐元素相乘等基础运算,也包含矩阵–向量乘法、矩阵–矩阵乘法等人工智能核心运算。

研究团队采用能量延迟积(EDP)指标评估硬件能效提升,该指标为能耗与运算耗时的乘积,可综合衡量速度与能耗的权衡关系。单纯降低能耗会导致设备运算速度极慢,而一味追求速度则会造成芯片面积与功耗飙升。

实测数据显示,对比搭载专用稀疏计算库的12核英特尔至强CPU,Onyx的能量延迟积性能最高可达后者的565倍。

Onyx也可通过配置,像GPU、TPU一样为常规稠密计算任务加速:面对稀疏计算时,启用稀疏运算原语;面对稠密计算时,则重构硬件配置以挖掘并行计算能力,工作模式与GPU类似。该架构向着单芯片统一加速稀疏与稠密计算迈出了关键一步。

同样重要的是,Onyx也推动了算法层面的全新思考。稀疏加速硬件不仅能提升AI的性能与能效,还能助力科研人员和工程师探索全新算法,有望进一步大幅革新人工智能技术。

稀疏计算的未来展望

团队已着手研发基于Onyx架构的下一代芯片。机器学习模型除矩阵乘法外,还包含非线性层、归一化、Softmax函数等大量运算,下一代加速器及配套编译器将全面兼容这类全品类运算。

鉴于稀疏机器学习模型往往同时包含稀疏层与稠密层,团队正优化芯片内部稠密与稀疏加速架构的深度融合,实现不同数据格式之间的快速转换。同时,研究更高效的稀疏数据拆分方案,突破内存容量限制,支持多颗稀疏加速器芯片协同运算。

此外,团队正在搭建加速器性能预测系统,为面向稀疏AI的硬件设计提供优化依据。长远来看,我们关注两大方向:一是高稀疏度能否在更多AI模型类型中普及;二是稀疏加速器能否实现大规模产业落地。

研发适配非结构化稀疏、极致利用模型零值的专用硬件,仅仅是开端。有了这类硬件支撑,AI科研与工程人员能够以全新思路挖掘稀疏性价值,探索创新模型与算法。在AI运行开销、使用成本及环境负担持续攀升的当下,稀疏计算已成为极具关键价值的核心研究方向。

评论