借助英伟达全新CMX平台突破GPU内存墙瓶颈

在扩展 AI 工作负载的过程中,你会遇到的问题之一就是 KV 缓存耗尽 HBM 内存,这会限制 AI 应用的 “记忆” 容量,并导致用户体验下降。针对这一问题,英伟达及其合作伙伴正在开发全新的 上下文内存存储平台(Context Memory Storage,CMX)。上周在美国犹他州盐湖城举办的首届 VAST Forward 大会上,英伟达与 VAST Data 的代表演示了 CMX 如何突破 GPU 内存墙。

KV 缓存是现代 AI 技术栈的固有组件。有了 KV 缓存,用户不必每天早上 7 点重新加载所有输入给 AI 模型的上下文,而是可以将上下文长期保留(按天、按月),以简单的键值存储形式存放在 HBM、片上内存,最终延伸到存储介质中。作为 AI 技术栈面向用户的核心组件之一,KV 缓存自然会受到人类使用需求的影响。换句话说,当员工使用 AI 时 —— 无论是生成猫咪视频,还是搜索新的核苷酸序列 —— 缓存都会快速占满。

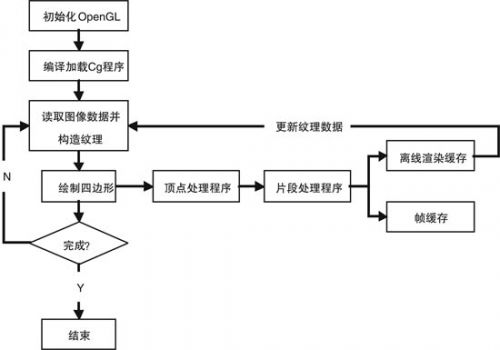

图1 不断膨胀的 KV 缓存正在挤占内存 来源:英伟达与 VAST 在 2026 VAST Forward 大会上的演讲《突破 GPU 内存墙》

“KV 缓存的一个核心问题是,它会随着你使用的上下文长度与批次大小同步增长。” 英伟达高级研究科学家 Vikram Sharma Mailthody 在上周 VAST Forward 的一场演讲中表示,“假设我们使用相同的模型进行推理……缓存计算成本会随上下文长度呈二次方增长。正如你所见,当你需要使用更长的上下文窗口时,系统负担会显著增加,这在智能体工作流中尤为明显。”

这已成为当前扩展 AI 推理系统的核心瓶颈之一。除了 HBM 与 GPU 之间的数据搬运速度之外,HBM 能存储的数据量,也直接决定了 AI 能完成多少有效工作。当 HBM 占满后,KV 缓存会开始溢出到系统内存;系统内存也占满后,就会溢出到本地存储。但到那时,延迟就会严重影响用户体验。谁愿意等上五分钟,才等到智能体 AI 系统给出回答?

“核心结论很简单:推理上下文离 GPU 越远,推理的成本就越高、效率也越低。”Mailthody 说,“这就是为什么现有的内存与存储层级结构,并不适合为下一代 AI 做扩展。也正因如此,我们必须重新构想:存储应该如何构建,以及应该如何为推理上下文管理而构建。”

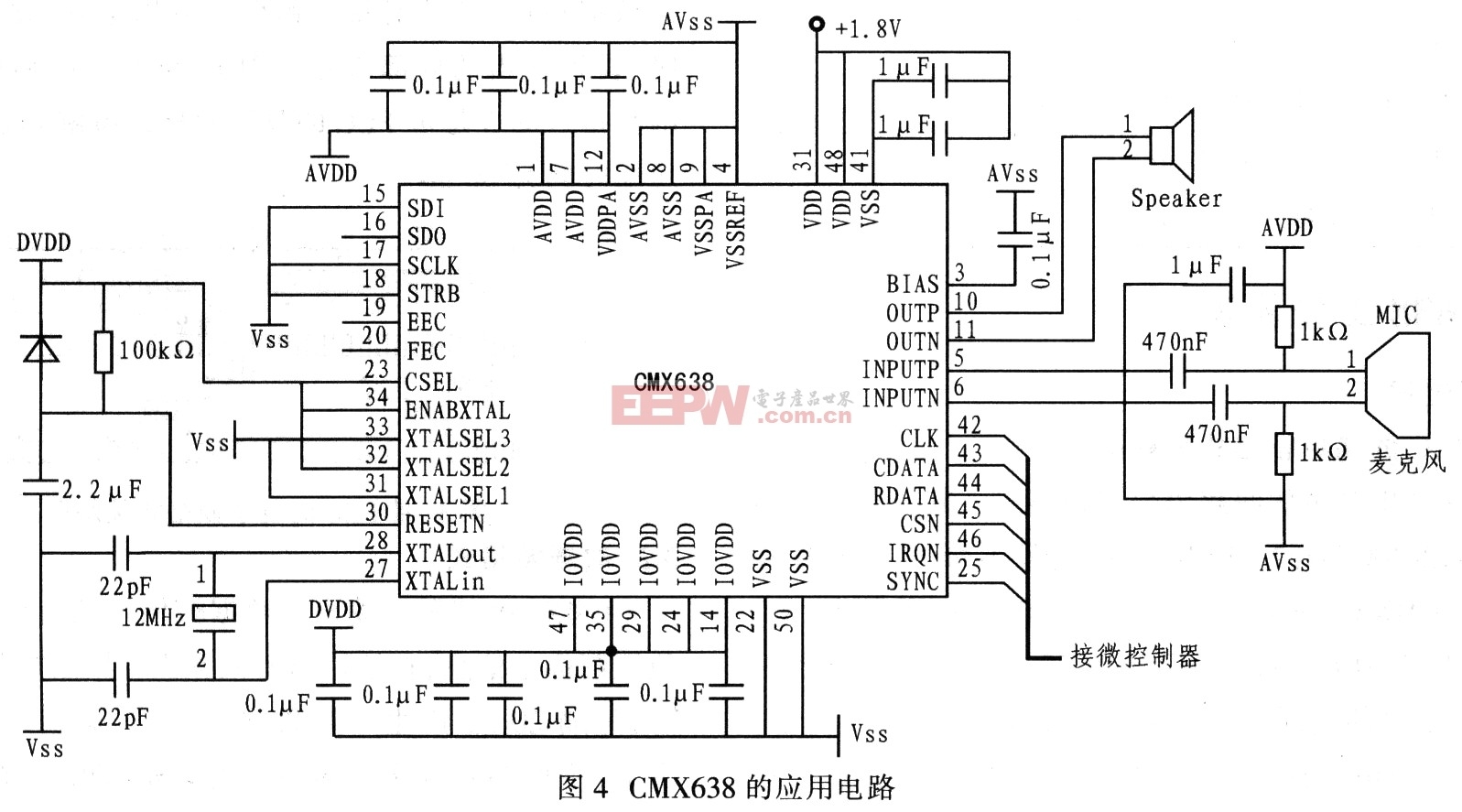

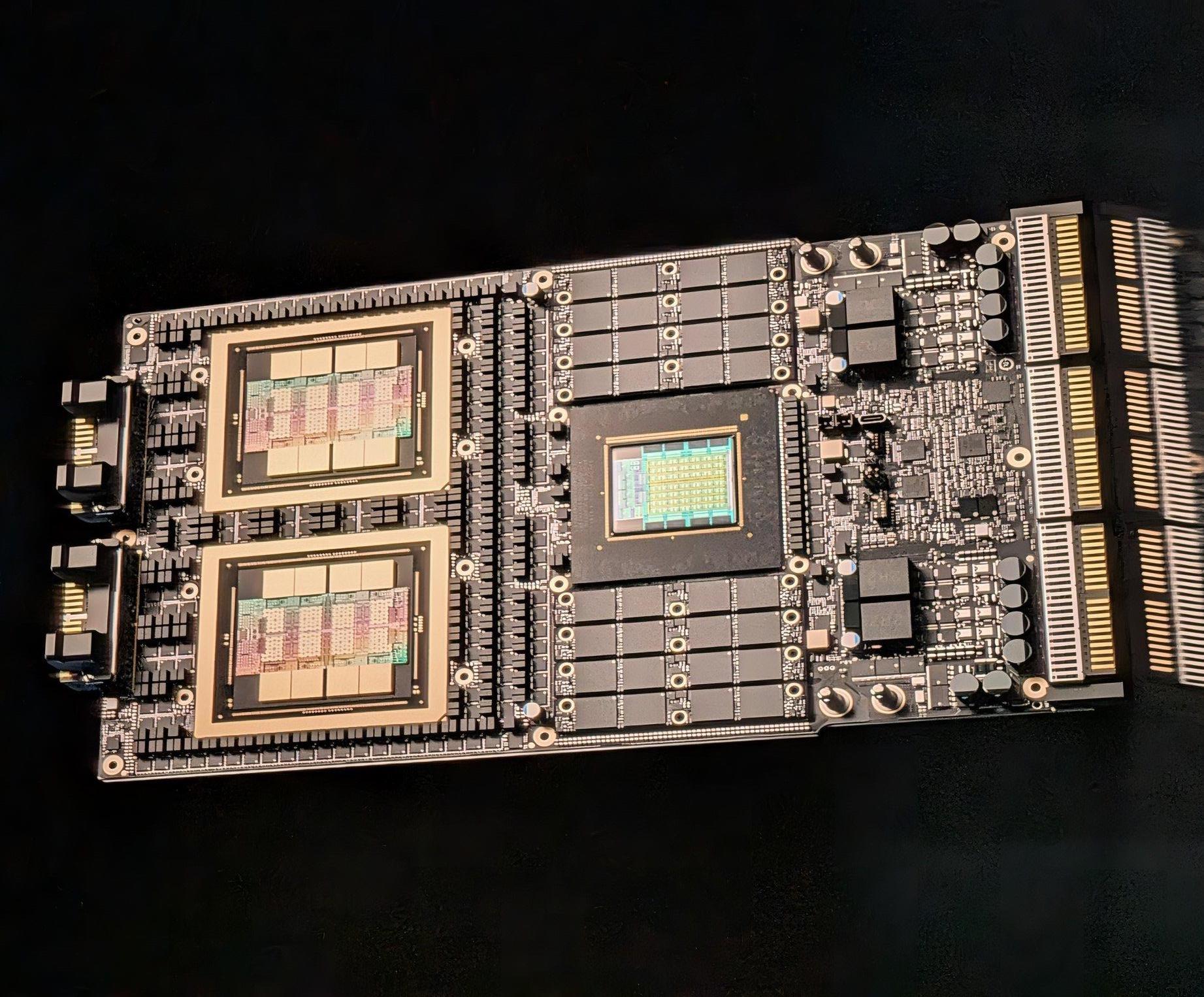

英伟达针对 “上下文窗口–GPU 内存墙” 问题的短期解决方案就是 CMX 平台。该平台于今年 1 月随 BlueField‑4 DPU(数据处理器)一同发布。英伟达正与包括 VAST Data 在内的存储合作伙伴合作,大幅扩展 KV 缓存容量,让客户能够用智能体 AI 完成更多工作。

图2 CMX 旨在扩展客户 KV 缓存且不损失性能 (来源:同上)

CMX 包含多个组件:

在基础设施层面,它将使用英伟达下一代 Rubin GPU 系统,并利用部署在 VAST 等存储厂商管理的存储集群中的 BlueField‑4 DPU。BlueField‑4 将帮助管理元数据、减少数据迁移,并让 Rubin GPU 从数据管理负担中解放出来。

它还将利用 Spectrum‑X 以太网交换机,构建基于 RoCE(面向融合以太网的远程直接内存访问) 的高速网络架构,用于高速共享 KV 缓存数据。

在软件层面,CMX 将使用英伟达面向 BlueField‑4 的 DOCA 开发套件,以及 Nvidia Inference Transfer Library(NIXL)—— 这是一个开源库,用于加速 Dynamo 内部的数据迁移。Dynamo 是英伟达开源的 AI 推理框架。

Mailthody 表示,CMX + VAST 存储的组合将提供下一代千兆级推理架构,可实现:

首词延迟(TTFT)最高提升 20 倍

GPU 利用率提升 90%

存储功耗降低 70%

VAST AI 架构总监 Anat Heilper 在 VAST Forward 演讲中表示,基于 CMX 的键值块管理器,VAST 可以 “从根本上改变计算逻辑”。

“我们把缓慢、重 I/O 的过程,变成了高吞吐量、受网络限制的过程。” 她说,“本质上,这意味着存储可以随网络一起扩展,以支撑这类工作负载。”

在基于 Llama 3 模型的基准测试中,VAST 实现了 200GbE 网络接近线速利用率,该网络连接了 8 张 H100 GPU。

图3 VAST 与英伟达合作开发 CMX (来源:同上)

“结果显示,从 VAST 系统中读取 KV 缓存,相比让 GPU 重新计算,首词响应速度提升 20 倍。”Heilper 说,“这是用户能直观感受到的变化。原本需要等待 GPU 计算 65 秒,现在只需要 3 秒就能读取。这是根本性的改变。这种加速,再加上 GPU 时间节省 90%,体现了效率的巨大提升。”

如果使用更快的网络,收益还会更高,因为 VAST 已经(几乎)打满了 200GbE 带宽。在实际场景中,VAST 估算:通过 CMX 和 BlueField‑4 DPU 将 KV 缓存溢出到 VAST NVMe 存储,利润可提升 60%~130%。

(VAST 上周还发布了全新 CNode‑X,将英伟达 GPU、BlueField‑4 DPU 和 Spectrum‑X 硅光交换机直接集成到 VAST 存储集群中。)

“我们假设企业 AI 工作流的缓存命中率保守在 40%~60%。对于智能体工作流和认知任务,提升幅度可能更高。”Heilper 说,“原理很明确:我们没有让 GPU 变快 —— 那是英伟达的工作。但我们让它更常处于可用状态,并把存储变成算力倍增器。”

VAST 还给出了一份用于智能体系统的 最佳 KV 缓存容量配置指南:

对于 10,000 名用户、每轮对话 32GB KV 缓存的组织,要支持 “即时恢复” 会话,需要 320TB 系统。

保留每位用户最近 5 轮会话(每日备份):需要 1.6PB 系统。

保留最近 15 轮会话(适合程序员、研究员等高频用户做周级缓存):需要 4.8PB 系统。

要实现 “智能体记忆”,即 10,000 名用户每人 150 轮会话:需要 48PB 存储。

“CMX 是一种专为 KV 缓存设计的新型存储。”Mailthody 说,“它会取代这里所有的存储吗?适合所有人、所有集群吗?不,并不是。CMX 专为推理和 KV 缓存管理而设计。

如果你的工作负载模型大、需要大缓存,CMX 就是为此而生。

如果你有需要超长输入序列的场景,比如 AI、聊天机器人或推理模型,它能提供超大内存容量,让服务极高效。如果你的访问模式存在大量内容复用,或是拥有跨多洲共享的大型 GPU 集群,CMX 能轻松启用并提升运营效率。”

评论