HBM4与SPHBM4:为人工智能和高性能计算拓展内存带宽

JEDEC制定的第四代高带宽内存(HBM4)标准,以及新兴的第四代片上封装高带宽内存(SPHBM4)标准,实现了带宽提升与封装方案的拓展,助力人工智能和高性能计算系统突破内存与输入输出壁垒。

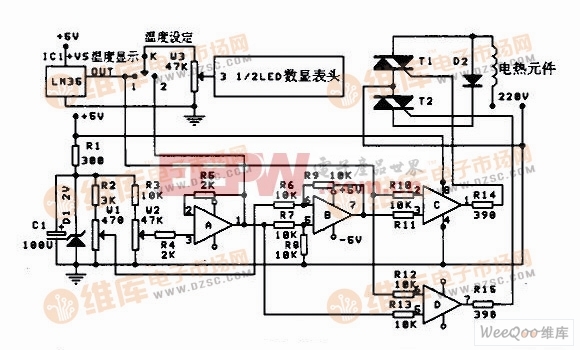

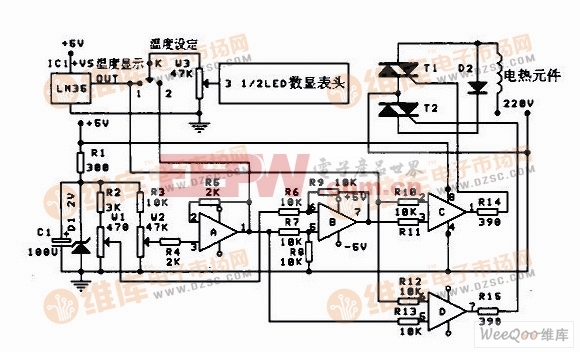

过去二十年,高性能计算(HPC)和人工智能(AI)系统所使用处理器的原始计算能力实现了跨越式增长。图 1 展示了这一发展趋势:同一时期内,异构处理器(XPU)的浮点运算性能提升了逾 9 万倍,而动态随机存取存储器(DRAM)的带宽和互连带宽仅提升了约 30 倍。

图1 20 年间 XPU 性能与互连带宽的增长情况。

这种计算能力与数据传输能力之间不断扩大的差距 —— 即业界常说的内存壁垒与输入输出(I/O)壁垒,已成为制约系统实际性能发挥的最关键因素之一。

对于系统设计人员而言,这种失衡直接导致计算资源利用率不足、功耗攀升,以及系统架构复杂度不断增加。因此,在推动人工智能性能升级的过程中,内存带宽和封装技术的重要性,已与晶体管密度、核心数不相上下。

高带宽内存(HBM):现代人工智能架构的基石

为应对上述带宽挑战,高性能计算和人工智能系统正越来越多地采用以芯粒为核心的解耦架构。尽管低功耗双倍数据率内存(LPDDR)和双倍数据率内存(DDR)仍发挥着重要作用,但高带宽内存(HBM)已成为目前可用的带宽最高的 DRAM 解决方案,也是赋能现代加速器的核心技术。

HBM 器件由底部的缓冲芯粒(或基底芯粒)和上方多层三维堆叠的 DRAM 芯粒构成。缓冲芯粒采用超细间距微凸点技术,借助硅中介层、硅桥等先进封装技术,可将内存堆叠与专用集成电路(ASIC)合封在一起。

在杰德克(JEDEC)HBM 任务组制定的严格标准支撑下,HBM 已成为量产系统中,基于芯粒集成技术的最成功、应用最广泛的范例之一。图 2 为 HBM DRAM 堆叠通过硅中介层与 ASIC 相连的典型侧视图。

图 2 HBM DRAM 堆叠通过硅中介层与 ASIC 相连的典型侧视图。

HBM 的一个典型商用案例是英伟达的 B100 “布莱克韦尔” 加速器(图 3)。该封装内包含两颗掩模版尺寸的大型 XPU 芯粒,二者通过高带宽链路互连,HBM 器件则排布在每颗芯粒的上下边缘。每颗 XPU 芯粒集成四组 HBM 堆叠(每条长边两组),使得单个封装内的 HBM 器件总数达到八组。

以 JEDEC 敲定 HBM3 标准时的典型规格为例,每组 HBM3 器件可采用 8 层堆叠的 16Gb DRAM 芯粒,单堆叠容量为 16GB。凭借 6.4Gb/s 的数据传输速率和 1024 个输入输出接口,每组 HBM3 器件的带宽可达约 0.8TB/s。八组器件协同工作时,该配置能提供 128GB 的总内存容量,以及约 6.6TB/s 的聚合带宽。

图 3 英伟达的 B100 “布莱克韦尔” 加速器

第四代高带宽内存(HBM4):带宽与容量的双重升级

为实现内存性能与计算能力的同步提升,JEDEC 近期正式发布了 JESD270-4,即 HBM4 标准。相较于 HBM3,HBM4 在架构上进行了多项改进,可直接满足人工智能工作负载日益增长的带宽和容量需求。

HBM4 最核心的改进之一是将通道数翻倍,输入输出接口从 1024 个增加至 2048 个。同时,其支持的数据传输速率提升至 6~8Gb/s 及以上;内存密度也实现升级,不仅纳入了 24Gb 和 32Gb 规格的 DRAM 芯粒,还支持 12 层和 16 层的堆叠方式;包括动态刷新管理(DRFM)在内的可靠性、可用性和可维护性(RAS)特性也得到了增强。

综合这些改进,HBM4 在带宽、能效和容量上均较 HBM3 实现了质的提升。例如,采用 16 层堆叠 32Gb 芯粒的 HBM4e 器件,单器件容量可达 64GB(图 4)。

凭借 2048 个工作在 8Gb/s 的输入输出接口,这类器件的单通道带宽最高可达 2TB/s。单个封装内若集成八组 HBM4 器件,总内存容量可提升至 512GB(是前述 HBM3 案例的 4 倍),聚合带宽则突破 16TB/s,实现 2.5 倍的提升。

定制化 HBM 与基底芯粒的核心作用

随着 HBM4 的加速普及,部分系统设计人员开始研发针对特定应用优化的定制化 HBM 解决方案,而这一趋势的关键支撑,正是 HBM 基底芯粒的技术演进。

在早期的 HBM 产品中,基底芯粒通常采用 DRAM 优化工艺制造,该工艺虽适用于电容结构制作,却并非高速逻辑电路的最优选择。而在 HBM4 时代,多数供应商正将基底芯粒的制造工艺切换为标准先进逻辑工艺。这一转变不仅与片上系统(SoC)设计人员所熟悉的工艺更契合,也为定制化开发打开了大门。

无论使用标准还是定制化 HBM4 器件,其解决方案仍需依托先进封装技术和硅基衬底(如中介层、硅桥),以实现内存与 ASIC 之间大量超细间距的互连。

第四代标准封装高带宽内存(SPHBM4):让有机封装也能实现 HBM 级带宽

尽管传统 HBM 在性能上优势显著,但其集成过程需要先进封装技术支撑,这会推高成本和设计复杂度。许多系统设计人员,尤其是聚焦量产和可靠性的设计人员,更倾向于使用标准有机衬底。为填补这一技术空白,JEDEC 宣布,标准封装高带宽内存(SPHBM4)新标准的制定已接近完成。

SPHBM4 器件采用与 HBM4 完全相同的 DRAM 核心芯粒,能提供同等的聚合带宽,同时全新设计了一款接口基底芯粒,专门适配标准有机衬底的贴装需求。图 5 为 SPHBM4 DRAM 与 ASIC 一同直接贴装在有机封装衬底上的侧视图。其中 ASIC 既可同样贴装在有机衬底上,也可保留在硅桥等先进封装结构上,以实现多 XPU 集成。

为通过更少的引脚实现 HBM4 级别的吞吐率,SPHBM4 采用了更高的接口工作频率和串行化技术。HBM4 定义了 2048 路数据信号,而 SPHBM4 预计将采用 512 路数据信号并搭配 4:1 串行化方案,从而实现有机衬底所需的宽松凸点间距。

由于 SPHBM4 与 HBM4 使用相同的 DRAM 堆叠,单堆叠容量保持不变。但有机衬底的布线工艺支持 SoC 与内存之间更长的通道长度,这为系统级设计的权衡取舍创造了新可能。尤其是更长的布线距离和斜向走线设计,通常能让单颗芯粒周围排布更多的内存堆叠。

图 6 展示了这一设计优势:当 HBM 器件贴装在硅基衬底上时,必须紧邻 XPU 摆放,这使得每 25 毫米的芯粒边缘最多只能排布两组内存堆叠;而将 SPHBM4 贴装在有机衬底上时,同一段边缘可连接三组内存器件,内存容量和带宽均可实现约 50% 的提升。

即便 XPU 下方仍需使用硅基衬底(例如为了实现高带宽的 XPU 间互连),将内存器件转移至有机封装后,中介层的整体尺寸也能大幅缩小,这将为系统在成本、可制造性和测试复杂度上带来实质性改善。

未来展望

人工智能工作负载仍在不断突破内存带宽、容量和封装技术的极限,JEDEC 发布的 HBM4 标准是应对这些需求的重要一步,而新兴的 SPHBM4 标准则通过让标准有机衬底实现 HBM 级性能,进一步拓展了设计空间。

对于系统架构师而言,这些技术为平衡性能、成本和集成复杂度提供了全新的灵活性。随着内存和封装技术对整体系统能力的影响愈发显著,尽早考量 HBM4、定制化 HBM 和 SPHBM4 等技术方案,将成为充分释放下一代人工智能和高性能计算性能的关键。

评论