人工智能与无人机的组合如何撕开俄空天军的 “核心“

关注俄乌局势的读者应该已经知道,俄罗斯空军遭遇了重大变故,且事发地点极具敏感性,正是其位于摩尔曼斯克州的奥列尼亚基地。该基地绝非等闲之地,它堪称俄罗斯战略轰炸机的 “核心”。

乌克兰第一时间宣布击毁了41架战略轰炸机,占俄空天军战略轰炸机机队总数的34%(据悉,俄空天军一共121架各型战略轰炸机)。而现在可以确认的战果是,9 架图 - 95MS 战略轰炸机、2 架图 - 22M3 远程轰炸机以及好几架其他战机遭受重创,这些代表着俄空军最为贵重且坚不可摧的实力家底,更是俄罗斯三位一体核打击力量最最重要的的一环。在短短的数十秒内,就惨遭重创,从昔日的空中威慑力量沦为一堆冰冷的钢铁残骸。

最令人感到讽刺的是,这场精准打击的元凶并非传统意义上的航母、战斗机或导弹,而是一群外形宛如儿童玩具的自杀式无人机。它们并非零星来袭,而是多达117架,犹如汹涌海潮般从地平线涌来。在这场非对称战争的缩影中,象征核威慑力量的战略轰炸机像待宰的羔羊般被逐一摧毁,无人机的集群攻击,用极低的制造成本换取了价值数十亿美元的军事资产的彻底瘫痪。

在本次名为“蛛网行动”袭击事件中的主力,除了在明处的无人机之外,还有一个隐藏的“杀手”,那就是用于军事的“人工智能”。

据悉,这场袭击乌克兰已经策划了多年,其利用了乌克兰国内波尔塔瓦州远程战略航空兵博物馆中收藏的图 - 95MS 和图 - 22M3 轰炸机进行 AI 建模,(别忘了乌克兰曾经也是苏联的一员,也有大量苏联时期的武器装备)进而训练无人机开展 AI 自主攻击行动。利用人工智能图像识别技术,无人机就能精准识别轰炸机的翼根和机身。翼根是机翼与机身连接的关键部位,内部结构复杂,汇聚了众多的燃油管道、电线以及承力构件,若被击中,飞机的平衡将被打破,飞行控制系统可能失灵,且修复难度极大,往往需要对整个机身结构进行大规模的拆解和重建,耗费大量的人力、物力和时间。而且,就现在俄罗斯的“考古式”军事研究以及装备,还能不能修好、能不能建造补充新的战略轰炸机入列,还是一个巨大的未知数。

在此前,我们的公众号就报道过欧美媒体担心我国机器人、无人机等等人工智能产品发展被用于军事用途的新闻。现在这个时间点再回头看,也不能说他们的担心完全不无道理。

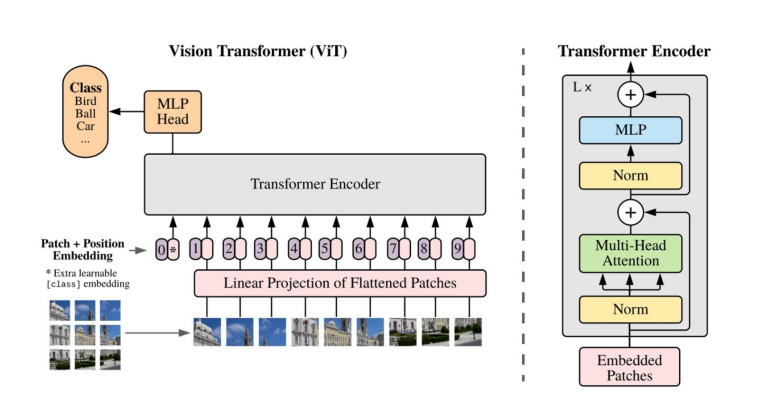

人工智能在军事中的应用近几年来一直都是各方关注的重点。其中,又以基于机械视觉的图像识别技术为发展的重点之一,就像本次“蛛网行动”中的乌克兰使用飞机模型来训练无人机准备通过图像识别飞机,就是该技术发展的一次历史性实践。那么,机械视觉在军事上是如何实现的呢?这就不得不提基于Transformer的物体检测模型——Vision Transformer(ViT)

在机械视觉中,CNN长期以来是图像分析的支柱,利用卷积层提取局部特征并构建层次化表征,其归纳偏差(如局部性和平移不变性)使其在数据和计算资源有限的任务中有效。而ViT从一开始就使用自注意力机制建模图像块之间的全局关系,能捕捉长距离依赖关系和整体上下文,在大规模数据集和需要全面理解视觉内容的任务上表现优于 CNN。对于战场上复杂的地形和瞬息万变的环境来说,ViT模型从中有效地提取重要特征,特别是在从各个角度和环境探测敌方装备或部队时具有巨大优势。

Vision Transformer(ViT)革新了图像处理与理解模式,它引入 Transformer 架构这一强大力量至计算机视觉范畴。有别于传统的基于卷积来提取特征的方式,ViT 将图像当作由一系列图像块构成的序列来处理,借助自注意力机制,能够把握整幅图像里各元素间的关系,进而对局部以及全局的依赖关系开展有效建模,在众多视觉任务中收获了亮眼的成果。

在ViT的操作流程中,首先,会依据固定大小,例如 16x16 像素这样的规格,把输入图像划分成一个个小块所组成的网格架构。随之,将每个小块进行展平操作,转化成一维向量的形式,借此巧妙地把具有二维特性的图像转换为由多个块向量构成的序列。

接下来,每个块向量经由一个线性层,也就是一种简单的神经网络层,将其映射至更高维度的空间范畴。经此步骤,便生成了一个嵌入序列,序列里的每个嵌入分别对应着各个图像块,其原理与 NLP(自然语言处理)领域中 Transformer 对句子中单词进行嵌入的方式有着异曲同工之妙。

不过,由于Transformer本身并不具备识别图像块顺序以及位置的能力,所以需要在每个图像块嵌入当中融入位置编码。这些位置编码承担着注入每个图像块空间位置信息的重任,助力模型留存原始图像所蕴含的结构特征。

此时,携带了位置信息的图像块嵌入序列被输入到标准的Transformer编码器之中。该编码器包含多层多头自注意力以及前馈神经网络等组成部分。凭借自注意力机制,模型得以学习不同图像块相互间的关联性,进而捕捉图像中存在的局部和全局模式。

在块嵌入序列的前端,会添加一个特殊的可学习标记,一般被命名为 “分类标记” 或者 [CLS] 标记。待经过Transformer各层的处理之后,与这个特殊标记相对应的输出,就充当了图像整体的表征角色,可用于诸如分类等后续任务的开展。

值得一提的是,在ViT模型刚刚诞生之时,其计算量巨大,需要大量数据集进行预训练,而近年来随着像Swin Transformer、LaViT等等高效架构的蓬勃发展,引入了分层的多尺度特征提取结构以及使用非重叠窗口中的自注意力机制来减少计算复杂度,进一步降低了内存和计算需求,从而是得其在无人机等等设备上也可以被轻松部署。

落实到军事实践中,将ViT模型搭载于无人机、地面车辆等无人作战平台,可精准识别敌方的位置与运动轨迹。ViT在军事行动中意义重大,其出色的物体探测能力,使其在面对伪装或低能见度环境时,依然能保持高效运作。此外,基于ViT的系统具备高度灵活性,可迅速适应作战环境的快速变化,通过简单地重新训练,即可适配多种战场场景。ViT模型还具有学习和预测敌方模式的能力。通过对海量战场图像的分析,ViT能够解析敌方的移动路径与战术行动模式,进而为指挥官提供前瞻性预测信息。在复杂多变的战场环境中,ViT通过同时分析图像的多个特征,能够为指挥中心提供更全面、更深入的信息,从而助力军事决策的制定。

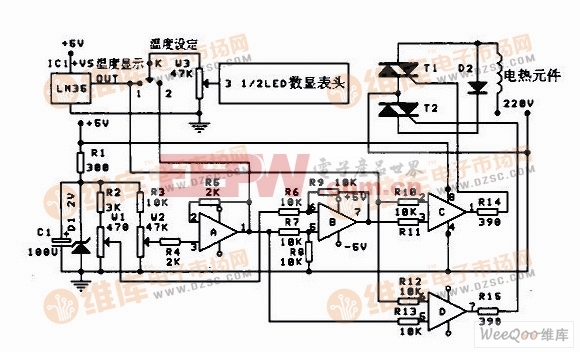

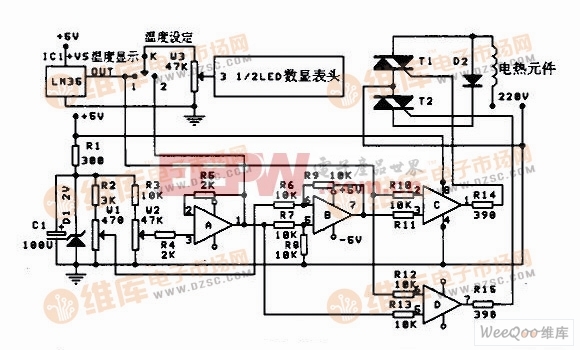

基于ViT的地面物体检测

在这场俄乌冲突中的 “蛛网行动”,更加印证了人工智能与无人机在战争中的重要性。无人机与 Vision Transformer(ViT)技术的深度耦合,已然成为未来战争之中的重大变数。

它们撬动了传统军事力量的平衡,用极低的成本让强大的战略轰炸机群瞬间折戟。不得不说,从各种意义上来看,不论是之前的苏联还是现在的俄罗斯对于我国来说一直都是一个好老师。

在未来的战争舞台上,谁能率先掌握并驾驭这些前沿技术,谁就能在瞬息万变的战局中抢占先机,掌控主动权。而对于世界而言,如何在人工智能军事化的大潮中确保和平与稳定,避免技术滥用引发新的冲突与灾难,也将成为各国必须共同面对和亟待解决的重大课题。这场 “蛛网行动”,或许只是一个开始,但它的影响必将深远而持久,持续推动着军事领域乃至整个人类社会向着未知的未来加速迈进。

评论