Microsoft通过“Braga” Maia 200 AI 计算引擎挑战其他云端

微软不仅是 OpenAI 模型的全球最大用户,同时仍是为 OpenAI 提供计算、网络和存储资源的最大合作伙伴 ——OpenAI 正是依靠这些资源构建其最新 GPT 模型。这一特殊地位让微软有两大理由打造更出色的 Maia AI 加速器,而该公司刚刚宣布,他们已成功推出新一代产品。

如今,所有超大规模云厂商、四大生成式人工智能(GenAI)模型开发商中的三家(OpenAI、Anthropic 和 Meta 平台)都在全力打造自定义 AI XPU(专用处理器),以期降低生成式 AI 推理工作负载的每令牌成本。第四家独立模型开发商 xAI 则似乎倾向于采用特斯拉 Dojo 平台(若其具备足够的扩展性且能适配生成式 AI 训练与推理任务),但目前仍满足于使用英伟达 GPU。

仍有少数厂商对 AI 训练领域感兴趣,但事实上,英伟达已基本垄断该市场。目前,全球企业和政府已开始部署 AI 推理业务(部分直接部署,部分通过云厂商间接部署),其所需的计算资源预计可能是 AI 训练的一个数量级以上,这为超过百家 AI 计算引擎初创公司提供了抢占细分市场、盈利的机会。

与所有超大规模云厂商一样,微软在部署 AI 驱动的副驾(copilot)功能时,希望掌控自身硬件供应链,但作为云服务提供商,它仍需保留通用 X86 CPU 和英伟达 GPU(AMD GPU 的占比也在不断提升),以满足偏好这类架构的客户的租赁需求。和其他云厂商类似,微软对选择 AMD 或英伟达 GPU、英特尔 / AMD / 英伟达 CPU 的客户收取高额溢价,但同时也希望通过自研计算引擎,以低于第三方产品的价格吸引用户。这样一来,当用户租赁 Cobalt CPU 或 Maia XPU 时,实际上是在支持微软摆脱对这些芯片供应商的依赖。

亚马逊云科技(AWS)、谷歌、百度、阿里巴巴、腾讯等少数厂商也遵循着相同逻辑,纷纷投身自研 CPU 和 XPU。Meta 平台虽并非传统基础设施云厂商,但它正像 OpenAI 和 Anthropic 对外提供 GPT、Claude 生成式 AI 模型 API 那样,向各类主权实体开放其硬件资源以运行 Llama 模型 API,逐渐成为专注于生成式 AI 的平台型云厂商 —— 并希望通过获取这些客户的资金,搭建支撑其 “超级智能” 愿景的基础设施。

谷歌早在十多年前就启动了张量处理单元(TPU)项目,因为当时该公司意识到,若要在安卓设备上推出 AI 辅助语音搜索功能(即便用户每天仅使用 3 分钟),其数据中心的容量也需翻倍。而微软的 “顿悟时刻” 则出现在几年前:与 OpenAI 的合作迅猛推进,GPT 模型的使用量呈指数级飙升,几乎没有上限。正因如此,微软于 2023 年 11 月披露了 “雅典娜”(Athena)Maia 100 XPU,但仅公布了少量细节和部分机架照片。

Maia 100 芯片旨在同时支持 AI 训练和推理任务,且明确为运行 OpenAI 的 GPT 模型而设计,作为微软 OpenAI API 服务及副驾功能的后端支撑。曾有传言称该芯片并未实现这一目标,且在运行 GPT 模型时表现不佳,但我们对此并不认同。不过,令人疑惑的是,Azure 云平台从未推出搭载 Maia 100 加速器的虚拟机实例供用户租赁。或许是 OpenAI 不愿将其训练或推理工作负载部署在雅典娜芯片上,导致微软未能扩大该芯片的量产规模。

但 “布拉加”(Braga)Maia 200 的情况似乎不会如此 —— 这款雅典娜芯片的继任者专为 AI 推理任务设计,这在一定程度上简化了产品架构。

要理解 Maia 200 的性能表现,我们需要回顾并梳理 Maia 100 的相关信息(该产品发布时未披露详细参数,后续才断断续续公布)。

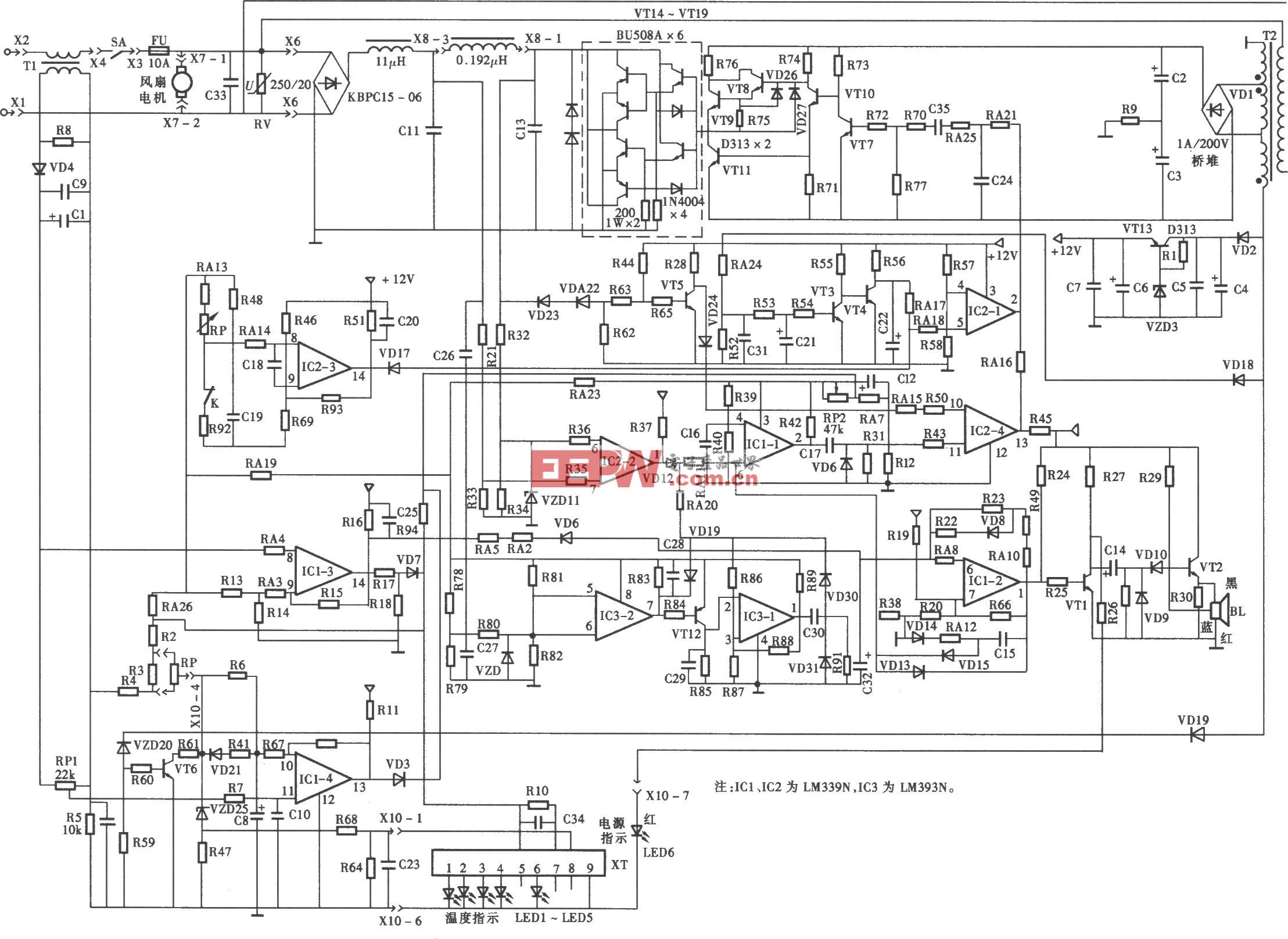

以下是雅典娜 Maia 100 芯片的核心架构:

从封装图中可清晰看到四组 HBM 堆叠内存。

每个雅典娜核心均配备张量单元和向量单元,分别命名为瓦片张量单元(TTU)和瓦片向量处理器(TVP,非 “组织化植物蛋白” 的缩写)。核心内设有控制处理器,负责管理工作负载的流转;另有瓦片数据移动引擎(TDMA),协调各瓦片上 L1 缓存间的数据传输。这些瓦片聚合形成微软所称的 “集群”(按行业常规命名方式,我们更倾向于将其称为 “核心” 和 “流处理器”,而多个集群则构成一个计算引擎)。

如上所示,每个集群包含 4 个瓦片,且配备专属的集群控制处理器(CCP)和集群数据移动引擎(CDMA),负责管理对 L2 缓存 SRAM 的访问。

微软从未披露每个瓦片的具体 L1 SRAM 容量,以及一个集群中 4 个瓦片共享的 L2 SRAM 容量,但曾暗示,整个雅典娜计算引擎的 L1 和 L2 缓存总容量约为 500MB。该计算引擎共有 16 个集群,通过二维网格互联,总计包含 64 个核心(按行业常规命名)。

我们认为雅典娜芯片确实包含 64 个核心,但不确定这些核心的良率,因此无法得知 Maia 100 的实际有效性能。我们很难相信其核心良率能达到 100%,结合微软公布的性能数据(推测基于完美良率芯片),实际可用核心数量可能在 52 至 56 个之间。

雅典娜芯片的面积为 820 平方毫米,接近台积电 5 纳米工艺的掩膜版极限。微软最终透露,该芯片复合体包含 1050 亿个晶体管,且看似采用单芯片设计(尚未得到官方确认)。我们推测 Maia 100 的主频约为 2.86 吉赫兹,芯片上约 500MB 的聚合 SRAM 总带宽可达 132 太字节 / 秒。四组 HBM2E 内存的总容量为 64GB,带宽为 1.8 太字节 / 秒 —— 即便在两年前,这一内存性能也算不上突出。

每个雅典娜核心的张量单元支持微软自研的 MX6 6 位和 MX9 9 位数据格式,这些格式采用微指数设计,精度略高于 FP4 和 FP8 格式,且借助 Maia 核心的硬件辅助功能,不会显著影响吞吐量。其中 MX9 格式计划用于训练任务(以更低的硬件开销替代 BF16 和 FP32 格式),MX6 格式则针对推理任务 —— 这也印证了微软最初希望雅典娜芯片同时适配两类 AI 工作负载的设计目标。

尽管微软与 Meta 联合研发的 MX9 和 MX6 格式颇具创新性,但唯一实现这些格式的芯片仅有 Maia 100。目前尚不清楚 OpenAI 是否对这些格式满意,但可以肯定的是,新一代布拉加 Maia 200 芯片的张量单元仅支持 FP4 和 FP8 格式,向量单元则支持 BF16 和 FP32 格式。

Maia 100 不仅具备高 SRAM 带宽和较大 SRAM 容量,其互联 I/O 带宽也相当可观 —— 至少对于采用以太网作为底层互联传输协议的芯片而言是如此。Maia 100 配备 12 个 400Gb / 秒端口,单个雅典娜计算引擎的聚合输入带宽可达 4800Gb / 秒(600GB / 秒),相当于英伟达 “霍珀”(Hopper)H100/H200 GPU 或 “布莱克韦尔”(Blackwell)B200/B300 芯片组单个插槽 NVLink 端口带宽的三分之二。

不过,这些带宽并非通过单一聚合端口实现:12 个通道中,9 个用于四芯片组(一个四芯片组构成雅典娜系统的基板)内的芯片间互联,剩余 3 个通道则分配给三条独立互联链路,每条链路向系统中其他四芯片组提供 150GB / 秒的带宽。数据包通过这三条链路分发传输,以减少网络拥堵。根据我们的测算,Maia 100 的一致性集群域可支持 576 个节点,总计 2304 个计算引擎 —— 对于基于以太网的网络架构而言,这一规模相当可观。

Maia 200 的核心升级

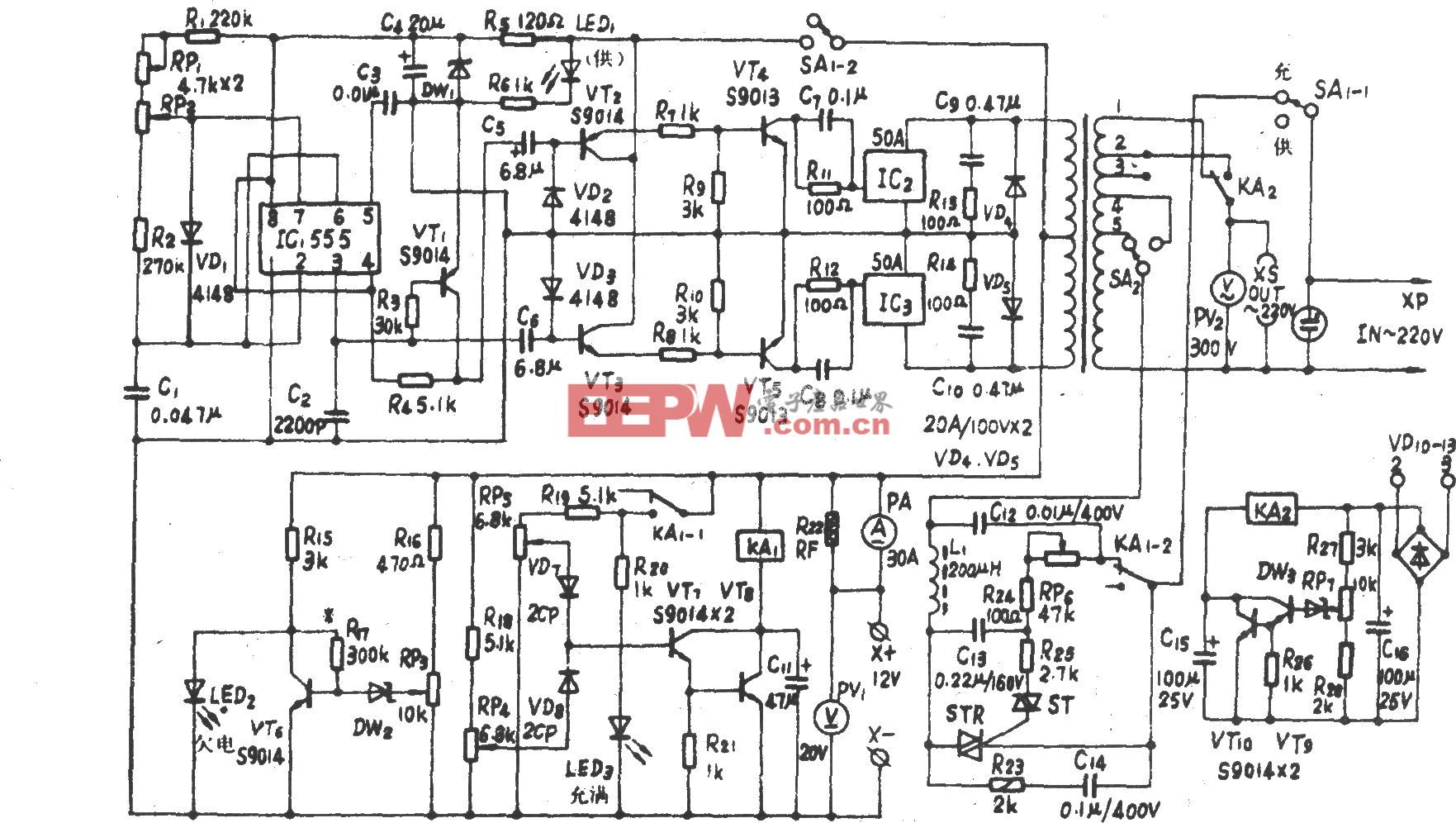

如下表所示,Maia 200 对这一增强型 RoCE 以太网架构进行了进一步优化,将其重新命名为 AI 传输层(ATL),并集成在网络接口中(与 Maia 100 的设计一致)。不同之处在于,ATL 网络配备 8 条传输链路,支持更高效的数据包分发,且一致性集群域规模扩大至 1536 个节点、6144 个计算引擎。

我们认为,Maia 200 的集成网卡配备 56 个 400Gb / 秒串并转换通道,芯片的双向聚合带宽可达 2.8 太字节 / 秒。与前代类似,其中 9 个通道可能用于布拉加四芯片组系统板的全互联链路,剩余 47 个通道则用于实现 8 条 ATL 互联链路。目前尚不清楚这些链路如何通过数据包分发实现与两层以太网网络的对接,从而构建内存扩展域,但我们将后续进一步分析。

工艺方面,Maia 200 采用台积电 3 纳米性能增强版(N3P)工艺制造。得益于制程升级,微软将芯片主频提升 8% 至 3.1 吉赫兹,芯片面积增加 2% 至 836 平方毫米,更接近当前光刻工艺 858 平方毫米的掩膜版极限。不过,制程升级的主要收益在于晶体管数量的提升 ——Maia 200 的晶体管总数达到 1440 亿个,这也是其相较于雅典娜芯片性能提升的核心驱动力。

尽管 Maia 200 的 I/O 带宽较前代提升 2.33 倍,但每个计算引擎的 SRAM 容量减少了一半以上;我们估算,即便核心数量增加 50%(达到 96 个),聚合 SRAM 带宽仍下降了 61%。此外,布拉加芯片的核心良率约为 92%,因此主流版本的实际可用核心数量约为 88 个。

晶体管数量增长 1.5 倍的同时,HBM 内存容量提升 3.4 倍至 216GB(采用 6 组 12 层堆叠的 3GB 芯片,每组容量 36GB),内存带宽提升 3.9 倍至 7 太字节 / 秒 —— 这一提升得益于内存堆叠组数的增加以及 HBM3E 内存的采用(实际由 SK 海力士供应)。

微软尚未公布 Maia 200 的详细技术规格和框图,但已披露其关键性能参数:张量单元在 FP4 精度下的算力为 10.15 拍字节 / 秒,FP8 精度下为 5.07 拍字节 / 秒;向量单元在 BF16 精度下的算力为 1.27 拍字节 / 秒,整体热设计功耗(TDP)为 750 瓦。

硬件形态与部署进展

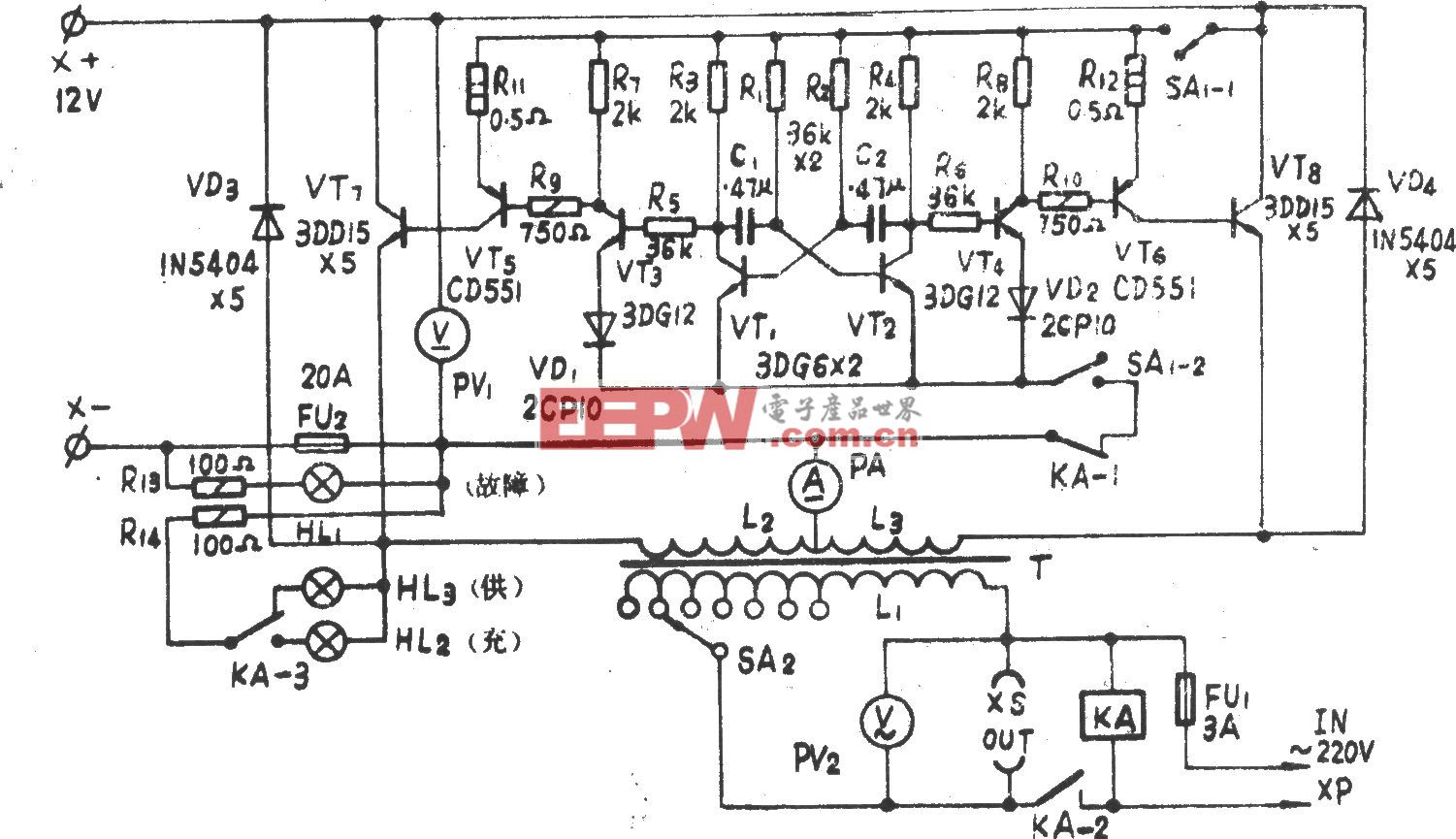

Maia 200 刀片服务器的设计如下:右侧配备 4 个 AI XPU,左侧则搭载一颗 CPU—— 极有可能是微软去年 11 月发布的 Cobalt 200(相较于前代 Cobalt 100,性能提升约 50%)。

以下是 Maia 200 的机架形态:

左侧为一对空的 Maia 200 机架,左侧配有冷却液分配机架;

右侧为微软 Azure 数据中心内部分部署的 Maia 200 机架。

目前,位于爱荷华州得梅因市郊外的 Azure 美国中部区域已部署 Maia 200 机架,亚利桑那州凤凰城郊外的美国西部 3 区将紧随其后。微软表示,Maia 200 计算引擎将用于为 OpenAI GPT-5.2 大型语言模型提供推理令牌服务,支撑微软 Foundry AI 平台及 Office 365 副驾功能;同时,微软的 AI 研究人员也将利用该引擎生成合成数据,用于内部模型的训练。

关于 Azure 何时将推出基于 Maia 200 的虚拟机实例(供技术人员在各类 AI 模型上进行测试),微软暂未公布具体时间表。

评论