具身神经智能、类脑芯片的进展与展望

今年具身智能非常火热。从宇树的人形机器人登上春晚之后,掀起了新一轮的投资热潮,一些企业拿到了多轮投资。具身智能也成为AI 可能落地的一个场景。具身智能的核心之一是大小脑技术,而下一代的具身神经智能有望实现真正的全脑,使机器人具备人类大脑一样的计算能力。

那么,具身智能当前的发展态势如何?为何下一步需要具身神经智能?2025 年 9 月底,“ IC WORLD 2025”在北京经济技术开发区举行,会上,北京大学博雅特聘教授、集成电路学院党委书记王源做了主题报告——具身神经智能的发展与趋势,分享了他的观点。王教授长期从事类脑计算、存内计算等新范式计算架构和芯片的设计研究,研制了多款新型AI 芯片。

1 机器人的历史及启示

具身智能的一种载体是人形机器人。对于人形机器人,我们的祖先赋予了无数想象。例如先秦时期,《列子. 汤问》记录了一个故事:验尸献计。巧匠偃师给周穆王送了一个人偶,这个人偶非常好玩,周穆王很惊奇。为什么要讲这个话题?其中有几句话现在还很应景,这个人偶有五脏六腑,如果去其心,它就不能言;如果去其肝,它就看不见;如果取其肾,就不能行走。所以古代的机器人/ 人偶与现在的具身智能是有所区别的:现在的具身智能或者机器人,头是头,眼是眼——是完全分离的;而古代的是一个从里到外、从上到下完整的系统,这也给我们一点启示。

近50年来人形机器人发展很快。1972年日本早稻田大学研发了全球第一个全尺寸的人形机器人。2000年,日本本田公司研制了在运动能力上有重大进步的机器人,可以做双足奔跑、上下楼梯等。2008年法国阿尔德巴兰机器人公司研发了NAO机器人,是第一款商业落地的机器人,是一个小型的教学陪伴机器人,值得一提的是,具身智能一个很大的潜力市场就是教育领域。另一家有代表性的企业是美国的波士顿动力,2005 年发布四足狗BigDog,2013 年推出Atlas 系列人形机器人,到2021 年有了快速的发展。

众所周知,近几十年来人形机器人的发展非常迅速,特别是我国这几年,例如2025 年春晚上,1.5 岁的宇树H1 机器人登台表演,引爆了公众对具身智能市场的关注。

2 具身智能的市场规模

根据摩根士丹利2025年6月发布的《Robotics Unleashed, A New Era》报告,随着大模型的出现,以及VLA(视觉、语言和动作模型)技术的发展,机器人技术已经从单一、原有的自动化,逐渐向通用智能不断演进,逐渐进入智能时代。

根据这份报告指出,泛机器人市场呈快速增长的势头。尤其中国市场增长快,2024 年中国机器人的市场规模大概占到全球总量的40%,达到470 亿美元;预计到2028 年,按照年复合增长率23% 测算,市场规模将会增加到1080 亿美元。

泛机器人市场包含了很多产品形态,不仅有人形机器人,还有工业机器人、协作机器人、移动机器人、服务机器人,另外把无人机也归入进来(图1)。

图1 泛机器人市场

3 具身智能的定义、分类与特点

具身智能是一种基于物理身体进行感知和行动的智能系统。基于智能体和环境的交互来获取信息,然后理解问题,做出决策,最后采取行动,是一个典型的闭环。

本质上,它强调了物理身体、智能体。智能体的形状可以很多,例如可以是固定式,也可以是移动式(包括自动驾驶车),还可以是仿生式,例如杀人蜂。当然,现在市场上最火爆的是人形机器人。

具身智能系统可以分为三个层次。

● 第一个层次是应用与感知层,主要是各种传感器的集成,包括视觉、语义(听懂自然语言)、听觉、触觉等。这一层的计算频率/ 应用频率大概在10~30 Hz。

● 第二个层次是任务分析和规划层。目前具身智能的解决方案大部分采用的是大小脑结合的方案。具身大脑(1~10 Hz)主要是做环境分析、顶层规划和记忆构建,相对算力要求更高;具身小脑(30~100 Hz)主要做抓取动作的预测、导航轨迹的规划,特别对于人形机器人场景。

大小脑的处理速度、频率的要求是不同的。目前业界主要采用大小脑的协同方式。

值得一提的是,前面感知层、大小脑层甚至人的大脑分成两个脑,但人脑没有具体的哪个脑是专门控制哪个位置的,特别是感知层面,没有说若挖掉了某个部位,人就不能干某件事情——它们是互补的。

● 第三个层次是本体运动和执行层(500~2000 Hz)。

本体运动包括了信息反馈和本体控制两部分,后者/本体控制包括了运动避障、平衡控制。现在有很多具身智能机器人,例如人形机器人运动会上,人们可能更多的是关注本体控制,是否能做各种动作,诸如跑步/ 马拉松,跑马拉松时原来会摔倒,现在跑得更好;包括打拳等,都是本体执行非常好的一种体现。

但是从长期角度看,推进智能的发展还是核心,即具身大脑和具身小脑的发展。

4 大小脑结构的挑战

● 大脑。具身大脑通常基于多模态的大模型,从单一任务向复杂多任务的方向发展。

关于多模态大模型,如果面向单一任务,计算特点是基于图像和文字的多模态输入,会造成输入的令牌较多,但是实际输出的令牌较少。面临的主要挑战包括如何基于预训练的多模态大模型在真正应用环境中实现高效的多模态融合,以及如何降低令牌计算的延迟等。

具身智能的大脑逐渐从单一任务转向复杂多样的融合、深度推理的模式,包括一些记忆能力。计算特点主要是要记忆信息造成上下文之间的需求,深度思考,增加推理解码的长度。而且处于复杂环境,特别是人形机器人是在一个动态多变的环境下,就提出了高响应的需求。

主要挑战包括前述的上下文的问题,深度推理的问题,各个阶段的算力不同,仿真、存储的需求。

● 小脑。由于小脑主要负责控制。传统的具身智能小脑往往采用固定规则,包括一些小模型。

大脑是大模型,小脑做小模型。大模型计算频率会较高,小脑的计算实时性要求会非常高。

但是问题在于,如果是模型很小的情况下,很明显没有像大模型那么好的泛化能力,也就意味着一旦给小脑烧好了一个模型,它能执行的任务就是这么多。因此会经常看到一些机器人,例如它本来想打拳击,但是往后退两步可能会摔倒,因为它的模型不是聚焦在防摔的。所以泛化能力不是弱,而是非常弱、极弱。

当然现在也有基于大模型的具身智能小脑的路线,主要聚焦在两个方面:VLA(视觉、语言和动作模型),快慢系统。

● VLA是基于预训练完成视觉、语言大模型的初始化,然后在具身的数据上进行微调,因此这个闭环显著提升了泛化性。但是问题在于它本身是基于大模型初始化的,所以对算力和缓存的需求量非常高,所以可能小脑变成大脑,这就使小脑/ 端测原有的小算力芯片对算力的需求越来越大。

王源教授团队调研了市面上的一些具身智能公司,发现小脑的算力目前很难满足需求。

● 快慢系统。快慢双系统顾名思义就是要实时处理的,快系统对指定的场景进行现场理解,慢系统再进行快速动作的生成。可见有一个先理解、后生成的过程,二者是异步的计算,并不是同步完成的。但是很明显,快慢系统如果是异步的,它的模型应该也是异构的,所以需要平衡计算资源。对于小脑,到底是满足慢系统——模型相对大一点,但是时间/ 周期稍长;还是满足快系统?

这两年,快慢双系统的发展非常快,从2024 年开始到2025/ 今年,时间迭代非常快。包括前述的VLA也是如此快。

前面分析了目前大小脑本身的一些问题,会看到目前具身面临的挑战主要体现在下面几个方面。

第一,泛化能力不足。只能在单一场景中表现得较好,但别指望像人一样可以在不同的场景里去学习,可能换一个场景就变成了傻子。所以在新环境中它很容易失效,所以我们现在不能对现有的具身智能或人形机器人的期望太高,特别是它缺乏像人一样的迁移和学习的抽象能力。

第二,目前很多具身智能的模拟是在仿真模拟环境下完成的,而应用场景是现实的物理世界。怎样把现实的物理世界和赛博空间做很好的联系?这方面还有很大的差距。如果仿真环境和现实之间差距太大,往往训练出来的模型难以直接部署。

第三,大模型和小模型有各自的算力要求,而且算力之间又存在兼容的问题,所以成本很高,还有在真实环境中,做小样本学习或者在线学习的普遍效率是较低的。

5 具身神经智能的优势

5.1 具身智能的局限

据调研,目前具身智能公司的主要解决方案还是基于英伟达平台,是典型的GPU 架构,即基于深度学习方式来做,以提供足够的算力来解决。

但是实际上,具身智能是物理世界和虚拟世界交互的,人最擅长做这件事,但是目前所有的具身智能在神经机制方面是有缺失的,缺乏对人/ 生物系统的借鉴。

所以王源教授的报告叫具身神经智能。“神经”指神经系统。希望能够把具身智能和神经形态计算或神经系统相结合,能够让具身人形机器人真的像人一样。当然人也有很多不擅长的地方,例如看不远、听不清,因此除了发挥人的优势外,也可以通过传感器来弥补人的劣势。

人能很好的自学习或在线学习,这种学习方式能够实现智能计算的可适应性、可配置性,在灵活性方面有很大的优势,但现在的具身智能很明显存在一些问题。

具身智能是大小脑结构,但人不是大小脑结构,是一个全脑。具身智能的大小脑有异构性的特点,从算力、速度、存储等角度看,大脑和小脑的需求是不一样的,这也就意味着很难把不同的算力平台进行融合;而人脑不是这样,人脑是一个完整的结构。

5.2 如何从具身智能迈向具身神经智能?

● 让AI不仅会感知和行动

我们现在的认知是基于大模型的认知,并不是人的真正意义上的认知。人的认知范围是很复杂的,除了学习之外,还有情感、思维等。所以希望具身智能不仅会感知和行动,而且会像人的神经系统一样自组织、学习和适应。

所谓的具身神经智能就是把类脑智能和具身智能相结合,使智能体具备感知、决策和应用能力,同时利用类脑架构的高效率和自适应性,实现端到端的高等级具身神经智能。

它有几个基本的特点。

第一,感知和行动。我们可以参考现在的神经具身智能本身的特点,我们通过多种感官系统获取外部的信息,并通过动作系统与环境互动。但是它的计算平台可能就不是简单的GPU。实际上,我们目前也只有GPU平台可选。

神经计算平台通俗地讲是把一个生物脑怎样尽可能地拷贝成一个电子脑。即我们用现在的大规模集成的硅技术,怎样尽可能地去复制我们的生物脑。当然生物脑里的各种事件触发的机制是超低功耗的,同时抗噪特性优异,具有在线学习的能力,它集各种低功耗、超高能效为一体。人脑是一个超低能耗的载体,人一天只吃三顿饭,整个功耗约20 W,但实时计算能力能达到1TOPS,比现在的各种硅平台高很多。但怎样通过电子计算手段实现这种能力?是非常有挑战性的。

王源教授团队给出了一个方案,在传感器与执行器方面,与现在的方案没有什么太大的区别:传感器可以是视觉的、声学的、定位的;执行器也可以是各种各样的,例如人形机器人等移动平台。核心是中间的类脑计算平台。需要说明的是,类脑计算平台不是替代现在的GPU平台,因为GPU 有密集计算的优势,所以类脑计算平台大概率是一个结合了生物启发的类脑平台,再加上GPU的密集计算平台,它是一个融合的平台。所以这种方案不再区分大小脑,实现一个全脑式的操作。

● 类脑平台的发展概况

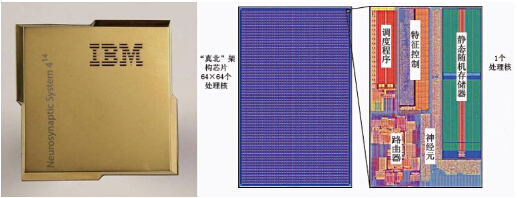

类脑计算平台不是新事物,其实也做了很多年。如图2是个典型的4 家平台, 从2014年IBM 的TrueNorth,到2018年英特尔Loihi,2019年清华推出了天机,2023年王源教授团队做了PAICORE。

图2 部分类脑芯片厂商

一些机构公司做了基于类脑计算的机器人,例如英特尔的无人机,清华的基于天机的无人驾驶自行车、天机猫等。

北大王源团队做的是基于PAICORE类脑芯片的研究。PAICORE是全球最大的类脑芯片,有191 万个神经元和47亿个突触,集成了1024个处理核心。王源团队推出了基于小车的无人车硬件平台PAICar,有两款车,分别为双驱和四驱车,有一个在复杂环境下的小车的演示,是在室内环境情况下的追踪任务, 自己的四轮车去追双驱车。还有一些暗光场景下怎样去完成的演示。

6 未来预测

具身神经智能还是要两条腿走路:一方面是神经形态的硬件,即上述的核心,它是一个融合了GPU 和生物启发的类脑芯片平台,是神经形态的硬件;另一块是具身的机器人,是载体,包括前后两端(传感器和执行器)。

● 近期人们主要聚焦在多核并行计算和低功耗上,因为这是刚需——现在机器人的短板是续航时间不长,移动能力及反应能力偏弱。当然机器人本身主要聚焦在多模态、多任务的执行上。

● 中期要显著提高计算密度,实际上还是提升算力/处理能力。在机器人方面,主要是把神经计算技术和具身智能进行深度融合,真正做到全脑,而不是大小脑。

● 远期(2030-2035) 希望具身神经智能具备人类大脑的计算能力。实际上,人类大脑的长时间精确计算能力是不足的,但是实时计算能力非常高,可达1 TOPS,所以在快速反应和实时计算方面的能力是非常强的。所以在芯片算力的突破(图3)之后,期望具身神经智能能够具备近乎人脑的计算能力。

图3 芯片架构的展望

当然,人脑还有学习方面及其他方面很多优势,期望最后能够达到人类能力的高度,实现真正智能化的机器人。

(本文来源于《EEPW》202511)

评论