博通的Thor Ultra:与英伟达的人工智能网络战争的新战线

2025 年 10 月 14 日,博通宣布推出其 Thor Ultra 网络芯片,这是一款高性能处理器,旨在连接海量数据中心的数十万个 AI 加速器。此举直接挑战了 Nvidia 在人工智能基础设施(特别是其 NVLink Switch 和 InfiniBand 网络解决方案)方面的主导地位,为分布式计算集群提供了卓越的可扩展性,而分布式计算集群对于训练和运行大型语言模型(如为 ChatGPT 提供支持的模型)至关重要。

Thor Ultra 芯片的主要细节

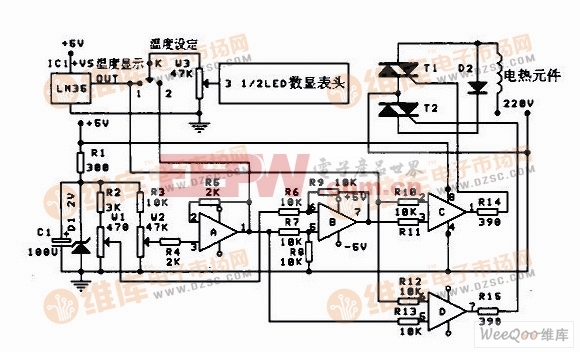

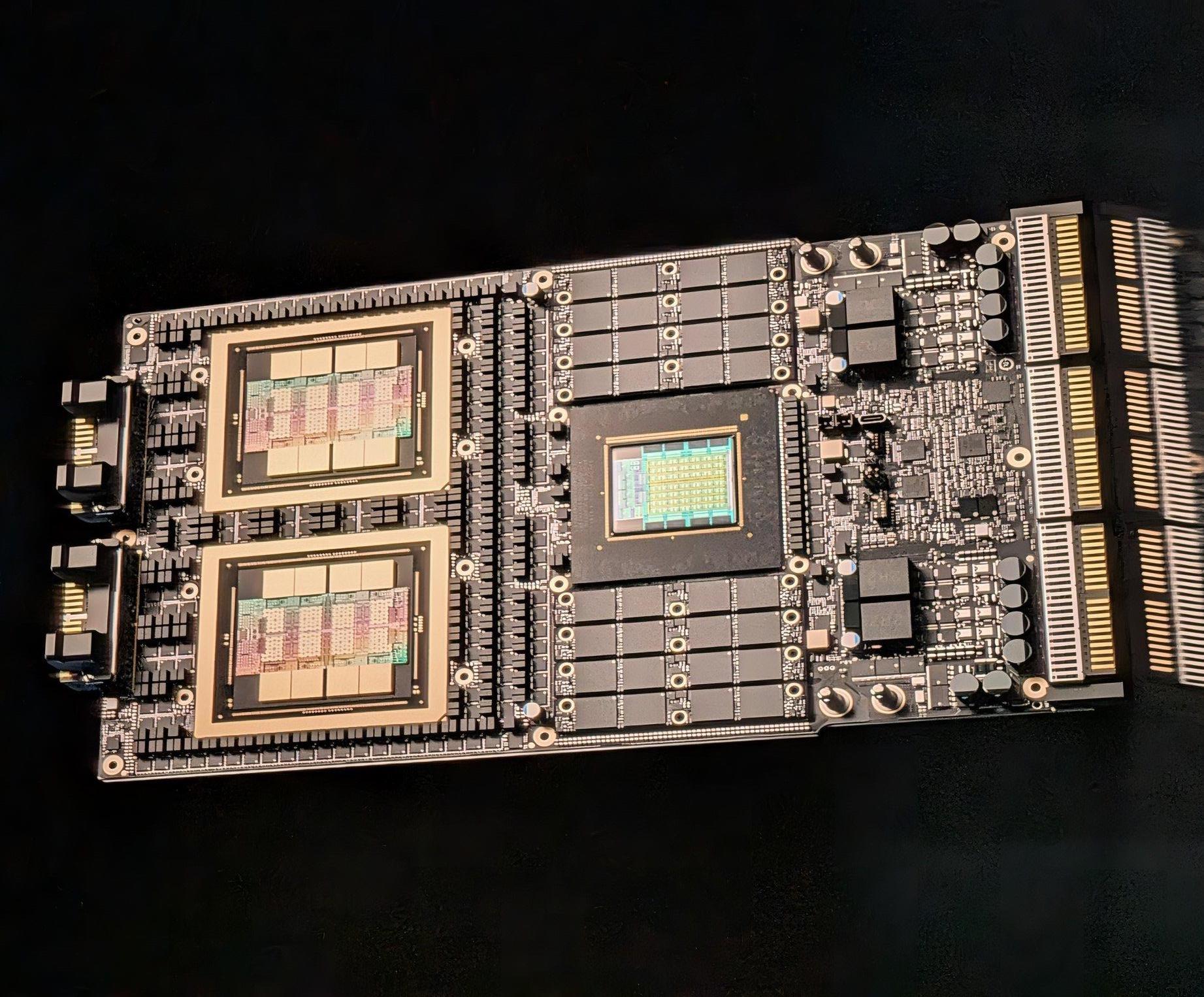

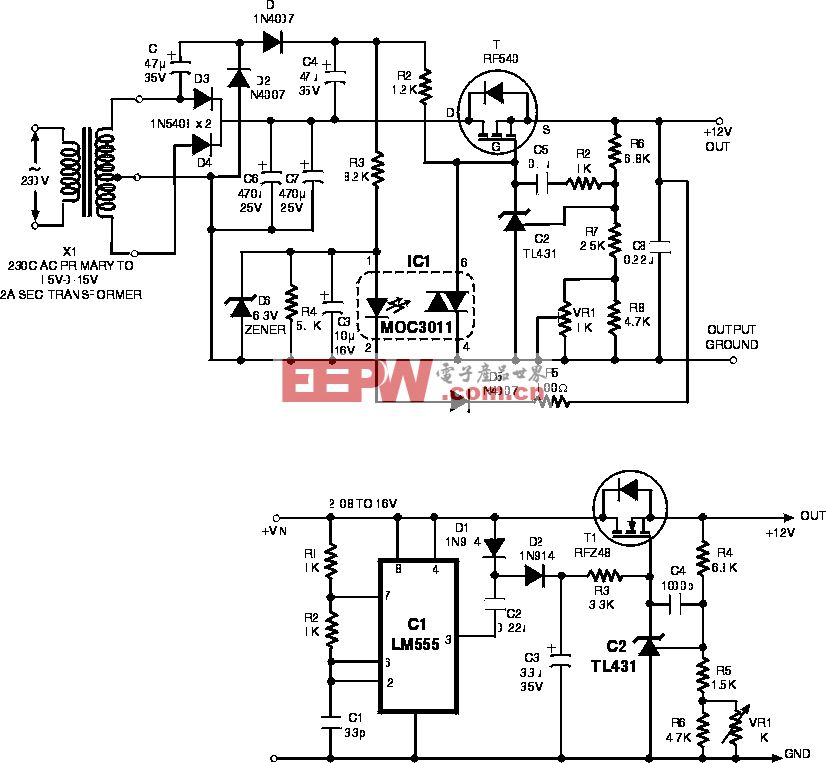

目的和能力:Thor Ultra 充当高速“流量控制器”,用于数据中心内紧密封装的芯片之间数据流动。它使运营商能够部署更多的芯片——在单个集群中多达 100,000+——同时与前几代产品相比,带宽增加了一倍。这对于 AI 工作负载至关重要,因为处理器之间的低延迟通信决定了效率。

技术优势:它基于先进工艺(可能是 5nm 或更好,类似于 Broadcom 之前的 Tomahawk 系列)构建,支持 800G 以太网速度,并针对超大规模 AI 环境中的“横向扩展”架构进行了优化。博通高管强调了其在为分布式系统构建“大型集群”方面的作用。

此次发布建立在博通 2025 年 7 月早些时候发布的 Tomahawk Ultra 的基础上,该 Ultra 针对机架内连接,可以连接比 Nvidia NVLink 多四倍的芯片。Thor Ultra 将其扩展到更广泛的数据中心规模网络,进一步巩固了博通在预计 2027 年价值 60-900 亿美元的人工智能芯片市场中的地位。

背景:OpenAI 交易和更广泛的人工智能推动

就在博通于 2025 年 10 月 13 日宣布与 OpenAI 达成重磅合作伙伴关系的一天后:

两家公司将从 2026 年下半年开始共同开发和部署 10 吉瓦的定制人工智能加速器(相当于为超过 800 万美国家庭供电),并到 2029 年全面部署。

这些“Tensor”芯片针对推理进行了优化,并通过博通的以太网堆栈联网,旨在减少 OpenAI 对目前主导市场的 Nvidia GPU 的依赖。

OpenAI 首席执行官 Sam Altman 强调了集成系统(计算、内存和网络)以降低成本的必要性——估计每个吉瓦数据中心的成本约为 350 亿美元,其中大部分用于芯片。

博通的人工智能收入激增:2025 年第二季度为 44 亿美元(仅网络方面同比增长 170%),预计 2025 财年为 19-200 亿美元,到 2026 年将达到 330 亿美元。受 OpenAI 消息影响,该股上涨 9-10%,将其市值推高至 1.5 万亿美元以上。

博通与英伟达的竞争愈演愈烈

英伟达拥有 ~80-90% 的人工智能加速器市场份额,但博通正在开辟网络层——通常被称为人工智能数据中心的“管道”。这是一个快速比较:

博通并不直接竞争 GPU,而是为替代品(例如谷歌的 TPU)和现在的 OpenAI 的内部设计提供支持。这种“挑起和铲子”的策略——提供基础设施——使博通能够在不受英伟达供应限制的情况下占据 20-30% 的人工智能硬件蛋糕。

市场反应与展望

股票影响:OpenAI 交易后,AVGO 股价上涨 ~10%,反映出投资者押注英伟达 (NVDA) 多元化,英伟达面临出口限制和竞争的波动。

更广泛的影响:随着人工智能需求的爆炸式增长(仅 OpenAI 就承诺在 Nvidia、AMD 和 Oracle 等合作伙伴中实现 33GW),以太网等开放标准可能会侵蚀 Nvidia 的护城河。分析师预计博通的人工智能业务同比增长 60%,但风险包括执行延迟和中美贸易紧张局势。

此次发布凸显了人工智能芯片大战从计算转向连接——博通的悄然崛起可能使其成为构建下一代智能基础设施竞赛中的无名英雄(或英伟达的最大威胁)。

评论