Transformer在计算机视觉领域走到哪了?(1)

编者按:Transformer 模型在自然语言处理(NLP)领域已然成为一个新范式,如今越来越多的研究在尝试将 Transformer 模型强大的建模能力应用到计算机视觉(CV)领域。那么未来,Transformer 会不会如同在 NLP 领域的应用一样革新 CV 领域?今后的研究思路又有哪些?微软亚洲研究院多媒体搜索与挖掘组的研究员们基于 Vision Transformer 模型在图像和视频理解领域的最新工作,可能会带给你一些新的理解。

作为一个由自注意力机制组成的网络结构,Transformer一“出场”就以强大的缩放性、学习长距离的依赖等优势,替代卷积神经网络(CNN)、循环神经网络(RNN)等网络结构,“席卷”了自然语言处理(NLP)领域的理解、生成任务。

然而,Transformer 并未止步于此,2020年,Transformer 模型首次被应用到了图像分类任务中并得到了比 CNN 模型更好的结果。此后,不少研究都开始尝试将 Transformer 模型强大的建模能力应用到计算机视觉领域。目前,Transformer 已经在三大图像问题上——分类、检测和分割,都取得了不错的效果。视觉与语言预训练、图像超分、视频修复和视频目标追踪等任务也正在成为 Transformer “跨界”的热门方向,在 Transformer 结构基础上进行应用和设计,也都取得了不错的成绩。

Transformer“跨界”图像任务

最近几年,随着基于 Transformer 的预训练模型在 NLP 领域不断展现出惊人的能力,越来越多的工作将 Transformer 引入到了图像以及相关的跨模态领域,Transformer 的自注意力机制以其领域无关性和高效的计算,极大地推动了图像相关任务的发展。

端到端的视觉和语言跨模态预训练模型

视觉-语言预训练任务属于图像领域,其目标是利用大规模图片和语言对应的数据集,通过设计预训练任务学习更加鲁棒且具有代表性的跨模态特征,从而提高下游视觉-语言任务的性能。

现有的视觉-语言预训练工作大都沿用传统视觉-语言任务的视觉特征表示,即基于目标检测网络离线抽取的区域视觉特征,将研究重点放到了视觉-语言(vision-language,VL)的特征融合以及预训练上,却忽略了视觉特征的优化对于跨模态模型的重要性。这种传统的视觉特征对于 VL 任务的学习主要有两点问题:

1)视觉特征受限于原本视觉检测任务的目标类别

2)忽略了非目标区域中对于上下文理解的重要信息

为了在VL模型中优化视觉特征,微软亚洲研究院多媒体搜索与挖掘组的研究员们提出了一种端到端的 VL 预训练网络 SOHO,为 VL 训练模型提供了一条全新的探索路径。 该工作的相关论文“Seeing Out of tHe bOx: End-to-End Pre-training for Vision-Language Representation Learning”已收录于CVPR 2021 Oral。

论文链接:https://arxiv.org/abs/2104.03135

GitHub地址:https://github.com/researchmm/soho

SOHO 模型的主要思路是:将视觉编码器整合到 VL 的训练网络中,依靠 VL 预训练任务优化整个网络,从而简化训练流程,缓解依赖人工标注数据的问题,同时使得视觉编码器能够在 VL 预训练任务的指导下在线更新,提供更好的视觉表征。

经验证,SOHO 模型不仅降低了对人工标注数据的需求,而且在下游多个视觉-语言任务(包括视觉问答、图片语言检索、自然语言图像推理等)的公平比较下,都取得了 SOTA 的成绩。

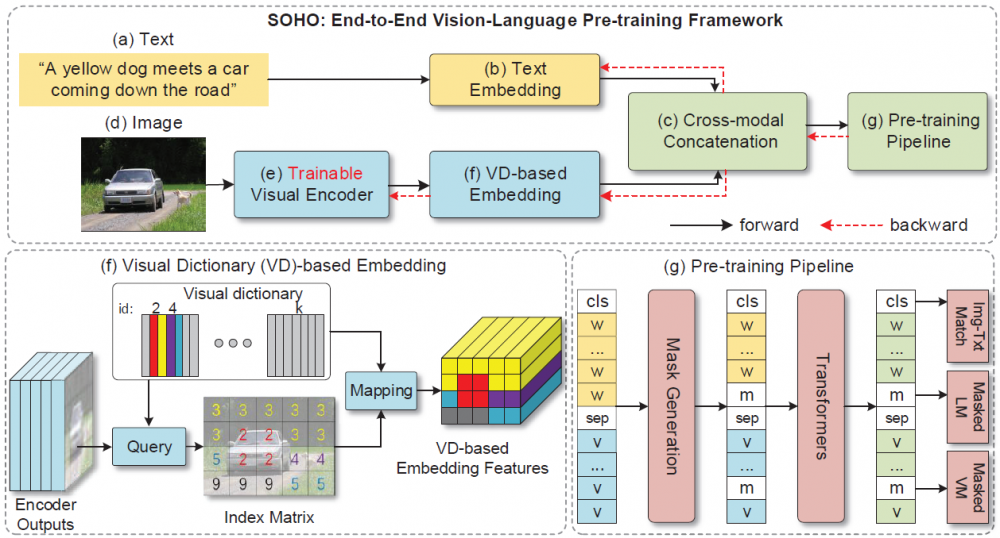

图1:端到端的视觉语言预训练网络 SOHO

如图1所示,SOHO 由三部分组成:1)基于卷积网络的视觉编码器(可在线更新);2)基于视觉字典(Visual Dictionary)的视觉嵌入层;3)由多层 Transformer 组成的 VL 融合网络。三个部分“各司其职”,卷积网络负责将一张图像表征为一组向量,然后利用视觉字典对图像中相近的特征向量进行表征,最后利用 Transformer 组成的网络将基于字典嵌入的视觉特征与文本特征融合到一起。

对于视觉编码器,研究员们采用了 ResNet-101 作为基础网络结构对输入图像进行编码,与基于目标检测模型的图像编码器相比,这种方式的好处是:可以简化操作。为了将图像中相近的特征用统一的特征表征,同时为 MVM(Masked vision Modeling)提供类别标签,研究员们利用了视觉字典。整个字典在网络学习的过程中都采用了动量更新的方式进行学习。基于 Transform 的特征融合网络则采用了和 BERT 相同的网络结构。

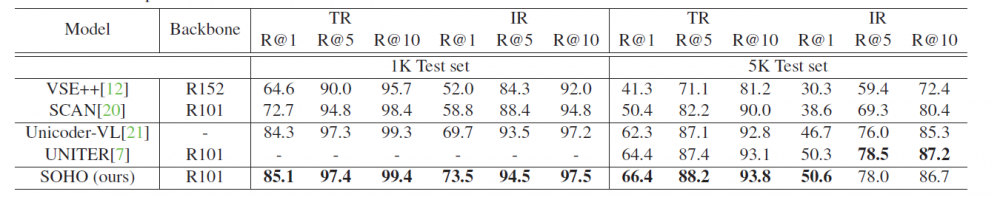

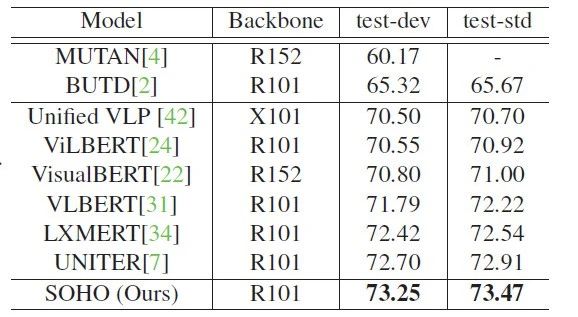

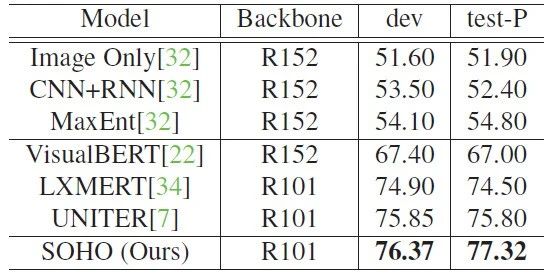

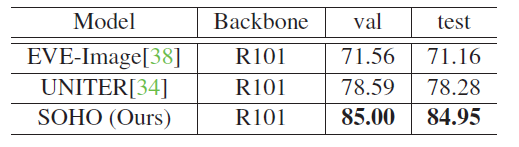

为了优化整个网络,研究员们利用 MVM、MLM(Masked Language Modeling) 以及 ITM(Image-Text Matching) 三个预训练任务进行了模型训练,并将得到的参数应用到了四个相关的 VL 下游任务上,均取得了较好的结果(如表格1-4所示)。

表格1:SOHO 在 MSCOCO 数据集上与其他方法的 text retrieval(TR)和 image retrieval(IR)的性能比较

表格2:SOHO 在 VQA 2.0 数据集上的 VQA 性能表现

表格3:SOHO 在 NLVR2 数据集上的 Visual Reasoning 性能表现

表格4:SOHO 在 SNLI-VE 数据集上的 Visual Entailment 性能表现

最后,通过对视觉字典中部分 ID 对应的图片内容进行可视化(如图2所示),研究员们发现即使没有强监督的视觉类别标注,SOHO 也可以将具有相似语义的视觉内容聚类到同一个字典项中。相对于使用基于目标检测的视觉语言模型,SOHO 摆脱了图片框的回归需求,推理时间(inference time)也加快了10倍,在真实场景应用中更加实际和便捷。

图2:Visual Dictionary 部分 ID 对应图片内容的可视化

基于纹理 Transformer 模型的图像超分辩率技术

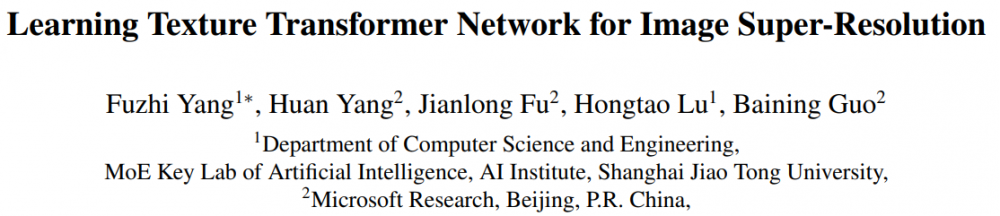

从古老的胶片照相机到今天的数码时代,人类拍摄和保存了大量的图片信息,但这些图片不可避免地存在各种不同程度的瑕疵。将图片变得更清晰、更鲜活,一直是计算机视觉领域的重要话题。针对于图像超分辨率的问题,微软亚洲研究院的研究员们创新性地将 Transformer 结构应用在了图像生成领域,提出了一种基于纹理 Transformer 模型的图像超分辩率方法 TTSR。

该模型可以有效地搜索与迁移高清的纹理信息,最大程度地利用参考图像的信息,并可以正确地将高清纹理迁移到生成的超分辨率结果当中,从而解决了纹理模糊和纹理失真的问题。 该工作“Learning Texture Transformer Network for Image Super-Resolution”发表在 CVPR 2020。

论文链接:https://arxiv.org/pdf/2006.04139.pdf

GitHub地址:https://github.com/researchmm/TTSR

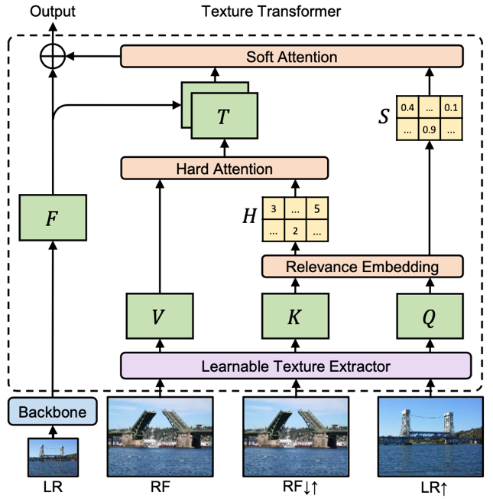

与先前盲猜图片细节的方法不同,研究员们通过引入一张高分辨率参考图像来指引整个超分辨率过程。高分辨率参考图像的引入,将图像超分辨率问题由较为困难的纹理恢复/生成转化为了相对简单的纹理搜索与迁移,使得超分辨率结果在指标以及视觉效果上有了显著的提升。如图3所示,TTSR 模型包括:可学习的纹理提取器模块(Learnable Texture Extractor)、相关性嵌入模块(Relevance Embedding)、硬注意力模块(Hard Attention)、软注意力模块(Soft Attention)。

图3:纹理 Transformer 模型

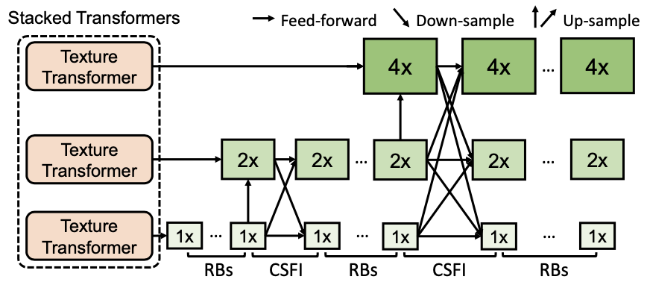

传统 Transformer 通过堆叠使得模型具有更强的表达能力,然而在图像生成问题中,简单的堆叠很难产生很好的效果。为了进一步提升模型对参考图像信息的提取和利用,研究员们提出了跨层级的特征融合机制——将所提出的纹理 Transformer 应用于 x1、x2、x4 三个不同的层级,并将不同层级间的特征通过上采样或带步长的卷积进行交叉融合。因此,不同粒度的参考图像信息会渗透到不同的层级,使得网络的特征表达能力增强,提高生成图像的质量。

图4:多个纹理 Transformer 跨层级堆叠模型

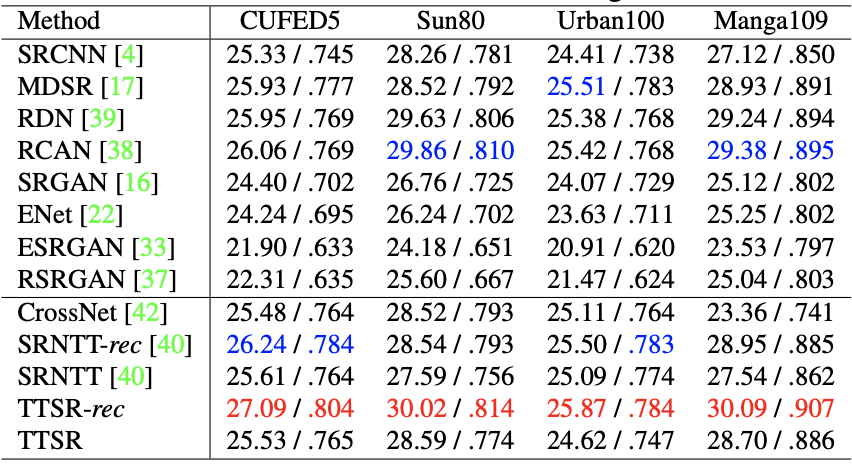

研究员们在 CUFED5、Sun80、Urban100、Manga109 数据集上针对 TTSR 方法进行了量化比较,具体如表格5所示。图5展示了 TTSR 与现有的方法在不同数据集上的视觉比较结果,可以发现 TTSR 显著领先于其他方法的结果。

表格5:TTSR 与现有方法在不同数据集上的量化比较结果

图5:TTSR 与现有方法在不同数据集上的视觉比较结果

了解更多 TTSR 细节,可点击查看此前的文章:CVPR 2020丨图像超清化+老照片修复技术,拯救你所有的模糊、破损照片。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。