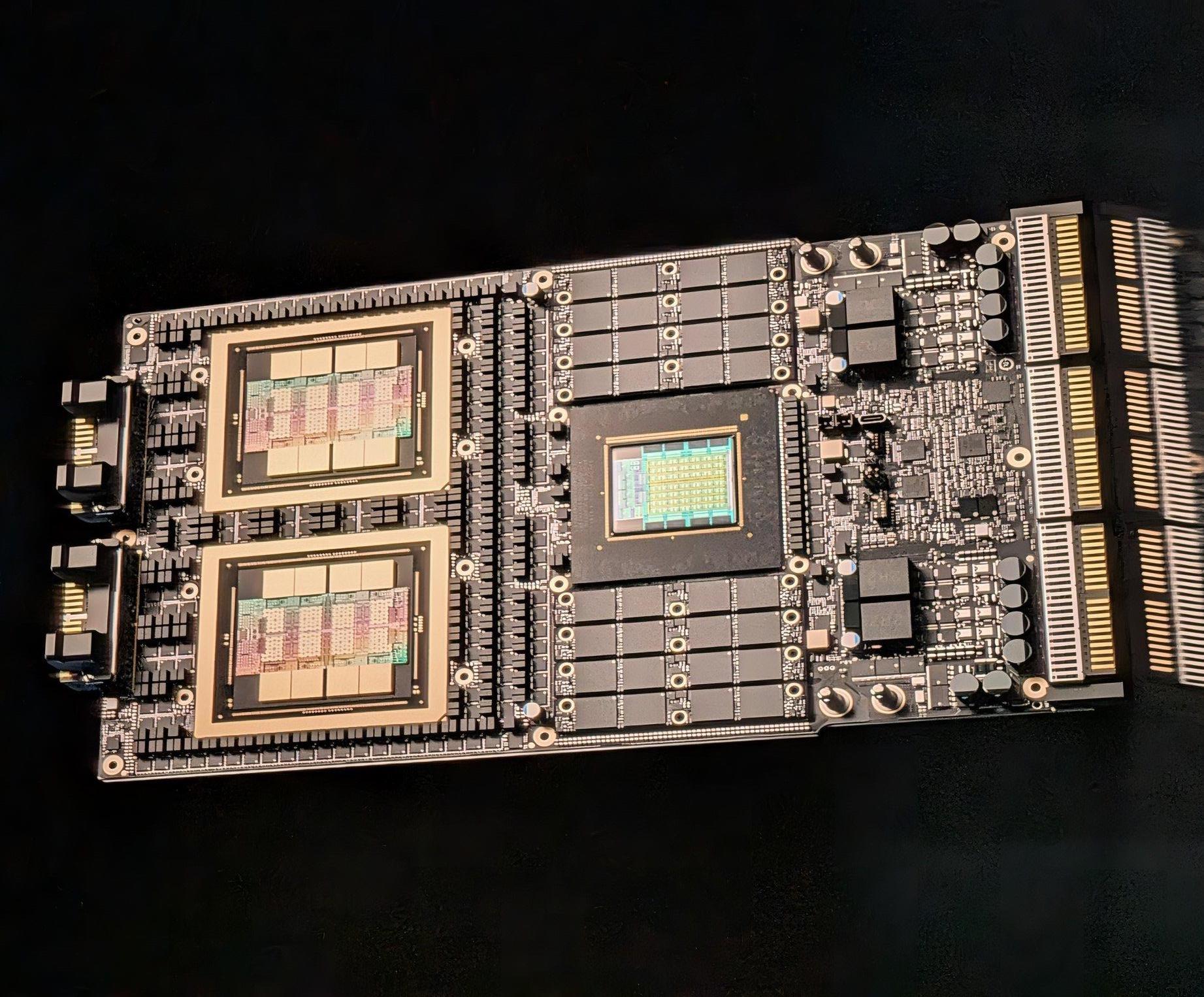

片上网络(NoC)至关重要:打造下一代AI SoC的核心骨架

面向 AI 负载的现代 SoC 设计,已彻底改变片上网络(NoC) 的定位 —— 它从简单的互联总线,升级为决定系统性能、功耗与扩展性的核心架构要素。随着计算密度提升、异构加速器普及,数据搬运已成为系统性能的主导因素。因此,NoC 架构必须作为顶层设计决策,而非后期集成环节。

白皮书《下一代 SoC 架构设计考量:搭配 Arteris 的 NoC》指出:现代 AI SoC 的瓶颈不在计算,而在仲裁、内存访问与互联带宽。这使得 NoC 拓扑、缓存机制与服务质量(QoS)策略,成为达成性能目标的关键。

AI SoC 与传统设计的差异

AI SoC 在流量特征与集成复杂度上,均与传统设计截然不同。

现代系统集成 CPU、GPU、NPU、DSP 与领域专用加速器,产生突发式、高并发的流量,对资源竞争与尾部延迟高度敏感。

这对传统总线架构构成挑战,需要可扩展的 NoC 拓扑来平衡吞吐量与延迟。

同时,先进工艺节点导致线延迟增加、布线拥塞,物理实现约束与架构决策深度绑定。

拓扑选择必须同时考虑逻辑跳数与布局可行性—— 过长的物理互联会抵消理论性能优势。

缓存一致性:AI SoC 的关键架构决策

AI SoC 中最重要的架构决策之一,是一致性模型:

硬件缓存一致性:简化编程,但会产生一致性流量,带来扩展性挑战(侦听 / 目录机制)。

软件管理一致性:降低硬件复杂度,加速器行为可预测,但会增加编译器与运行时开销。

专用 AI 加速器通常倾向软件管理内存,以避免不可预测的延迟;而异构 SoC 则多采用混合方案,保持与传统 CPU 集群的兼容。

一致性选择直接影响 NoC 流量、仲裁逻辑与内存层次结构,说明互联架构无法与系统级内存决策分离。

面向混合负载的专用 NoC 硬件单元

除拓扑与一致性外,专用 NoC 硬件单元对处理混合负载必不可少:

位宽适配器:实现突发吸收与时钟域跨接

重排序缓冲:保证多目标事务的顺序性

QoS 仲裁逻辑:确保延迟敏感流量优先于大块数据传输

这些特性保证高负载下延迟可预测,对同时承载控制流量与张量数据搬运的 AI 系统至关重要。

若缺乏精心设计的 QoS 策略,关键实时事务可能被 “饿死”,导致性能波动与系统效率下降。

物理布局对 NoC 的关键影响

物理布局在 NoC 设计中扮演重要角色:

集中式互联:逻辑复杂度低,但易造成布线拥塞与时序收敛风险

分布式 NoC:更适配分区布局,缩短长线长度

因此,早期架构建模必须纳入时钟域、电源分区、IP 位置等物理可行假设。

忽略这些因素,往往导致后期重新设计,增加项目风险与工程成本。

NoC 结构化设计方法

结构化的 NoC 开发方法可降低实现风险,典型流程:

流量建模与高层性能分析

拓扑探索与布局对齐

插入流水线保证时序收敛

基于物理综合约束做验证

架构建模与物理实现之间的迭代反馈,可在 RTL 投入前确定可行方案。

拓扑生成工具等自动化框架,可将布局意识嵌入探索过程,进一步提升效率、缩短线长、降低延迟。

分区与低功耗:可扩展 NoC 的必备能力

随着 SoC 扩展,物理分区不可避免(电源域、时钟岛、组织边界)。

分区 NoC 必须在保持连通性的同时,支持:

隔离

数据保持

电源切换时的复位序列

跨域协调复杂,必须早期规划,避免功能与验证问题。

合理设计可确保 NoC 在低功耗状态与唤醒序列中正常运行,不出现死锁或数据损坏。

结论

为现代 AI SoC 设计 NoC,需要全局统筹:流量特征、一致性模型、拓扑、QoS 机制、物理布局与电源管理。

将 NoC 视为系统级设计问题,而非事后互联补全,才能在日益复杂的异构芯片平台中,实现可扩展性能、高效功耗与可预测的项目进度。

评论