普华永道2018预测:这一年 人工智能最有可能是这幅模样

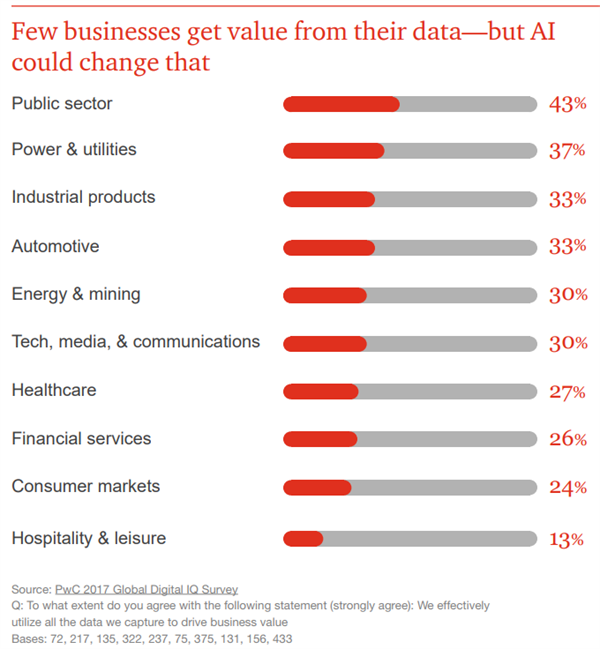

AI能帮助分析数据相关的问题

尽管近年来有关大数据技术优点的报道不绝于耳,但很多公司还没有看到丰厚的回报。

现在,一些公司正在重新考虑他们的数据分析策略,并开始找到重点。

比如说,一个医疗保健AI系统的目标是改善病人的预后恢复。

在开始开发一个自动化系统以促进这一过程之前,供应商将对人工智能带来的好处进行量化。

供应商将会考虑需要哪些数据——电子病历、相关期刊文章、临床试验数据,以及获取和整理这些数据的成本。

在这个过程中,企业还可以结合其它新技术来简化流程,比如自然语言处理、服务平添、公共云计算技术、机器学习技术。

但其中还有很多挑战,比如保证数据的标准化和正确率。存在偏差和异常的数据可能导致错误的结果。与此同时,还要考虑到个人隐私问题。

59%的高管表示,他们公司的大数据分析将通过使用人工智能得到改善。

在AI竞赛中取胜的将是各领域专家而非IT人员

论文称,人工智能越来越需要数据科学家和人工智能专家通常缺乏的知识和技能。

一个能支持资产管理系统的AI程序不仅仅需要计算机科学家,还需要经济学家、分析师和交易员。而且,由于金融市场瞬息万变,这个系统还需要进行不断的调整。

仅仅让程序员来运行和调整这个系统是不够的。

67%的需要数据科学和分析的工作都处于在人工智能以外的领域。

黑客攻击和相应的网络防御技术也将更厉害

在黑客攻击方面,人工智能已经显示出优于人类的优势。

例如,机器学习技术可以让一个恶意的参与者在社交媒体上跟踪一个人的行为,然后为他们定制钓鱼推文或电子邮件。

人工智能越进步,网络攻击的可能性就越大。人工智能技术本身也可能被黑客利用,例如,黑客可以将存在偏差的数据注入算法的训练集。

普华永道指出,另一方面,“与云计算技术相结合的可伸缩机器学习技术正在分析大量数据,并提供实时威胁检测和分析。”

人工智能的能力还能迅速识别出网络攻击激增的“热点”,并提供情报报告。

尽管如此,“网络战争不会仅仅是两台电脑互相对抗。”普华永道在报告中表示。即使在网络安全领域,也需要人类的参与。

27%的高管表示,他们的组织计划今年投资于使用人工智能和机器学习的网络安全防护措施。

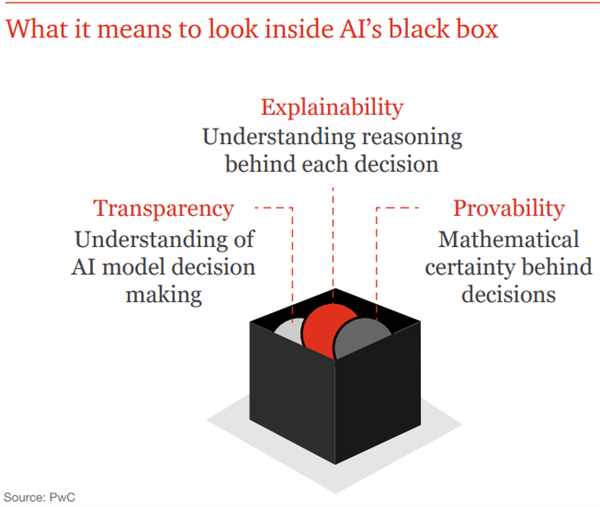

当务之急是打开AI的“黑盒子”

报告指出,许多人工智能算法都超出了人类的理解能力。

一些人工智能供应商不会透露他们的程序是如何工作的,以保护知识产权。

在这两种情况下,当人工智能系统产生一个决定时,许多用户都不知道它是如何做出决定的。

根据普华永道的说法,这些风险也是真实存在的,但也是可控的。

“这其中有一个关于人工智能的秘密,许多人工智能支持者都不愿意提及:目前的人工智能并没有那么聪明——至少现在还没有发展到可以统治人类的那种地步。”

“它仍然遵循人类设计的规则。”

人工智能的这种原理不透明可能会引发用户的不信任感,限制了其的推广。

普华永道的报告中预计,许多开发人工智能的公司将面临监管压力,要求他们公布其程序设计的原理,达到一定的透明度。

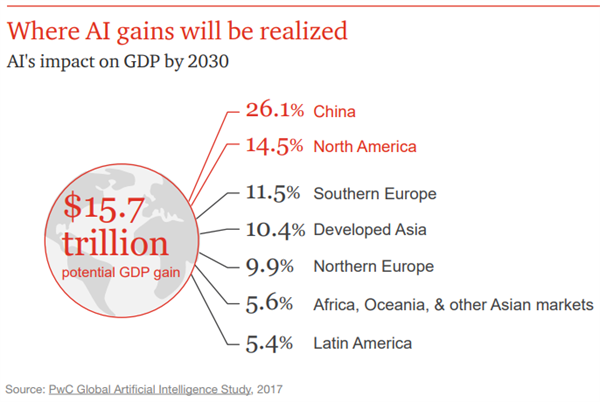

国家政策将对人工智能发展水平产生影响

根据我们的研究,到2030年,人工智能的规模将达到15.7万亿美元。

人工智能的规模如此之大,以至于除了个别公司之外,许多国家也在制定关于人工智能技术的发展战略。

普华永道的研究表明,在未来10年,中国将从人工智能中获益最多:到2030年,中国的GDP将增长7万亿美元,这要归功于生产力和消费的增长。

不仅仅是科技公司要担负起使用AI的责任

普华永道(PwC)在2017年进行的一项调查中,有77%的首席执行官表示,人工智能和自动化将增加企业的脆弱性和对企业经营方式的影响。

可能会有民众担心AI系统中存在偏见,有客户担心AI系统的可靠性,有董事会担心AI辅助决策的风险、回报和对品牌的影响。

许多企业将需要建立新流程和团队来寻找数据和模型中的偏差,确定他们的AI系统没有出问题,防范可能的算法“欺骗”。

评论