基于多传感器信息融合的智能交通信息语义描述

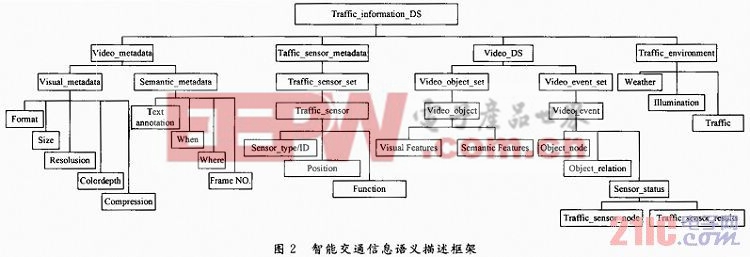

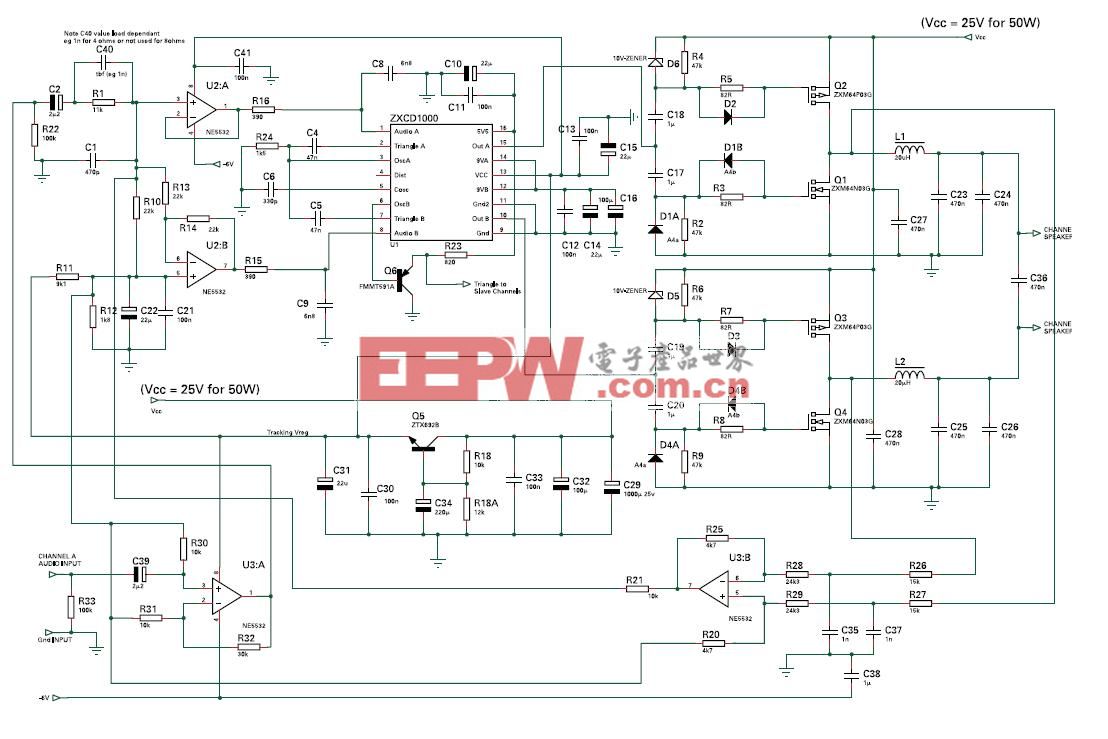

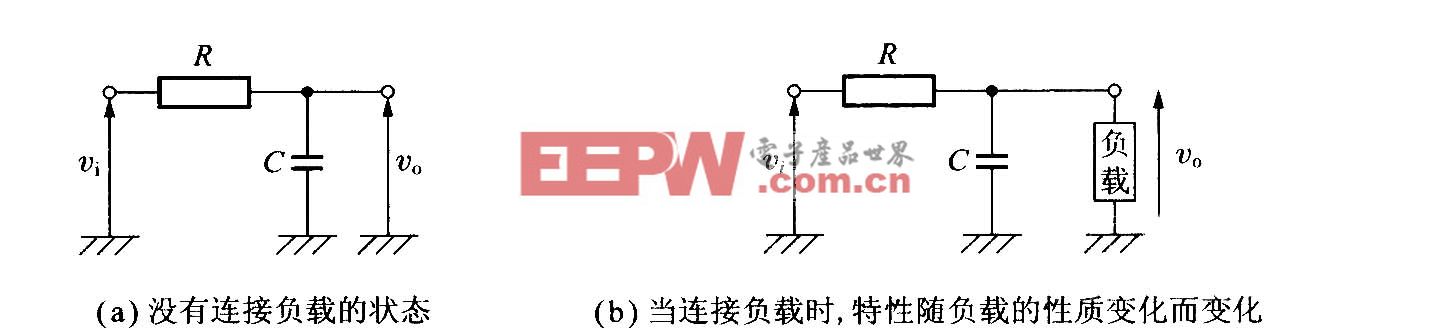

基于MPEG-7标准,提出智能交通信息语义描述框架,描述的信息包括摄像头采集的视频信息和智能交通传感器信息。总体框架如图2所示。本文引用地址:http://www.eepw.com.cn/article/160870.htm

下面将阐述语义描述框架的各个组成成分:

2.1 Video_metadata

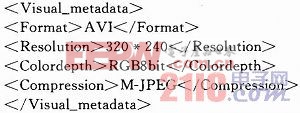

Video_metadata主要是对每一帧视频做一般性描述,分为视觉元数据(Visual_metadata)和语义元数据(Semantic_metadata)。这部分数据并不包含视频内容本身。视觉元数据主要包括格式、大小、分辨率、颜色深度、压缩方式,语义元数据主要包括文本标注、时间、地点、该视频帧编号(Frame NO.)。

例如某一帧视频的Visual_metadata描述如下:

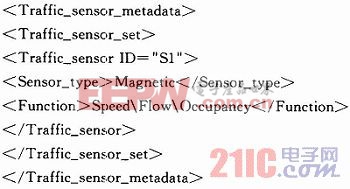

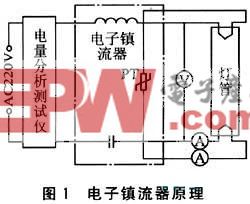

2.2 Traffic_sensor_metadata

Traffic_sensor_metadata主要描述的是该路段所布设的智能交通传感器的信息,包括布设了哪些传感器,该传感器所处的位置,传感器的功能。这部分描述也不包含视频本身的信息。加入这部分描述是为了将多传感器的信息内容整合起来,便于用户查询整个系统的信息。

例如对于磁敏传感器信息描述如下:

2.3 Video_DS

Video_DS是对摄像头采集到的某一帧视频信息进行语义描述,这部分是整个语义描述框架的核心,直接影响到用户的信息检索。这部分的主要任务就是描述视频中所出现的交通对象和视频中出现的交通事件。其中Video_object_set表示的是视频中所出现的所有交通对象的集合。在每一帧视频中,提取的交通对象分为4类:车辆(各种机动车和非机动车)、行人、道路(单行道、双行道、左拐车道、右拐车道)、交通标识(车道线、停车线、交通信号灯)。

评论