OpenAI Atlas 浏览器漏洞允许恶意代码注入 ChatGPT

OpenAI Atlas 浏览器漏洞详情

OpenAI 新推出的 ChatGPT Atlas 浏览器存在一项严重漏洞,攻击者可借此向 ChatGPT 的内存中注入恶意指令,并在用户系统上执行远程代码。

该漏洞由 LayerX 发现,利用跨站请求伪造(CSRF)技术劫持已验证会话,可能导致设备感染恶意软件或被未授权访问。这一发现凸显了智能体化 AI 浏览器的风险升级 —— 集成的大语言模型(LLM)会放大传统网络威胁。

该漏洞已通过负责任披露协议告知 OpenAI,所有浏览器环境中的 ChatGPT 用户均受影响,但 Atlas 用户面临的风险更高。原因在于其持续在线的验证机制和薄弱的钓鱼防护能力。

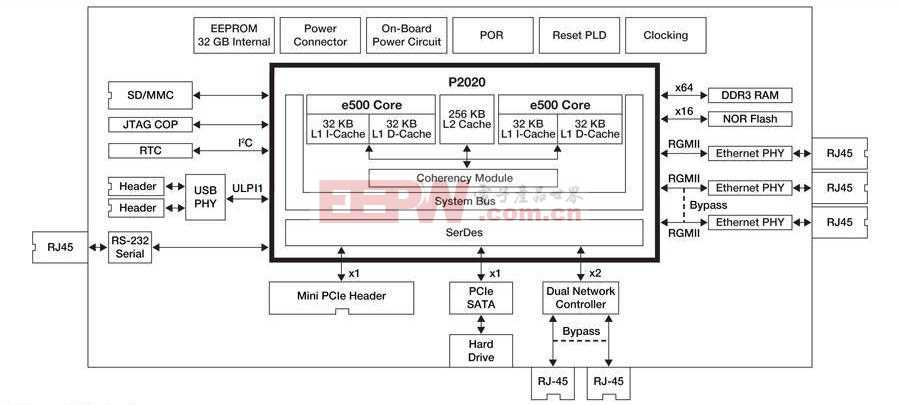

LayerX 的测试显示,Atlas 仅能拦截 5.8% 的钓鱼攻击,而 Chrome 和 Edge 的拦截率为 47% 至 53%,这使得 Atlas 用户的暴露风险最高可达 90%。尽管 OpenAI 尚未公开补丁细节,但专家呼吁立即采取缓解措施,例如加强令牌验证。

CSRF 如何针对 ChatGPT 内存攻击

攻击的前提是用户已登录 ChatGPT,且浏览器中存储了验证 Cookie 或令牌。攻击者通过钓鱼链接诱使受害者访问恶意网页,该网页随后利用现有会话发起 CSRF 请求。

这一伪造请求会向 ChatGPT 的 记忆功能注入隐藏指令。该功能的设计初衷是保留用户偏好和会话上下文,避免用户重复输入。

与未授权交易等标准 CSRF 攻击后果不同,这种变体攻击通过污染大语言模型的持久化 “潜意识” 来针对 AI 系统。

恶意指令嵌入后,会在用户发起合法查询时激活,迫使 ChatGPT 生成有害输出 —— 例如从攻击者控制的服务器获取远程代码。这种感染会在该账号关联的所有设备和浏览器中持续存在,增加了检测和修复的难度。

Atlas 默认自动登录 ChatGPT 的机制使凭证随时可用,无需额外的令牌钓鱼步骤,从而简化了 CSRF 攻击的实施。

LayerX 在 103 起真实攻击场景中对 Atlas 进行了测试,发现 94.2% 的攻击均成功得逞,远逊于同类产品 —— 例如此前测试中 Perplexity 的 Comet 浏览器失败率为 93%。这一结果源于 Atlas 缺乏内置防护机制,使其成为提示注入等 AI 专属威胁的主要传播载体。

更广泛的研究也印证了这一担忧:Brave 对包括 Atlas 在内的 AI 浏览器的分析发现,存在通过网页或截图嵌入指令的间接提示注入攻击,可能导致数据泄露或未授权操作。

OpenAI 的代理功能允许自主任务,由于授予人工智能对用户数据和系统的决策权而加剧了风险。

概念验证:恶意 vibe 编码

在一个演示场景中,攻击者针对 vibe 编码发起攻击。这种编程模式下,开发者与 AI 协作聚焦于高层级的项目意图,而非严格的语法规则。

注入的内存指令会巧妙篡改 AI 输出,在生成的脚本中嵌入后门或数据泄露代码 —— 例如从 “server.rapture” 等服务器下载恶意软件。

ChatGPT 可能会发出微弱警告,但复杂的伪装技术通常能规避这些警告,使受污染的代码无缝交付。用户下载此类脚本后,其系统可能被入侵,这也凸显了 AI 的灵活性可能被滥用的风险。

该概念验证与 Gemini 等工具中新兴的漏洞一致,其中类似的注入会访问共享的公司数据。

随着 AI 浏览器的普及,此类漏洞需要超越基础浏览器技术的强效防护措施。企业应优先采用具备可见性的第三方扩展程序,用户则应启用多因素认证并监控会话状态。

LayerX 的研究结果表明,若不及时更新修复,Atlas 可能会重新定义 AI 安全的典型陷阱。

评论