AI芯片之战:TPU/GPU/FPGA谁称雄?

智能时代就要到来,芯片市场格局一变再变。两个典型例子:引领处理器市场 40 多年的英特尔 2015 年底收购完 Altera,今年 4 月就宣布计划裁员 1.2 万;另一方面,GPU 巨头英伟达今年 3 月推出加速人工智能和深度学习的芯片 Tesla P100,投入研发经费超过 20 亿美元,据《华尔街日报》报道,今年 5 月英伟达售出的 GPU 比去年同月增长 62%,公司当前市值 240 亿美元。

本文引用地址:http://www.eepw.com.cn/article/201808/390001.htm深度学习应用大量涌现使超级计算机的架构逐渐向深度学习应用优化,从传统 CPU 为主 GPU 为辅的英特尔处理器变为 GPU 为主 CPU 为辅的结构。不过,未来相当长一段时间内,计算系统仍将保持 CPU + 协处理器的混合架构。但是,在协处理市场,随着人工智能尤其是机器学习应用大量涌现,芯片厂商纷纷完善产品、推出新品,都想成为智能时代协处理器的领跑者——但问题是,谁会担当这个角色呢?

TPU:始于谷歌,终于谷歌

要说新的芯片,首先不得不提谷歌在刚刚结束的 I/O 大会上披露的 TPU。

有舆论称,谷歌自己打造芯片,势必对芯片制造商产生巨大影响。确实,面向机器学习专用的处理器是芯片行业的发展趋势,而且未来其他大公司也很有可能组建芯片团队,设计自己专用的芯片。

谷歌TPU芯片

TPU 团队主要负责人、计算机体系结构领域大牛 Norm Jouppi 介绍,TPU 专为谷歌 TensorFlow 等机器学习应用打造,能够降低运算精度,在相同时间内处理更复杂、更强大的机器学习模型并将其更快投入使用。 Jouppi 表示,谷歌早在 2013 年就开始秘密研发 TPU,并且在一年前将其应用于谷歌的数据中心。TPU 从测试到量产只用了 22 天,其性能把人工智能技术往前推进了差不多 7 年,相当于摩尔定律 3 代的时间。

有媒体评论称 TPU 不仅为谷歌带来了巨大的人工智能优势,也对市面上已有的芯片产品构成了威胁。

这后半句话值得商榷。GPU 巨头、英伟达 CEO 黄仁勋日前告诉《华尔街日报》,两年前谷歌就意识到 GPU 更适合训练,而不善于做训练后的分析决策。由此可知,谷歌打造 TPU 的动机只是想要一款更适合做分析决策的芯片。这一点在谷歌的官方声明里也得到了印证:TPU 只在特定机器学习应用中作辅助使用,公司将继续使用其他厂商制造的 CPU 和 GPU。

谷歌云服务副总裁 Diane Greene 也表示,谷歌并没有对外销售 TPU 的打算——抛开 TPU 本来就是为了谷歌自己设计的这个事实以外,谷歌对外销售芯片的可能性很低,就像 Facebook 主张全球提供免费互联网,也并不是自己要做运营商。

因此,TPU 再好,也仅适用于谷歌,而且还是用于辅助 CPU 和 GPU。

TrueNorth 坐山观虎斗?

第二个要说的是 IBM TrueNorth。IBM 在 2014 年研发出脉冲神经网络芯片 TrueNorth,走的是“类脑计算”的路线。类脑计算的假设是,相似的结构可能会实现相似的功能,所以类脑计算研究者使用神经形态器件制造与人脑神经网络相似的电子神经网络,希望后者具有与人脑类似的功能,并进一步反过来理解人类智能。

带有IBM TrueNorth的DRAPA SyNAPSE

TrueNorth 一张邮票大小,有 54 亿个晶体管,构成的神经元阵列包含 100 万个数字神经元,这些神经元之间又通过 2.56 亿个电突触彼此通信。由于采用了异步架构,TrueNorth 的能耗很低,54 亿个晶体管仅用 70 毫瓦;而且,只有在特定神经元被开启并和其他神经元通信时才会产生能耗。TrueNorth 设计师 Filipp Akopyan 表示,TrueNorth 的目标是 Edge-of-the-Net 和大数据解决方案,所以必须要能够用超低功耗实时处理大量数据。

在此基础上,2016年 4 月 IBM 推出了用于深度学习的类脑超级计算平台 IBM TrueNorth,含 16 个 TrueNorth 芯片,处理能力相当于 1600 万个神经元和 40 亿个神经键,消耗的能量只需 2.5 瓦。

将低能耗芯片用于深度学习无疑是一大重举,美国 LLNL 数据科学副主任 Jim Brase 表示,类脑计算与未来高性能计算和模拟发展趋势一致。但是,新智元芯片群的几位专家讨论后一致认为,TrueNorth 虽然与人脑某些结构和机理较为接近,但智能算法的精度或效果有待进一步提高,离大规模商业应用还有一段距离。

因此,未来 10 年芯片市场群雄逐鹿,TrueNorth 大概不会有亮相的机会。

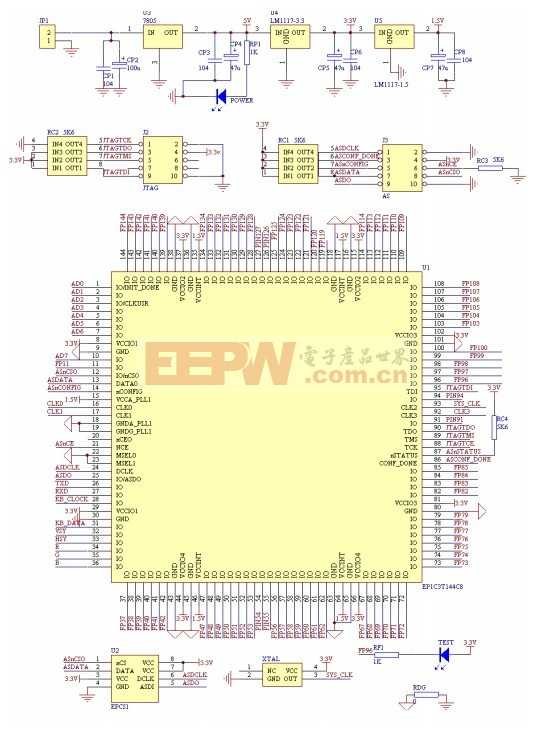

寒武纪:中国的智能芯片

寒武纪是国际首个深度学习专用处理器芯片。2012 年,中科院计算所和法国 Inria 等机构共同提出了国际上首个人工神经网络硬件的基准测试集 benchNN。这项工作提升了人工神经网络处理速度,有效加速了通用计算,大大推动了国际体系结构学术圈对神经网络的接纳度。此后,中科院计算所和法国 Inria 的研究人员共同推出了一系列不同结构的 DianNao 神经网络硬件加速器结构。

寒武纪芯片板卡

2016 年 3 月,中科院计算所陈云霁、陈天石课题组、寒武纪公司提出的寒武纪深度学习处理器指令集 Cambricon 被计算机体系结构领域顶级国际会议 ISCA 2016 接收,在所有近 300 篇投稿中排名第一,在深度学习处理器指令集方面取得了开创性进展。指令集是计算机软硬件生态体系的核心,英特尔和 ARM 正是通过其指令集控制了 PC 和嵌入式生态体系。

2016 年 4 月,寒武纪进入产业化运营,陈天石也从中科院计算所的副研究员变成了北京中科寒武纪科技有限公司的 CEO。陈天石表示,寒武纪产业化运营的主要方向将是高性能服务器芯片、高能效终端芯片和服务机器人芯片。

寒武纪芯片预计 2018 年左右上市,其表现如何,值得期待。

后起之秀概率芯片

2016 年 4月16 日,MIT Techonolgy Review 报道,DARPA 投资了一款叫做“S1”的概率芯片。模拟测试中,使用 S1 追踪视频里的移动物体,每帧处理速度比传统处理器快了近 100 倍,而能耗还不到传统处理器的 2%。MIT 媒体实验室教授、Twitter 首席媒体科学家 Deb Roy 评论称,近似计算的潮流正在兴起。

美国 Singular Computing 公司开发的“S1”概率芯片(来源:MIT Techonolgy Review)

纽约州立大学石溪分校终身教授顾险峰从最基础的数学层面分析了概率芯片的优点,专用概率芯片可以发挥概率算法简单并行的特点,极大提高系统性能。概率芯片所使用的随机行走概率方法有很多优点:算法逻辑异常简单,不需要复杂的数据结构,不需要数值代数计算;计算精度可以通过模拟不同数目的随机行走自如控制;不同的随机行走相互独立,可以大规模并行模拟;模拟过程中,不需要全局信息,只需要网络的局部信息。

顾险峰最后总结,随着英特尔重组,传统 CPU 体系机构独霸江山的时代将一去不复返,概率芯片和其他更多采用全新架构的专用处理器分庭抗礼的时代即将来临。

早在 2008 年 MIT Techonolgy Review “十大科技突破”预测中,概率芯片就榜上有名。通过牺牲微小的计算精度换取能耗明显降低,概率芯片在历来追求精准的芯片领域独树一帜,但正因如此,再考虑到 DARPA 已经投资 S1,概率芯片很可能后来居上。

实力股 FPGA

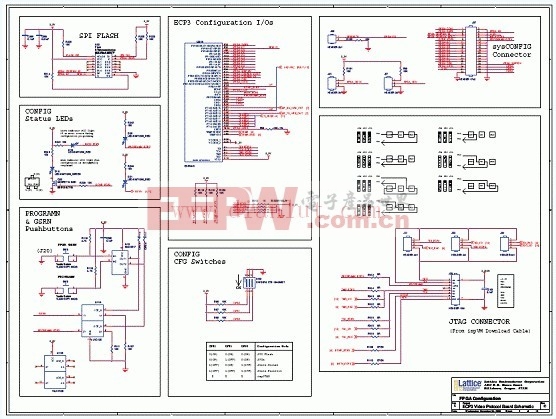

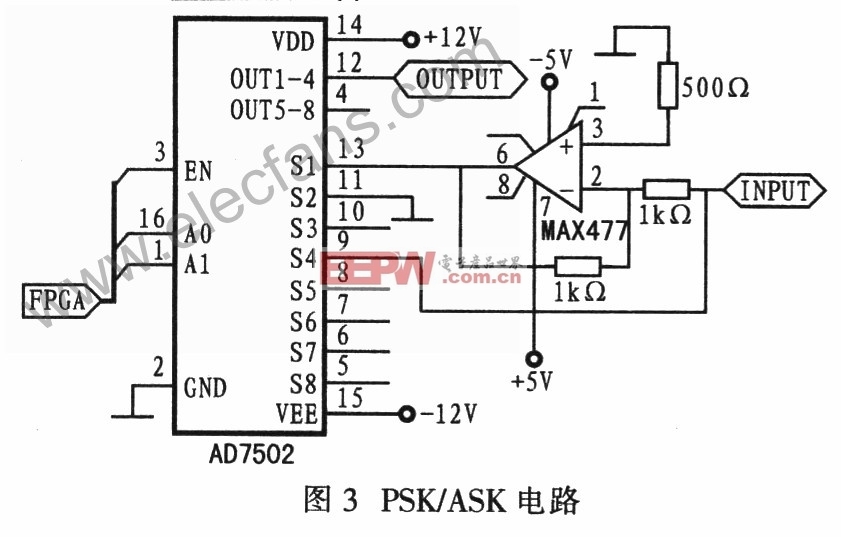

2012年,百度决定自主设计深度学习专有的体系结构和芯片,经过深入研究和论证,为了让项目快速落地及迭代,工程师最后决定使用 FPGA 实现百度第一版自主设计的深度学习专有芯片。

作为 GPU 在算法加速上强有力的竞争者,FPGA 硬件配置最灵活,单位能耗也通常比 GPU 低。更重要的是,FPGA 相比 GPU 价格便宜(虽然性价比不一定是最好的)。使用 FPGA 需要具体硬件的知识,对许多开发者有一定难度,因此 FPGA 也常被视为一种行家专属的架构。不过,现在也出现了用软件平台编程 FPGA,弱化了软硬件语言间的障碍,让更多开发者使用 FPGA 成为可能。

加州大学计算机博士刘少山认为,FPGA 具有低能耗、高性能以及可编程等特性,十分适合感知计算。在能源受限的情况下,FPGA 相对于 CPU 与 GPU 有明显的性能与能耗优势。FPGA 低能耗的特点很适合用于传感器的数据预处理工作。此外,感知算法不断发展意味着感知处理器需要不断更新,FPGA 具有硬件可升级、可迭代的优势。刘少山预计,FPGA 与传感器的紧密结合将会很快普及,而后随着视觉、语音、深度学习的算法在 FPGA 上的不断优化,FPGA 将逐渐取代 GPU 与 CPU 成为机器人上的主要芯片。

目前还没有任何深度学习工具明确支持 FPGA,但显然它是一支实力股。

GPU:未来市场霸主?

凭借强大的并行计算能力,在机器学习快速发展的推动下,GPU 目前在深度学习芯片市场非常受欢迎,大有成为主流的趋势。互联网巨头,比如谷歌、Facebook、微软、Twitter 和百度等公司都在使用 GPU 分析图片、视频和音频文件,改进搜索和图像标签等应用功能。GPU 也被应用于 VR/AR 相关的产业。此外,很多汽车生产商也在使用 GPU 作为传感器芯片发展无人车。可以说,GPU 是眼下智能产品市场用户覆盖率最广泛的芯片。

研究公司 Tractica LLC 预计,到 2024 年深度学习项目在 GPU 上的花费将从 2015 年的 4360 万增长到 41 亿美元,在相关软件上的花费将从 1.09 亿增长到 104 亿。

但是,也有人认为通用芯片 GPU 相比深度学习专用芯片并不具有优势。

这有一定道理。然而,设计新的芯片需要很多年,研发成本可能高达几千万甚至几十亿美元。而且,专用芯片比通用芯片更难编程。最重要的是,专用芯片——根据定义——只提升特定任务的性能表现,这也是为什么谷歌要制作 TPU 辅助 GPU 和 CPU。

英伟达工程架构副总裁 Marc Hamilton 表示,谷歌的 TPU 是一个非常有意思的技术,但其发布进一步印证了他们的观点,那就是人工智能处理器将继续从通用的 CPU 转向 GPU 和 TPU 等其他芯片。此外,GPU 技术也在不断发展,从算法层面加速智能感知计算速度。

Hamilton 还提到了百度人工智能科学家 Bryan Catanzaro 的话:深度学习并不是一个那么窄的领域,从计算角度看,深度学习是多样化的而且演化迅速;要是制造一款适用于所有深度学习应用的专用芯片,本质上也就成了 GPU 或 DSP。

当然,GPU 也有缺陷,比如不如 FPGA 灵活。同时,GPU 也不乏竞争者:除了同样具备并行计算能力的 AMD,Nervana、Movidius 等公司都在制作与 GPU 类似的芯片,但侧重于把数据更快转移和分摊给图像所需要的功能。

小结

除了采用其他架构,研究人员很早就开始探索使用新材料制作芯片。2015 年,三星、Gobal Foundries、IBM 和纽约州立大学等机构组成的研究联盟推出了一个 7 纳米的微芯片,其晶体管大约一半都由硅锗(SiGe)合金制成。石墨烯也是芯片研发一个重点。机器学习加速新材料发现,也意味着使用新材料制作的芯片出现几率大大提高。

总之,谷歌自己打造 TPU 预示着未来更多非半导体公司或许也将开始生产硬件;硬件制造商必须不断改进自己的产品,与 CPU 进行更好的配合,并且贴近用户越来越多样化的需求。

评论