《纽约时报》联合谷歌开发的 AI 算法

网络媒体的的一大特色就是有评论区,供读者直接对文章、视频发表自己的看法,但灌水、骂战、恶毒言论也让媒体头疼不已,于是有些媒体选择将评论区关闭。例如纽约时报的网站就只有 10% 的文章开放评论,但这种做法也让很多理性的读者失去了发表看法的平台,于是《时报》和谷歌合作,利用后者的算法开发了评论区恶毒言论过滤器,借此希望未来能够将 80% 的文章开放给读者评论。

本文引用地址:http://www.eepw.com.cn/article/201706/360605.htmBassey Etim 是《纽约时报》网站的社区编辑。在他看来,新闻通讯社与读者间的关系相当简单,读者付款订阅或者看广告免费读新闻,而通讯社们将挣来的钱投入后续的新闻报道中去。

不过,网站社区的出现却让事情变得越来越复杂。通讯社们想与读者进行深入交流,而读者也想找个渠道来发表自己的看法,于是读者们开始在评论区交流起来。当然,如果大家都本着友好交流的心态,评论区可能会出现许多金句,但事实上评论区却总是会出现各种不相干的内容,同时这里也成了网络暴力和谣言的温床。

为了净化评论区风气,《纽约时报》会人工对评论区的读者评论进行审核。不过,每天平均 1.2 万条以上的评论却让审核人员怨声载道。有时由于缺乏人手,他们还会直接关闭某些新闻的评论区。雷锋网发现,《纽约时报》许多争议性较强的头条新闻在发布时就直接禁止评论。

不过,这样的情况马上就要发生改变了。

今天,《纽约时报》上线了名为 Moderator(意为版主)的新系统,未来头条新闻的评论区在工作日每天都会开放 8 小时。此外,新闻和观点板块的评论区则会 24 小时开放。

Moderator 的诞生还要感谢 Jigsaw,它是谷歌旗下的技术孵化器,该公司利用机器学习技术优先审核“言论不太出格”的温和评论,有时还会自动给它们放行。Moderator 有这样的能耐是因为它遍阅了 2007 年以来评论区里超过 1600 万条温和评论。

在《纽约时报》看来,读者的评论也是内容,但它们更重视质量而非数量。调查结果也显示,《纽约时报》的读者们非常喜欢评论区不时出现的神评论。

去年夏天,Jigsaw 也发觉自己需要处理类似的问题:到底怎样提升网络会话的质量呢?

于是,两家公司一拍即合,拿到《纽约时报》的匿名评论数据后,Jigsaw 打造了一款机器学习算法,它能掌握社区编辑对待评论的尺度。除此之外,这两家公司还拉上了名为 Instrument 的数字产品合作伙伴一起打造 Moderator。如今,这款算法还成了 Perspective 计划的一部分,该项目的目标是揪出网上的骚扰和各种语言暴力。

“出版商靠广告生存,而广告商投放广告时看的是读者的参与度。”Jigsaw 董事长 Jared Cohen 写道。Jigsaw 将“帮助各大新闻平台开辟供读者进行两性讨论的空间。”

《纽约时报》将如何利用 Moderator

Moderator 的加入让社区管理用户贡献内容的方式发生了改变,传统上优先考虑每一条评论的方法被摒弃了。在 Moderator 的管理下,每条评论都会被打分,如果不符合要求就不会出现在评论区。

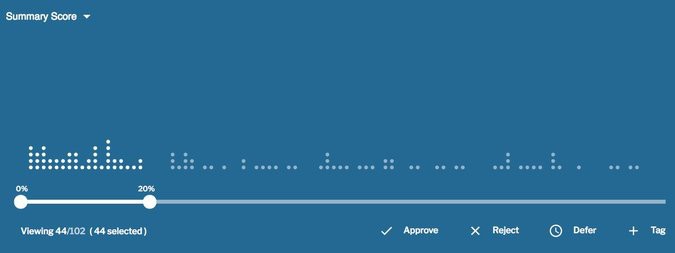

对《纽约时报》的社区编辑来说,每条评论都像是直方图上的一个小点(如下图)。

在直方图上的位置可能就会决定一条评论是否会被删掉。除此之外,Moderator 还会试着预测为何一些评论会被删掉。

有了新工具,《纽约时报》的社区编辑们轻松多了,它们能直接参考机器学习模型,阅读那些有 15%-20% 被删除可能性的评论,如果这些评论足够温和,他们可能就会对 0%-20% 区间的所有评论放行。回想从前,社区编辑们需要对每条评论进行逐个阅读。

被优先推荐的评论总是“综合评分”较高,新系统加入后,能否得高分则主要看三个方面:评论是否包含淫秽色情内容、毒害性言论和被删除的概率。

随着综合评分系统的逐渐成熟,《纽约时报》决定进一步降低社区编辑们的工作强度,那些绝对人畜无害的评论会被自动放行。

Cohen 先生表示:“机器学习的优势就在于它会随着学习的深入变得越来越聪明。”

未来,网络评论的好日子可能会重新到来。《纽约时报》就正在搭建一个能让读者随心讨论的安全环境,这里没有脏话、骚扰和网络暴力,每个人都能平心静气的抒发自己的观点。

评论